[評価指標]LogLoss(Logarithmic Loss)とは?:AI・機械学習の用語辞典

用語「LogLoss」について説明。分類タスク(問題)に対する評価指標の一つで、「機械学習モデルによる予測が正解にどれくらい近いか」、つまり予測の確実性の高さを表す。

用語解説

統計学/機械学習におけるLogLoss(Logarithmic Loss、対数損失)とは、二値分類や多クラス分類のタスク(問題)に対する評価指標の一つで、機械学習モデルによる予測が正解にどれくらい近いかを表す値である。0.0(=近い)〜∞(=遠い)の範囲の値になり、0.0に近づくほど(つまり数値が小さいほど)より良い。

正解率(Accuracy)が「分類の正確さ」を表すのに対し、LogLossは「予測の確実性の高さ」を表している(図1)。

例えば陽性(Positive)/陰性(Negative)のどちらかに分類する二値分類のタスクにおいて、その閾値(しきい値)が0.5の場合に「正解率」を計算する際には、正解値=1.0(陽性)に対して、予測値が0.9でも0.6でも同様に正解とカウントされる。しかしもっと確率値に基づいて「0.9の方が0.6よりも高い確実性で分類を予測できている」と評価したい場合がある。例えば病気の有無の分類では、「どちらかにきっちりと正確に分類されるか」よりも「病気である場合に、どれくらいの確実性の高さで病気と予測されるか」の方が大切だろう。このように「予測の確実性の高さ」を評価したい場合には「LogLoss」を見る方が適切である。

LogLossは正解率よりも汎用(はんよう)的に使えるので、特にビジネス領域では広く活用されている。先ほどは病気の有無の二値分類を例として出したが、他には例えばWebサイトのバナー広告が「クリックされる/されない」の二値分類も、やはり確率値をそのまま使うLogLossの方が正解率よりも適しているだろう。このように、正解率よりもLogLossの方が適した場面は実ビジネスで多い。

万能に見えるLogLossだが欠点もある。LogLossは個々のデータが正解からどれくらい近いかを算出して平均するので、データセットが違うと、当然ながらLogLossの結果も変わってくる。つまり、異なるデータセットを使って機械学習モデルをLogLossにより比較することはできない。比較したいのであれば、同一のテストデータを用いる必要がある。重要な点なので忘れないように注意してほしい。このようなモデル間の比較を行いたい場合は、今後解説予定のAUCの方が適切である。

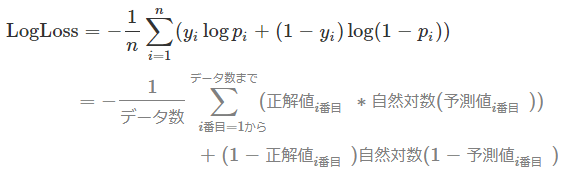

二値分類におけるLogLossの計算方法は、以下のようになる。yは正解値で、0か1の値。pは予測値で、0.0〜1.0の値が入る。nはデータ数を表す。

また多クラス分類におけるLogLossの計算方法は、以下のようになる。yは各クラス(分類)の数だけある正解値で、それぞれ0か1の値。pは各クラスの予測値で、0.0〜1.0の値が入る。nはデータ数、mはクラス数を表す。

LogLossの計算方法は、交差エントロピー誤差(Cross entropy error、「交差エントロピー損失:Cross entropy loss」や、単に「交差エントロピー:Cross entropy」とも呼ばれる)と基本的に同じものである。

「機械学習の評価関数(二値分類/多クラス分類用)を理解しよう」という記事で二値分類の場合と多クラス分類の場合のLogLossについてより詳しく意味を説明しているので、必要に応じて参照してほしい。

Copyright© Digital Advantage Corp. All Rights Reserved.