ファインチューニング(Fine-tuning:微調整)とは?:AI・機械学習の用語辞典

用語「ファインチューニング」について説明。「事前学習」した訓練済みニューラルネットワークモデルの一部もしくは全体を、別のデータセットを使って再トレーニングすることで、新しいタスク向けにモデルのパラメーターを微調整することを指す。

用語解説

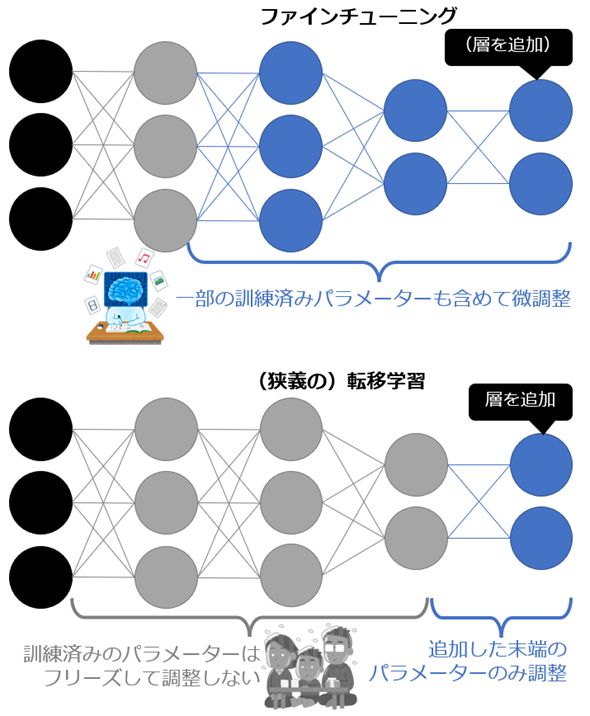

機械学習(厳密にはニューラルネットワーク)におけるファインチューニング(Fine-tuning:微調整)とは、あるデータセットを使って事前学習(Pre-training)した訓練済みモデルの一部もしくは全体を、別のデータセットを使って再トレーニングすることで、新しいタスク向けに機械学習モデルのパラメーターを微調整することである(図1)。一般的に、再トレーニングの際の学習率はより小さな値にするため、既に調整済みのパラメーターへの影響もより小さなものとなる。

ファインチューニングは、(広義の)転移学習(Transfer Learning)の一つのアプローチだとも言われている。ただし、ファインチューニングと「狭義の転移学習」は区別されることがあるので、注意してほしい。

ここで言う「狭義の転移学習」とは、訓練済みモデルのネットワークの末端(=出力層)に新しいタスク用の層を追加して、それよりも前にある各層の各パラメーターはフリーズして調整されないようにすることである。この場合、末端の層のみが訓練により調整される。

ファインチューニングでは、(基本的に)訓練済みモデルのネットワークの末端に新しいタスク用の層を追加した上で、訓練済みの一部の層もしくは全部の層の各パラメーターを微調整する。つまり末端の層以外も調整される、という違いがある。

一般的に、(狭義の)転移学習は末端の層の調整だけなのでデータ数は比較的少量でよく、ファインチューニングは末端の層も含めて複数の層を調整する必要があるのでデータ数も比較的大量に必要になる、とされている。

「ファインチューニング」という用語は自動車など他の分野でも用いられており、意味も異なる場合がある。冒頭に記したように、本稿では「機械学習/ニューラルネットワークにおけるファインチューニング」について説明している。

ここを更新しました(2023年9月11日)

ファインチューニングが他の分野でも使われる用語である注記を追加しました。

Copyright© Digital Advantage Corp. All Rights Reserved.