連載

事前学習(Pre-training)と下流タスク(Downstream Tasks)とは?:AI・機械学習の用語辞典

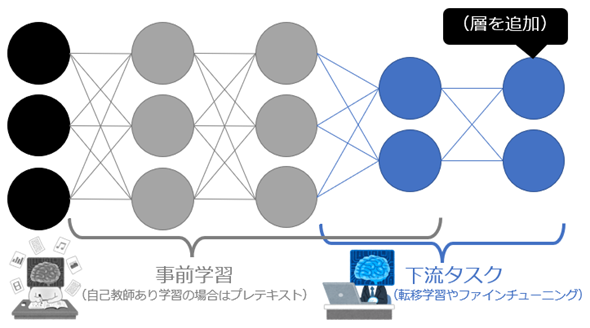

用語「事前学習」「下流タスク」について説明。訓練の工程を2段階に分けて、最初に機械学習モデルを訓練することを「事前学習」、次にその事前学習済みモデルを新しいタスクに向けて転移学習/ファインチューニングすることを「下流タスク」と呼ぶ。自己教師あり学習でも同様の用語が使われる。

用語解説

機械学習(厳密にはニューラルネットワーク)における転移学習やファインチューニングでは、基本的に訓練の工程を上流(Upstream)と下流(Downstream)の2段階に分ける。まず上流の工程で機械学習モデルを訓練することを事前学習(Pre-training)と呼び、次に下流の工程でその事前学習済みモデルを新しいタスク向けて転移学習/ファインチューニングすることを下流タスク(Downstream Tasks)と呼ぶ(図1)。

自己教師あり学習も同様の2段階の訓練工程を踏むため、「事前学習」と「下流タスク」という同じ呼び方で説明される。が、より厳密には自己教師あり学習の事前学習はプレテキストタスク(Pretext tasks)と呼ばれる。下流タスクについてはターゲットタスク(Target tasks)と呼ばれるが、そのまま「下流タスク」もしくは「ファインチューニング」と表現されることも多いようである。

Copyright© Digital Advantage Corp. All Rights Reserved.