従業員の約3割が未承認のAIエージェントを業務利用 急速な普及に対応間に合わず Microsoft調査:Fortune 500の80%以上がAIエージェントを活用

Microsoftは、AIエージェントのガバナンスとセキュリティに関する新レポート「Cyber Pulse」を公開した。同社の調査によると、Fortune 500企業の80%以上が業務でAIエージェントを活用していることが明らかになった。

Microsoftは2026年2月10日(米国時間)、サイバーセキュリティのリスクに関する実践的な洞察とガイダンスを提供するレポート「Cyber Pulse」を公開した。

同レポートは、AI(人工知能)エージェントの可観測性(オブザーバビリティ)、ガバナンス、セキュリティ確保に向けた実践的指針を示している。

Fortune 500企業の8割が直面するエージェント管理、「シャドーAI」の課題

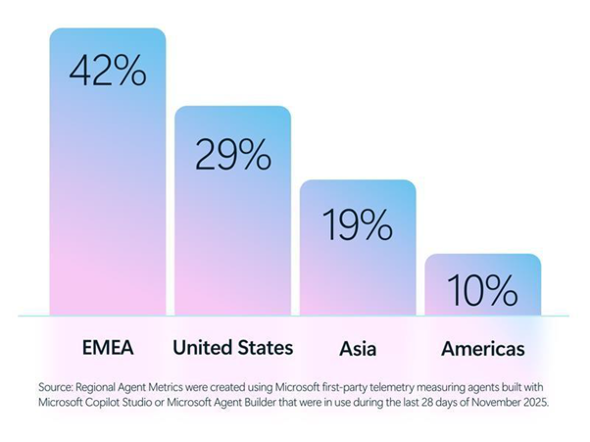

2025年11月の28日間に計測されたMicrosoftの自社テレメトリーによると、Fortune 500(米Fortune誌の売上高上位500社)の80%以上が「Microsoft Copilot Studio」や「Microsoft Agent Builder」で構築されたアクティブなAIエージェントを使用しているという。

業界別では、ソフトウェア・テクノロジー(16%)、製造業(13%)、金融機関(11%)、小売業(9%)が上位を占める。AIエージェントは技術職に限らず、営業、財務、セキュリティ、カスタマーサービス、製品イノベーションなどのワークフローで日常的に活用されている。エージェントはユーザーのプロンプトに応答する支援モードと、最小限の人間の介入で自律的にタスクを実行するモードの両方で動作している。

可視性の不足が新たなリスクに

AIエージェントの急速な普及にもかかわらず、多くの組織では「稼働エージェント数」「所有者」「アクセスデータ」「承認状況」を把握できていない。以前から問題になっている「シャドーIT」(未承認のIT利用)に加え、「シャドーAI」が新たなリスク領域となっている。

エージェントはユーザー権限を継承し、機密データにアクセスし、大規模に出力を生成できるため、統制外で動作すると情報漏えいや不正操作のリスクが高まる。

同レポートによると、従業員の29%が未承認のAIエージェントを業務に使用しているという。アクセス管理やデータ保護、コンプライアンス(法令順守)の制御が確立される前にAI機能が展開されている実態が浮き彫りになった。

AIエージェントにもゼロトラスト原則の適用を推奨

レポートでは、AIエージェントを従業員やサービスアカウントと同等の基準で管理すべきとし、ゼロトラストの3原則を一貫して適用することを推奨している。

- 最小特権アクセス

- 全てのユーザー、AIエージェント、システムに必要最小限の権限のみを付与する

- 明示的検証

- ID(アイデンティティー)、デバイスの健全性、場所、リスクレベルを用いてアクセス要求を常に確認する

- 侵害前提の設計

- サイバー攻撃者が内部に侵入することを前提にシステムを設計する

AIエージェントのオブザーバビリティとガバナンスを確保するための5つの推奨事項

Microsoftは、AIエージェントのオブザーバビリティとガバナンスを確立するために、組織が構築すべき5つの取り組みを次のように提示している。

- レジストリ

- 組織内の全エージェントを正規・外部・未承認を問わず一元管理し、未承認エージェントのスプロール(無秩序な増加)化を防ぐ

- アクセス制御

- 人間と同様のID管理に基づき、最小特権の原則を徹底して付与する

- 可視化

- リアルタイムのダッシュボードとテレメトリーで挙動や依存関係を監視し、不正利用やリスクの兆候を早期に検知する

- 相互運用性

- Microsoftプラットフォーム、オープンソースフレームワーク、サードパーティーエコシステム全体で一貫したガバナンスモデルの下、エージェント間の連携と管理を両立させる

- セキュリティ

- 組み込みの保護機能により、内部の不正利用や外部のサイバー脅威からエージェントを保護し、侵害されたエージェントや不整合なエージェントを早期に検知して対応する

ガバナンスとセキュリティは何が違うのか

Microsoftは、ガバナンスとセキュリティは相互補完的だが別領域だと位置付けている。ガバナンスは所有権、説明責任、ポリシー、監視を定義し、セキュリティは制御の適用、アクセスの保護、サイバー脅威の検知を担う。

同レポートは、「AIガバナンスはIT部門だけに、AIセキュリティはCISO(最高情報セキュリティ責任者)だけに任せるべきではない。法務、コンプライアンス、人事、データサイエンス、経営層、取締役会を含む全社横断で担うべきだ」と指摘している。

MicrosoftのSecurity部門コーポレートバイスプレジデントを務めるヴァス・ジャッカル氏は、「AIリスクを財務、運用、規制リスクと並ぶエンタープライズリスクとして扱う組織ほど、迅速かつ安全に展開できる。セキュリティとイノベーションは対立するものではなく、互いを強化するものだ」と述べている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

AIコーディングはなぜ後から苦しくなるのか? 技術負債に続く「理解負債」「認知負債」という新たな落とし穴

AIコーディングはなぜ後から苦しくなるのか? 技術負債に続く「理解負債」「認知負債」という新たな落とし穴

AIコーディングが普及する中で注目され始めた「理解負債」と「認知負債」。従来の技術負債と合わせた「AIコーディング時代の三大負債」を整理し、なぜ開発が後から苦しくなるのかを分かりやすく解説する。 Excel作業が劇変! AIアドイン「Claude in Excel」の導入メリットと活用術

Excel作業が劇変! AIアドイン「Claude in Excel」の導入メリットと活用術

AnthropicがExcel用アドイン「Claude in Excel」の提供を開始した。複雑な数式の生成やデータ分析、シート構造の把握など、これまで手間取っていた作業を自然言語の指示だけで完結できる便利なツールだ。Claude in Excelの導入手順やセキュリティ設定の注意点まで、実務で役立つ活用ポイントを解説する。 「ChatGPTの利用禁止」だけでは組織を守れない AIとどう向き合い、管理すべきか

「ChatGPTの利用禁止」だけでは組織を守れない AIとどう向き合い、管理すべきか

生成AIにおいても「シャドーIT」と同様、見えないところで使われるというセキュリティリスクの問題が顕在化しています。なぜ従業員は非公認ツールを使ってしまうのか? その根本原因と、IT担当者、組織の向き合い方とは。