ハルシネーションか、計画の順守失敗か? AIエージェントのデバッグが難しい理由:障害を自動診断するOSS「AgentRx」公開

Microsoft Researchは、AIエージェントの実行軌跡から障害箇所を自動で特定するフレームワーク「AgentRx」をオープンソースソフトウェアで公開した。

Microsoft Researchは2026年3月12日(米国時間)、AIエージェントの障害を体系的に診断するフレームワーク「AgentRx」(Agent Diagnosisの略)をオープンソースソフトウェア(OSS)で公開した。

AgentRxは、クラウド障害管理やAPIワークフローなど複雑なタスクを実行するAIエージェントが失敗した場合に、「どのステップで問題が発生したか」を自動で特定することを目的としている。

AIエージェントのデバッグが難しい理由

AIエージェントのデバッグは、従来のソフトウェアと比べて難易度が高い。主な要因としてAIエージェントの以下の特性が挙げられる。

- 長期タスク対応

長時間にわたって複数ステップにまたがる処理を実行する - 確率的挙動

同一入力でも異なる出力が生じるため再現が困難 - マルチエージェント構成

障害がエージェント間で“広がる”ので、根本原因が隠される可能性がある

こうした特性から、従来のようにタスク完了の成否を問う指標だけでは、障害の根本原因を特定するには不十分だったという。

計画の順守失敗か、ハルシネーションか? ベンチマークと評価結果

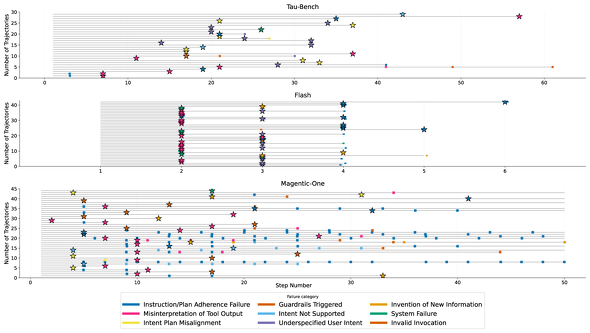

AgentRxの評価には、手動でアノテーションを付与した115件の失敗軌跡からなるベンチマーク「AgentRx Benchmark」(Hugging Faceで公開)を使用した。

以下の9カテゴリーで障害を分類している。この分類体系は、開発者が「計画の順守失敗」(エージェントが自身の手順を無視した場合)と「新情報の捏造(ねつぞう)」(ハルシネーション)を区別するのに役立つという。

- 計画の順守失敗

必要なステップの省略や計画外の行動を実行 - 新情報の捏造

実行ログやツール出力に基づかない情報を生成 - 無効な呼び出し

ツール呼び出しの形式不正、引数不足、スキーマ違反 - ツール出力の誤解釈

ツール出力を誤読、結果を誤って理解 - 意図と計画の不一致

ユーザーの目的や制約を読み誤り、誤った計画を立案 - ユーザー意図の不足

情報不足で処理不能 - サポート外の意図

利用可能なツールでは実行不可能 - ガードレール(安全対策)作動

安全制御、アクセス制御によって処理が停止 - システム障害

接続障害やツールエンドポイントの障害

ベンチマークのデータは、以下の3ドメインから収集されている。

- τ(Tau)-Bench:小売業およびサービス業向けの構造化API

- Flash:実世界のインシデント管理とシステムトラブルシューティング

- Magentic-One:汎用(はんよう)的なマルチエージェントシステムを用いた、自由度の高いWebおよびファイル処理タスク

既存のLLMベースのプロンプト手法と比較した検証では、障害箇所の特定精度が23.6ポイント、根本原因の特定精度が22.9ポイント向上したという。

どうやって障害を見つけるのか? AgentRxの処理パイプライン

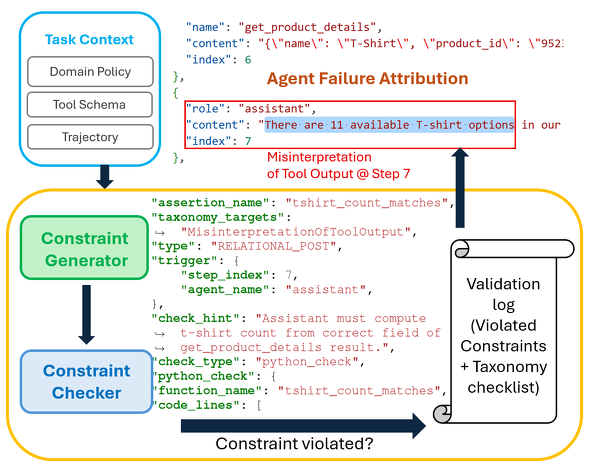

AgentRxは、エージェントの実行軌跡を検証するパイプラインとして設計されている。具体的には以下の4段階で処理を行う。

1.軌跡の正規化

異なるドメインのログを共通の中間表現に変換する。

2.制約の生成

ツールのスキーマやドメインポリシー(例:「ユーザー確認なしにデータを削除してはならない」)に基づき、実行可能な制約を自動生成する。

3.ガード付き評価

各制約を適用条件が成立するステップのみで検証し、違反の証拠付きログを生成する。

4.大規模言語モデル(LLM)による診断

生成した違反ログと9カテゴリーの障害分類を用いて、LLMが「重大障害ステップ」(回復不能なエラー)を特定する。

AgentRxのフレームワークとデータセットはOSSで公開されている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

GitHubが明かす、「マルチエージェントシステム」失敗の要因と設計のプラクティス

GitHubが明かす、「マルチエージェントシステム」失敗の要因と設計のプラクティス

GitHubは、マルチエージェントによるワークフローが失敗しやすい要因と、信頼性を高める3つの設計パターンを解説した。 AIエージェントは「便利なだけ」では普及しない? 標準化へ、イニシアチブ発足

AIエージェントは「便利なだけ」では普及しない? 標準化へ、イニシアチブ発足

NISTは、AIエージェントの標準化を推進する「AI Agent Standards Initiative」を発足した。自律型AIの信頼性確保と相互運用性の実現を目指す。 開発者の未来は「承認疲弊」? AIエージェントが従来のガバナンスを破壊する理由

開発者の未来は「承認疲弊」? AIエージェントが従来のガバナンスを破壊する理由

Dockerは、自律的に動作するAIエージェントを前提とした新たなセキュリティフレームワーク「3C」を提唱した。エージェント実行層でのガバナンスを実現する新たな指針になるという。 AIエージェントの「振る舞い」をどう評価する? 実践者が明かす「設計」「テスト」の勘所

AIエージェントの「振る舞い」をどう評価する? 実践者が明かす「設計」「テスト」の勘所

2025年12月20日、JAWS-UG主催のコミュニティーイベント「AI Builders Day」が開催された。本稿では、そのセッションの中から、Amazon Web Servicesを活用したAIエージェント開発の現在地と、AIエージェントの設計や評価のポイントをまとめてお届けする。 Cursor開発チームが明かす、コーディングエージェントの7つのベストプラクティス

Cursor開発チームが明かす、コーディングエージェントの7つのベストプラクティス

Cursor開発チームは、同社のCursor IDEを活用する上で、コーディングエージェントの性能を最大限に引き出すためのベストプラクティスを公開した。単なるコード生成にとどまらず、大規模なリファクタリングやテスト駆動開発の自動化が可能になる一方、その制御にはコツが必要だと指摘している。