話者の動画を与えると単語を容易に修正できる手法を開発、スタンフォード大などの研究チーム:言い間違いを容易に編集

スタンフォード大学などの研究者のチームが、話者の動画を容易に編集する手法を編み出した。人物の肩から上の映像を使うだけで、口にしていない単語を埋め込み、修正できる。修正方法は文字起こししたテキストを編集するだけという手軽さだ。

スタンフォード大学とマックスプランクインフォマティクス研究所、プリンストン大学、Adobe Researchの研究者のチームは、人物が話している肩から上の映像を手軽に編集できるアルゴリズムを開発した。

話者の音声を文字起こししたテキストを用意し、これを編集するだけで、対応する動画が自動的に変化する。

このアルゴリズムを使ったアプリケーションにはさまざまな使い道がある。例えば映像の中に話者の言い間違いなど、変更したい部分があった場合、文字起こしテキストを編集すれば、アプリケーションが機械学習を基に、映像内の他の場面(と、そこで話された音声)の一部や断片を組み合わせて、唇の動きと音声が同期する形で、テキストを編集した通りに映像を編集する。

映像が自然に見えるように、アルゴリズムはインテリジェントスムージングをモーションパラメーターに適用し、目指す結果の3Dアニメーションバージョンをレンダリングする。だが、レンダリング後の顔はリアルさに欠けている。そこで最終ステップとして、ニューラルレンダリングという機械学習技術を用いて、忠実度の低いデジタルモデルを、写真のようにリアルな映像に変換する。完成した動画では唇の動きと音声の同期が取れている。

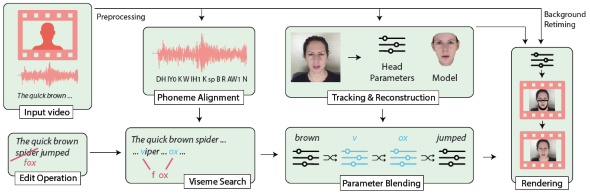

アルゴリズムの動作。肩から上の動画と文字起こしをシステムに投入後、全ての音素を入力音声と位置合わせし、各入力フレームを追跡して口の位置や表情を表す「パラメトリックヘッドモデル」を構築した。特定の単語を差し替えたい場合(図では「spider(クモ)」を「fox(キツネ)」と置き換えようとしている)、foxに類似した形態素がある動画の部分を探し出す(図では「viper(毒ヘビ)」と「ox(雄牛)」)。それぞれの動画の部分から頭部パラメーターを抽出し、最後にニューラルレンダリングで顔画像を自然な形に修正した(出典:Stanford University)

機械学習の入力情報として使うため、こうした映像編集を実現するには、40分間以上の長さの映像が必要だ。

編集後の動画をテストした結果は?

研究者はシステムの能力をテストするため、単語の追加や削除、変更、さまざまな言語への翻訳、さらには1つの文章を丸ごと追加するといった複雑な編集を行った。

クラウドソーシングを利用して138人の実験参加者を募り、参加者の動画を編集した。編集結果は、ほぼ60%の割合で「リアル」と評価されるに至っている。

編集結果のビジュアル品質は、オリジナル映像にかなり近いレベルに達している。だが、研究チームは、映画における撮影後の編集などへの応用を考慮すると、まだ大きな改善の余地があると考えている。

倫理的な問題

今回の研究成果にはメリット以外の面もある。有名人の合成されたフェイク動画が問題となっている中、映像編集技術では、倫理的な問題も考える必要があると、研究チームは述べている。

今回の技術は悪用の恐れもあるが、リスクを取って取り組む価値があるというのが研究チームの認識だ。幾つかの悪用対策も提案している。

一つは、コンテンツに編集が加えられていることを示す何らかの透かし技術を開発すること。もう一つは、映像が隠された目的のために操作されていないかどうかを判断するためのデジタル指紋技術など、高度なフォレンジック技術を開発することだ。

映像編集に関する問題は根深い。今回の手法を使わなくても簡単に映像を操作する方法が既にたくさんあるためだ。映像操作について人々の認識を高めることや、教育を行うことが、最も差し迫った課題かもしれないと研究チームは述べている。

研究成果をまとめた論文は論文公開サイト「arXiv」で公開されている。論文は「ACM Transactions on Graphics」にも掲載される予定だ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

動画処理を低コストで超高速化するフレームワークを開発、カリフォルニア大

動画処理を低コストで超高速化するフレームワークを開発、カリフォルニア大

カリフォルニア大学サンディエゴ校のコンピュータサイエンスの研究チームが、動画の検索やエンコード、変換、編集を現行技術より桁違いに高速化する新フレームワーク「Sprocket」を開発した。動画の長さにかかわらず、検索に要する時間がほぼ変わらないことが特徴だ。 MITの研究チーム、画像内のオブジェクトを音声によって識別する機械学習システムを開発

MITの研究チーム、画像内のオブジェクトを音声によって識別する機械学習システムを開発

マサチューセッツ工科大学(MIT)の研究者チームは、画像内のオブジェクトを画像の音声説明に基づいて識別する機械学習システムを開発した。「Siri」などとは異なり、あらかじめ何千時間分もの音声録音の文字起こしを必要とせず、話者の少ない言語にも拡張しやすい。 東芝らがマラソンなどの中継向け映像認識AIを開発、選手に追従し映像を自動編集

東芝らがマラソンなどの中継向け映像認識AIを開発、選手に追従し映像を自動編集

東芝と東芝デジタルソリューションズは番組制作を支援する映像認識AIを開発した。ロードレース中の選手を検出、追従し、所属するチーム名もリアルタイムで認識する。追い越しシーンなど、レース中の見どころを自動的に抽出できるため、長時間の人的作業負荷を軽減できる。