「半分の学習データ量」で高い識別精度を維持するディープラーニング技術を開発 NEC:中間層で得られる特徴量を変化させる

NECは、学習データ量が従来の半分程度でも高い識別精度を維持できるディープラーニング技術を開発した。ニューラルネットワークの中間層で得られる特徴量を意図的に変化させることで、識別に失敗しやすいデータを集中的に人工生成して識別精度を高める。

NECは2019年8月19日、学習データ量が従来の半分程度でも高い識別精度を維持できるディープラーニング技術を開発したと発表した。ディープラーニングを適用するシステムの開発期間を短縮できるとしている。

中間層の特徴量を意図的に変える

ディープラーニングは、入力層、中間層(隠れ層)、出力層という、大きく分けて3層構造を採る。そのうち中間層では、人工ニューロン(シグモイドニューロン)と呼ばれる脳の仕組みを模したモデルを複数組み合わせてニューラルネットワークを構成する。

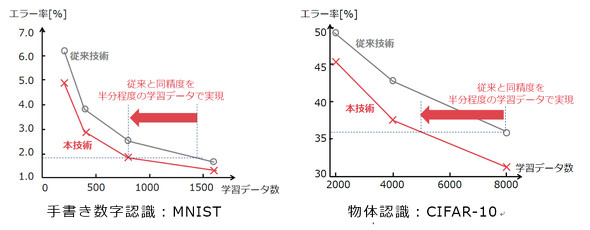

NECが開発した技術は、この中間層で得られる特徴量を意図的に変化させることで、識別に失敗しやすい「苦手な学習データ」を集中的に人工生成して識別精度を高める。NECは、同社が開発した技術を「MNIST」と呼ぶ手書き数字認識に適用したところ、学習データ量が半分でも従来の技術と認識精度が変わらないことを確認したとしている。

「データ拡張」との違い

一般にディープラーニングの識別精度を高めるには、「苦手な学習データ」をより多く学習させることが有効といわれている。従来は、ニューラルネットワークに入力する前にデータを意図的に加工、変形させて、学習データ量を人工的に増やす「データ拡張」と呼ばれる方法で、苦手な学習データを取得していた。だがこの方法では、データ量が不十分で、識別精度の向上に寄与しないデータも多く生成されてしまい、結果として十分な学習効果が得られなかった。

さらにデータ拡張は、データの種類に応じてデータの生成方法を変える必要があったため、専門家がデータ生成方法を慎重に選び、学習に悪影響を及ぼすデータが発生しないよう調整しなければならなかった。

これに対してNECの技術は、データの種類を問わず汎用(はんよう)的に適用可能で、専門家による調整がいらない。ニューラルネットワーク内部の数値に基づいて自動的に学習データを生成するためだ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

ディープラーニングも使える確率的プログラミングツール「Gen」を開発、MIT

ディープラーニングも使える確率的プログラミングツール「Gen」を開発、MIT

マサチューセッツ工科大学(MIT)の研究チームが開発した確率的プログラミングツール「Gen」を使えば、初心者でも簡単にAIに触れることができ、専門家は高度なAIプログラミングが可能になる。ディープラーニングよりも適用範囲の広いことが特徴だ。 Lesson 3 機械学習&ディープラーニングの、基本的なワークフローを知ろう

Lesson 3 機械学習&ディープラーニングの、基本的なワークフローを知ろう

機械学習/ディープラーニングの作業フローの基礎を学び、実践へ踏み出す準備をしよう。機械学習モデルは、どのようなステップで作成していくのか? データ収集〜学習〜運用の一連の流れをできるだけシンプルに紹介する。 「AI」「機械学習」「ディープラーニング」は、それぞれ何が違うのか

「AI」「機械学習」「ディープラーニング」は、それぞれ何が違うのか

「AI」「機械学習」「ディープラーニング」は、それぞれ何が違うのか。GPUコンピューティングを推進するNVIDIAが、これらの違いを背景および技術的要素で解説した。