乵AI丒婡夿妛廗偺悢妛乶儀僋僩儖偺婎杮偲椶帡搙偺寁嶼丗AI丒婡夿妛廗偺悢妛擖栧乮4/4 儁乕僕乯

婡夿妛廗偱偼丄晛捠丄懡偔偺曄悢傗學悢傪摨帪偵庢傝埖偆丅偦偺傛偆側応崌偵偦傟偧傟偺曄悢傗學悢傪暿乆偵庢傝埖偆偲悢幃偑斚嶨偵側偭偰偟傑偆丅儀僋僩儖傗峴楍傪棙梡偡傟偽丄暋悢偺抣傪傂偲傑偲傔偵偟偰庢傝埖偊傞偺偱丄悢幃偑嬌傔偰娙寜偵側傞丅崱夞偼儀僋僩儖偵偮偄偰丄婎杮揑側寁嶼曽朄傪徯夘偡傞丅

栚昗亂偦偺4亃丗 儀僋僩儖偺戝偒偝傪媮傔傞

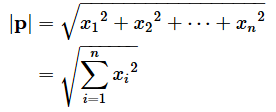

丂儀僋僩儖偺戝偒偝乮挿偝乯偲偼丄巒揰偐傜廔揰傑偱偺嫍棧偱偡丅椺偊偽丄儀僋僩儖p偺戝偒偝偼丄愨懳抣傪昞偡婰崋偲摨偠乽|乿傑偨偼乽||乿傪巊偭偰丄埲壓偺傛偆偵昞偟傑偡丅

傑偨偼

丂儀僋僩儖偺戝偒偝偼丄楢嵹偺戞1夞偱尒偨僺僞僑儔僗偺掕棟傪巊偊偽娙扨偵媮傔傜傟傑偡丅

偱偁傟偽丄

偲側傝傑偡丅師尦偑憹偊偰傕摨條偱偡丅奺惉暘偺擇忔榓偺儖乕僩偑儀僋僩儖偺戝偒偝偵側傝傑偡丅

偱偁傟偽丄

偲側傝傑偡丅

夝愢亂偦偺4亃丗 儀僋僩儖偺戝偒偝傪媮傔傞乮偝傜偵僐僒僀儞椶帡搙傕寁嶼偡傞乯

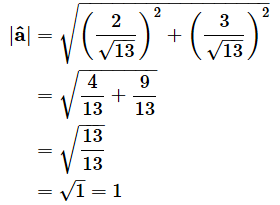

丂儀僋僩儖偺戝偒偝傪媮傔傞寁嶼偼僺僞僑儔僗偺掕棟偦偺傕偺側偺偱丄徻偟偔愢柧偡傞昁梫偼側偄偲巚偄傑偡丅偦偙偱丄彮偟偩偗娭楢偺偍榖傪偡傞偙偲偵偟傑偟傚偆丅慜儁乕僕偺楙廗栤戣乮2乯偱丄儀僋僩儖偺戝偒偝傪1偵偦傠偊傟偽丄撪愊偑僐僒僀儞椶帡搙偵側傞偲偄偆榖傪偟傑偟偨丅儀僋僩儖偺戝偒偝傪1偵偡傞乮扨埵儀僋僩儖偵偡傞乯偵偼丄儀僋僩儖傪偦偺戝偒偝偱妱傟偽偄偄偱偡偹丅偪傚偭偲椺傪尒偰傒傑偟傚偆丅

偺偲偒丄

偱偡丅廬偭偰丄a偲摨偠岦偒偱挿偝傪1偵偟偨儀僋僩儖傪â偲昞偡偲丄埲壓偺傛偆偵側傝傑偡丅

丂側偍丄^偼乽僴僢僩乿偲撉傒傑偡丅â乮僄乕丒僴僢僩乯偺戝偒偝傪媮傔偰傒傑偟傚偆丅

丂妋偐偵丄â偼丄a偲摨偠岦偒偱挿偝傪1偵偟偨儀僋僩儖偵側偭偰偄傑偡偹丅偙傟偱丄楙廗栤戣偺偲偙傠偱彮偟怗傟偨僐僒僀儞椶帡搙偑媮傔傜傟傑偡丅

丂椺偊偽丄儀僋僩儖p偲儀僋僩儖q偺僐僒僀儞椶帡搙偼丄偦傟偧傟儀僋僩儖偺挿偝偱妱偭偰媮傔偨扨埵儀僋僩儖偺撪愊偱媮傔傜傟傑偡偹丅偮傑傝丄

偲側傝傑偡丅cos兤乮僐僒僀儞丒僔乕僞乯偑僐僒僀儞椶帡搙偱偡偑丄偙傟偼2偮偺儀僋僩儖偺側偡妏搙兤偺梋尫娭悢乮僐僒僀儞乯偺抣偦偺傕偺偱偡*3丅

*3丂杮棃偱偁傟偽丄奺儀僋僩儖傪偦偺戝偒偝偱妱偭偰偐傜撪愊傪媮傔偨抣乮忋偺乵A乶幃乯偲丄撪愊傪奺儀僋僩儖偺戝偒偝偺愊偱妱偭偨抣乮忋偺乵B乶幃乯偑堦抳偡傞偙偲傪妋擣偟偰偍偔昁梫偑偁傝傑偡乮幚嵺偦偆側傝傑偡乯偑丄偦傟偵偮偄偰偼徣棯偟偰偄傑偡丅側偍丄cos側偳偺嶰妏娭悢偵偮偄偰偼婡夛傪尒偰傑偨夝愢偟偨偄偲巚偄傑偡丅

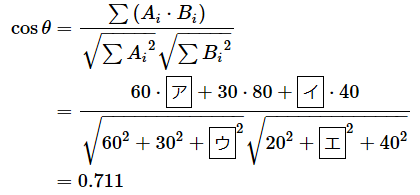

丂僐僒僀儞椶帡搙傪昞偡幃偺堄枴傪恾偱妋擣偟偰偍偒傑偟傚偆丅

丂p亖(x1,x2,...,xn),q亖(y1,y2,...,yn)偱偁傟偽丄埲壓偺傛偆側寁嶼偱抣偑媮傔傜傟傑偡丅

丂僐僒僀儞椶帡搙偼乮摑寁妛偺堦庤朄偱偁傞乯僋儔僗僞乕暘愅側偳偱廤抍偺椶帡搙傪媮傔傞偺偵巊傢傟傑偡丅傑偨丄2偮偺曄検偺娭學傪昞偡憡娭學悢傕摨偠幃偱媮傔傜傟傑偡丅偨偩偟丄憡娭學悢偺応崌偼丄奺僨乕僞偐傜暯嬒抣傪堷偄偨抣丄偮傑傝暯嬒抣傪尨揰偲偟偨儀僋僩儖傪巊偄傑偡丅

丂偱偼丄楙廗栤戣戙傢傝偵僐僒僀儞椶帡搙傪媮傔傞椺傪尒偰偍偒傑偟傚偆丅僆儗儞僕偺晹暘傪僋儕僢僋傑偨偼僞僢僾偡傞偲摎偊偑昞帵偝傟傑偡丅側偍丄摦夋偱偺夝愢傕梡堄偟偰偍偔偺偱偤傂嶲峫偵偟偰偔偩偝偄丅

摦夋2丂僐僒僀儞椶帡搙傪媮傔傞椺

丂椺偊偽丄A丄B丄C偲偄偆3庬椶偺僥僗僩傪3恖偺儊儞僶乕偑庴尡偟偨傕偺偲偟傑偡丅偦傟偧傟偺惉愌偑埲壓偺傛偆偵側偭偰偄傞偲偒丄僥僗僩A偲B偺椶帡搙丄僥僗僩A偲C偺椶帡搙傪媮傔偰傒傑偟傚偆丅

| A | B | C | |

|---|---|---|---|

| 1 | 60 | 20 | 70 |

| 2 | 30 | 80 | 20 |

| 3 | 80 | 40 | 70 |

| 昞1丂3庬椶偺僥僗僩偺寢壥 | |||

丂3庬椶偺僥僗僩偺寢壥傪儀僋僩儖偱昞偟偰傒傑偟傚偆丅

A 亖 (60,30,丂80丂)

B 亖 (20,丂80丂,40)

C 亖 (70,20,70)

偲側傝傑偡丅A偲B偺僐僒僀儞椶帡搙cos兤偼丄埲壓偺傛偆偵側傝傑偡丅乵傾乶乣乵僄乶偺晹暘偵偼悢抣偑擖傝傑偡丅

乮摎偊丗 乵傾乶亖丂20丂丄乵僀乶亖丂80丂丄乵僂乶亖丂80丂丄乵僄乶亖丂80丂乯

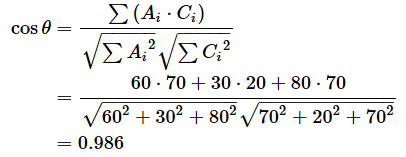

丂嵟屻偺寁嶼偼庤寁嶼偱偼柺搢側偺偱揹戩傗昞寁嶼僜僼僩偱嵪傑偣偰偟傑偆偲偄偄偱偟傚偆丅摎偊偼丄0.711偲側傝傑偟偨丅偱偼丄A偲C偺僐僒僀儞椶帡搙傕媮傔偰傒傑偟傚偆丅

丂偙偪傜偼寢壥偩偗傪帵偟偰偍偒傑偡丅摎偊偼丄0.986偲側傝傑偟偨丅

丂僥僗僩A偲僥僗僩B傛傝傕丄僥僗僩A偲僥僗僩C偺椶帡搙偺曽偑崅偄偲偄偆偙偲偑暘偐傝傑偟偨丅偪側傒偵丄偙偺椺偱偼抣偑慡偰惓側偺偱丄僐僒僀儞椶帡搙偼晧偵偼側傝傑偣傫乮偪側傒偵A偲B偺憡娭學悢偼-0.737丄A偲C偺憡娭學悢偼0.918偱偡乯丅

丂壗搙傕孞傝曉偟傑偡偑丄儀僋僩儖偼暋悢偺抣摨巑偺寛傑偭偨寁嶼傪娙扨側幃偱昞偡偺偵栶棫偪傑偡丅寁嶼栤戣偼偁偔傑偱傕丄偳偆偄偆儖乕儖偱寁嶼傪偡傞偐傪棟夝偡傞偨傔偺傕偺偱偡丅幃偑棫偰傜傟傟偽丄幚嵺偺嵶偐側寁嶼偼PC偵傑偐偣偰偟傑偊偽偄偄丄偲偄偆傢偗偱偡丅

師夞偼乧乧

丂崱夞偼慄宍戙悢偺婎杮偲偟偰丄儀僋僩儖偺峫偊曽偲婎杮揑側寁嶼乮榓丒嵎丒撪愊丒儀僋僩儖偺挿偝乯偵偮偄偰尒傑偟偨丅儀僋僩儖偑巊偊傞傛偆偵側傞偲懡悢偺抣傗曄悢傪偨偭偨1偮偺暥帤偱昞偡偙偲偑偱偒傞偙偲偑暘偐偭偨偲巚偄傑偡丅師夞偼乽峴楍乿偵偮偄偰偦偺婎杮傪妛傃傑偡丅峴楍傪棙梡偡傞偲夞婣傗僯儏乕儔儖僱僢僩儚乕僋傪傛傝娙寜偵昞偡偙偲偑偱偒傑偡丅

Copyright© Digital Advantage Corp. All Rights Reserved.