「考えただけ」で文字を入力できるAIシステムを開発:脳とAIを「結合」して書字動作を判定

脳の運動皮質に埋め込んだデバイスから得たデータをAIが解釈することで、四肢の不自由な患者がテキストでコミュニケーションできるシステムをスタンフォード大学の研究チームが開発した。

スタンフォード大学は2021年5月12日(米国時間)、考えただけで文字を出力できるシステムを開発したと発表した。

AIソフトウェアと、四肢まひの男性被験者の脳に埋め込まれた「ブレーンコンピュータインタフェース」(BCI)デバイスを組み合わせて、被験者が思い描いた手書き文字をコンピュータ画面にテキストとして出力するシステムだ。「Nature」誌のオンライン版に2021年5月12日付で論文が掲載された。

書くことを想像して入力するシステム

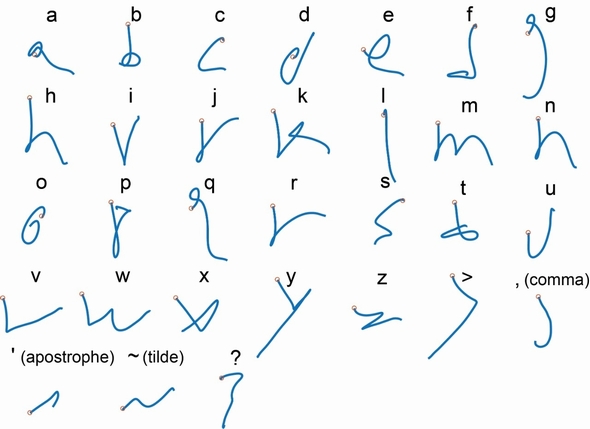

このシステムは例えば「A」という文字を思い浮かべて出力するのではなく、「A」という文字を書くところを想像する必要がある。BCIが運動ニューロンからの信号を受け取り、その情報をAIソフトウェアが高速にテキストに変換して画面に表示する。

同大学の神経外科教授で医学博士のジェイミー・ヘンダーソン氏はこう語っている。「この研究成果は、脊髄損傷や脳卒中、筋萎縮性側索硬化(ALS)で上肢が動かなくなったり、話せなくなったりした多くの人に恩恵をもたらす。そのような研究や技術の進歩を促進する可能性がある」

四肢まひ患者が「想像」したアルファベットの手書き文字 スタンフォード大学の研究チームが開発したシステムは、次のように動作する。まず被験者が手で書く操作を想像する。次に脳に埋め込まれたセンサーが、発生した神経信号を検知し、AIアルゴリズムがその信号をテキストに変換する(出典:スタンフォード大学、Frank Willett氏)

文字を書くところを思い描く必要があるため、回りくどい方法にも思えるが、速度は十分だという。「このアプローチにより、被験者は、同じ年齢層の健常者がスマートフォンでタイプ入力した場合にほぼ匹敵するスピードで、文字を入力できるようになった。この取り組みの目標は、テキストでコミュニケーションを行う能力を取り戻すことだ」と同氏は説明した。

被験者のテキスト入力速度は、1分当たり約18ワードだった。同じ年齢層の健常者がスマートフォンで入力する速度は、1分当たり約23ワードだ。

どのようなシステムなのか

論文で「T5」として言及されている被験者は、2007年に脊髄損傷で首から下がまひしてしまった。2016年にヘンダーソン氏が、小児用アスピリン錠剤程度の大きさのBCIチップをT5氏の左脳に2つ埋め込んだ。各チップは100個の電極を備え、手の動きをつかさどる運動皮質の一部におけるニューロンの発火信号を検知する。

このニューロン信号をケーブル経由でコンピュータに送信し、AIアルゴリズムが信号を解読して、T5氏が意図した手と指の動きを推測する。

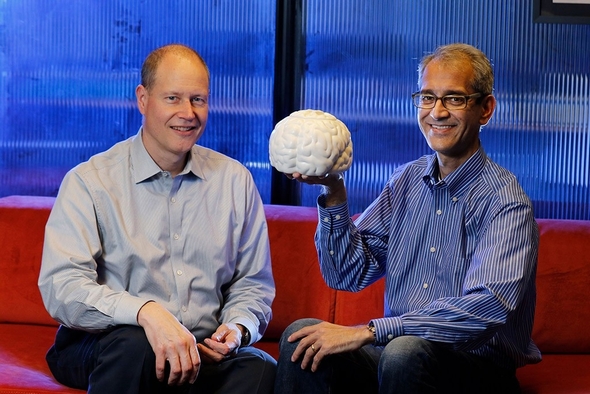

このアルゴリズムは、スタンフォード大学の神経補綴翻訳研究所で設計された。この研究所は、ヘンダーソン氏と電気工学教授のクリシュナ・シノイ氏が共同で指揮している。

シノイ氏とヘンダーソン氏は、2005年からBCIを共同で研究しており、今回の論文のシニア共著者だ。リサーチサイエンティストのフランク・ウィレット博士が筆頭著者を務めた。

スクリーンキーボード方式から手書き方式へ

研究チームが2017年に行った研究では、T5氏を含む3人の四肢まひの被験者(全員、運動皮質にBCIチップを埋め込まれている)は、「手と腕を使って、スクリーンキーボード上のあるキーから別のキーにカーソルを動かし、そのキーをクリックする」操作に意識を集中するよう求められた。

T5氏はこの研究において、表示された文を書き写す作業で1分当たり約40字という過去最高の入力速度を実現した。別の被験者は、その場で自由に文を作る作業で1分当たり24.4字の速度で入力できた。

2017年の研究では、タイピングをモデルにした入力方式が採用されていたが、Natureに論文が掲載された今回の研究では、手書きをモデルにした入力方式に変わった。

T5氏が頭の中で想像上のリーガルパッド(法律用箋)に想像上のペンで、アルファベットの個々の文字を書くことに意識を集中させ、各文字についてこの作業を10回繰り返した。AIソフトウェアはこの過程で、同氏が意識の中で特定の文字を書こうとする際に発生する神経信号を認識する学習を行った。

さらにT5氏は、アルゴリズムが学習したことがない文を書き写す作業を指示され、最終的に、1分当たり90字(約18ワード)で入力できるようになった。その後、自由回答形式の問題に答えるよう求められ、1分当たり73.8字(平均15ワード近く)の速度で入力できた。これは、2017年の研究で被験者の1人が記録した入力速度の約3倍に相当する。

AIが学習しやすいのは実は手書き動作だった

研究チームは2017年の研究との比較により、使用したAIアルゴリズムにとっては、手書きのような複雑な動きの方が、あるポイントから別のポイントへのカーソル移動のような単純な動きよりも、簡単かつ高速に解釈できることが分かったと述べている。アルファベットの各文字はそれぞれ形が異なるため、区別しやすいのだという。

入力ミスを修正する方法も分かった。文を書き写す作業で起きたT5氏のミスは、18〜19字に1回の割合だった。自由に文を作る作業では、11〜12字に1回と多くなった。研究チームが自動修正機能(スマートフォンキーボードに組み込まれている機能に似たもの)を導入したところ、ミスの発生率はそれぞれ1%未満、2%強へと大幅に改善された。

シノイ氏によると、このミス発生率は、他のBCIの場合と比べてかなり低いという。

なお、研究で使われたBCIは法律によって、研究目的に用途が限定されており、商用利用はまだ認められていない。スタンフォード大学のテクノロジーライセンシングオフィスは、ウィレット氏とヘンダーソン氏、シノイ氏の研究に関連する知的財産の特許を出願済だ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

脳活動を基に「楽曲の特徴」を可視化し、ヒット要因を把握する技術 NTTデータなど3社が開発

脳活動を基に「楽曲の特徴」を可視化し、ヒット要因を把握する技術 NTTデータなど3社が開発

NTTデータなど3社は、楽曲の特徴を捉えてヒットソングがヒットした要因を把握するなど、楽曲の脳情報化に関する技術を開発した。人が楽曲を聴いているときの脳活動を推定して、楽曲の特徴を抽出し、可視化する。 CNNなんて怖くない! その基本を見てみよう

CNNなんて怖くない! その基本を見てみよう

画像認識などでよく使われるCNN(畳み込みニューラルネットワーク)ではどんなことが行われているのでしょう。図を見ながら、CNNの基本を理解しましょう。 EMNIST:手書きアルファベット&数字の画像データセット

EMNIST:手書きアルファベット&数字の画像データセット

データセット「EMNIST」について説明。81万枚〜7万枚の手書きアルファベットおよび数字の「画像+ラベル」データが無料でダウンロードでき、画像認識などのディープラーニングに利用できる。PyPIパッケージ、TensorFlow、PyTorchにおける利用コードも紹介。