4峴偱儌僨儖峔抸偲梊應偑偱偒傞AutoML OSS偺榁曑乽auto-sklearn乿丗AutoML OSS擖栧乮2乯乮1/3 儁乕僕乯

AutoML OSS傪徯夘偡傞杮楢嵹戞2夞偼丄AutoML OSS偺榁曑偲傕偄偊傞乽auto-sklearn乿傪夝愢偟傑偡丅auto-sklearn偼丄scikit-learn傪奼挘偟偨宍偱丄岠棪揑側儀僀僘嵟揔壔庤朄傪梡偄偨AutoML婡擻傪採嫙偡傞僣乕儖偱偡丅

杮婰帠偱徯夘偟偨僲乕僩僽僢僋偼GitHub偵偰岞奐偟偰偄傑偡丅偡偖偵幚峴偱偒傑偡偺偱丄偤傂偛棙梡偔偩偝偄丅

丂杮楢嵹戞1夞偱偼丄偦傕偦傕AutoML偲偼偳偆偄偆傕偺偱丄偳偆偄偭偨婡擻傗儊儕僢僩偑偁傞偺偐夝愢偟傑偟偨丅戞2夞偐傜偼AutoML OSS乮僆乕僾儞僜乕僗僜僼僩僂僃傾乯傪堦偮偢偮徯夘偟偰偄偒傑偡丅崱夞徯夘偡傞偺偼丄AutoML OSS偺榁曑偲傕偄偊傞乽auto-sklearn乿偱偡丅

auto-sklearn偲偼

丂auto-sklearn偼2016擭5寧偵GitHub儕億僕僩儕偑嶌惉偝傟偰偐傜AutoML傪儕乕僪偟偰偒偨OSS偺堦偮偱偡丅Matthias Feurer巵傜偑2015擭偵岞奐偟偨榑暥乽Efficient and Robust Automated Machine Learning乿偑儀乕僗偵側偭偰偄傑偡丅

| 奐敪尦 | 傾儖儀儖僩丒儖乕僩償傿僸戝妛僼儔僀僽儖僋 |

|---|---|

| GitHub岞奐擔 | 2016擭5寧 |

| 儕億僕僩儕 | https://github.com/automl/auto-sklearn |

| 幚憰尵岅 | Python |

| 儔僀僙儞僗 | 嶰忦崁BSD儔僀僙儞僗乮scikit-learn偲摨偠乯 |

| 岞幃僒僀僩 | https://automl.github.io/auto-sklearn/master/ |

| 昞1 auto-sklearn偺婎杮忣曬 | |

丂auto-sklearn偼丄Python偺婡夿妛廗儔僀僽儔儕偱偁傞scikit-learn偵娷傑傟傞慜張棟傗梊應儌僨儖側偳偐傜丄擖椡僨乕僞偵揔偟偨傕偺傪惂尷偝傟偨寁嶼儕僜乕僗偺拞偱帺摦揑偵慖戰偟傑偡丅偝傜偵丄岠棪揑側儀僀僘嵟揔壔庤朄傪梡偄偰僴僀僷乕僷儔儊乕僞乕傕帺摦寛掕偟傑偡丅偙傟偵傛傝丄儐乕僓乕傪傾儖僑儕僘儉偺慖戰偲僴僀僷乕僷儔儊乕僞乕偺挷惍偐傜夝曻偟偰偔傟傑偡丅

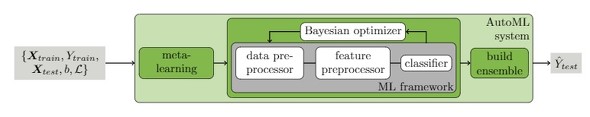

丂auto-sklearn偺傾乕僉僥僋僠儍傪恾1偵帵偟傑偡丅auto-sklearn偺帺摦壔晹暘偼丄恾拞偺AutoML system偺晹暘偵奩摉偟傑偡丅

恾1 auto-sklearn偺傾乕僉僥僋僠儍乮弌揟: http://papers.nips.cc/paper/5872-efficient-and-robust-automated-machine-learning.pdf乯

丂auto-sklearn偺傾乕僉僥僋僠儍偼丄儊僞妛廗丄儀僀僘嵟揔壔丄傾儞僒儞僽儖峔抸偺3偮偺僼僃乕僘偱峔惉偝傟偰偄傑偡丅

- 儊僞妛廗

- OpenML偱棙梡壜擻側140屄偺僨乕僞僙僢僩偺拞偐傜擖椡偝傟偨僨乕僞僙僢僩偲椶帡偺僨乕僞僙僢僩傪慖掕偟丄偙偺僨乕僞僙僢僩偵揔偟偨ML乮婡夿妛廗乯僼儗乕儉儚乕僋乮慜張棟丄梊應儌僨儖乯偺岓曗傪慖戰偡傞丅椶帡惈偺敾掕偵偼38庬椶偺儊僞摿挜乮梫栺摑寁検丄師尦埑弅偵娭楢偡傞検傗僄儞僩儘僺乕側偳乯傪梡偄傞

- 儀僀僘嵟揔壔

- 儊僞妛廗僼僃乕僘偱慖戰偝傟偨ML僼儗乕儉儚乕僋孮傪張棟偟丄儀僀僘嵟揔壔偺庤朄傪梡偄偰僴僀僷乕僷儔儊乕僞乕傪寛掕偡傞

- 傾儞僒儞僽儖峔抸

- 儀僀僘嵟揔壔僼僃乕僘偱嶼弌偟偨寢壥傪曐懚偟偰偍偒丄傾儞僒儞僽儖暯嬒傪庢傞丅扨弮側懌偟崌傢偣暯嬒偱偼側偔丄惛搙岦忋偵岠壥偑偁傞傛偆偵廳傒傪嵟揔壔偟偰傾儞僒儞僽儖儌僨儖傪峔抸偡傞

丂auto-sklearn偱偼丄儊僞妛廗偲傾儞僒儞僽儖峔抸傪摫擖偡傞偙偲偵傛傝丄AutoML傾僾儘乕僠偺岠棪惈偲寴楽乮偗傫傠偆乯惈傪岦忋偝偣偰偄傑偡丅

庡側摿挜

丂auto-sklearn偵偼師偺傛偆側摿挜偑偁傝傑偡丅

- 偨偭偨4峴偺僐乕僪偱儌僨儖偺峔抸偐傜梊應傑偱壜擻

- 儊僞妛廗偺摫擖

- 惂尷偝傟偨扵嶕帪娫傗儊儌儕巊梡検偺拞偱帺摦慖戰

丂偦傟偧傟偺摿挜傪傕偆彮偟徻偟偔尒偰偄偒傑偟傚偆丅

偨偭偨4峴偺僐乕僪偱儌僨儖偺峔抸偐傜梊應傑偱壜擻

丂AutoML婡擻傪桳偡傞OSS偼丄偳傟傕婎杮揑偵偼娙扨側僐乕僪偱棙梡偱偒傞傛偆偵側偭偰偄傑偡丅岞奐偝傟偨2016擭摉帪偺婡夿妛廗偱昁梫側僐乕僪偺幚憰検傪摜傑偊傞偲丄auto-sklearn偼旕忢偵娙扨側僐乕僪偱妛廗傗梊應偑偱偒傞偙偲偑摿挜偺堦偮偲偄偊傑偡乮auto-sklearn偺僐乕僪偺嬶懱椺偼師偺復偱愢柧偟傑偡乯丅

import autosklearn.classification cls = autosklearn.classification.AutoSklearnClassifier() # 妛廗 cls.fit(X_train, y_train) # 梊應 predictions = cls.predict(X_test)

儊僞妛廗偺摫擖

丂婡夿妛廗儌僨儖傪帺摦揑偵峔抸偡傞応崌丄僨乕僞慜張棟丄摿挜検慜張棟丄暘椶婍丄僴僀僷乕僷儔儊乕僞乕偺僠儏乕僯儞僌偲偄偭偨朿戝側慖戰巿傪扵嶕偡傞昁梫偑偁傝傑偡丅偟偐偟丄幚嵺偵偼CPU傗儊儌儕巊梡検側偳寁嶼儕僜乕僗偺惂栺偺拞偱岠棪揑偵偱偒傞偩偗椙偄儌僨儖傪扵嶕偡傞偙偲偑傎偲傫偳偱偡丅

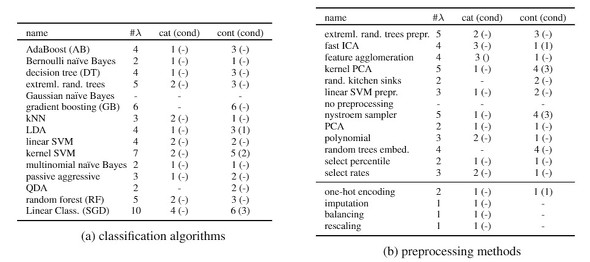

丂auto-sklearn偱偼丄慜弎偺傾乕僉僥僋僠儍偱徯夘偟偨儊僞妛廗傪摫擖偟丄扵嶕傪岠棪壔偟偰偄傑偡丅15庬椶偺暘椶婍丄14庬椶偺摿挜検慜張棟丄4庬椶偺僨乕僞慜張棟傪巊梡偟偰丄110屄偺僴僀僷乕僷儔儊乕僞乕傪帩偮峔憿壔偝傟偨壖愢嬻娫傪惗惉偟丄岠棪揑側儀僀僘嵟揔壔庤朄傪梡偄偰僴僀僷乕僷儔儊乕僞乕傪寛掕偟傑偡丅

丂恾2偼丄auto-sklearn偺榑暥偵宖嵹偝傟偰偄傞暘椶傾儖僑儕僘儉偲慜張棟庤朄偺堦棗偱偡丅

恾2 暘椶傾儖僑儕僘儉偍傛傃慜張棟庤朄偺堦棗乮弌揟:http://papers.nips.cc/paper/5872-efficient-and-robust-automated-machine-learning.pdf乯

惂尷偝傟偨扵嶕帪娫傗儊儌儕巊梡検偺拞偱帺摦慖戰

丂auto-sklearn偼丄儐乕僓乕偑巜掕偟偨寁嶼儕僜乕僗偺惂尷偺拞偱丄嵟揔側傾儖僑儕僘儉傪慖掕偟僴僀僷乕僷儔儊乕僞乕傪帺摦偱寛掕偟傑偡丅

丂昞2偵丄儊儌儕巊梡検傗惂尷帪娫偺僷儔儊乕僞乕偩偗偱側偔丄auto-sklearn儌僨儖偺僀儞僗僞儞僗惗惉帪偵巜掕偱偒傞僷儔儊乕僞乕偺堦晹傪徯夘偟傑偡丅

| 僷儔儊乕僞乕柤 | 僨僼僅儖僩抣 | 愢柧 |

|---|---|---|

| time_left_for_this_task | 3600 | 儌僨儖傪扵嶕偡傞偨傔偺惂尷帪娫乮昩扨埵乯丅偙偺抣傪憹傗偡偙偲偵傛傝丄傛傝椙偄儌僨儖傪尒偮偗傞壜擻惈偑憹偡 |

| per_run_time_limit | time_left_for_this_task偺1/10 | 1夞偺屇傃弌偟偺帪娫惂尷乮昩扨埵乯丅妛廗傾儖僑儕僘儉偑惂尷帪娫傪墇偊偰幚峴偝傟傞偲丄儌僨儖偺僼傿僢僥傿儞僌偑廔椆 |

| memory_limit | 3072 | 婡夿妛廗傾儖僑儕僘儉偺儊儌儕惂尷乮MB扨埵乯丅儊儌儕惂尷傪墇偊偰妱傝摉偰傛偆偲偡傞偲丄僼傿僢僥傿儞僌偑廔椆丅None偺応崌丄儊儌儕惂尷側偟 |

| ensemble_size | 50 | 傾儞僒儞僽儖傪偝偣傞儌僨儖偺嵟戝悢丅0傪僙僢僩偡傞偲丄傾儞僒儞僽儖傪偟側偄 |

| ensemble_nbest | 50 | 儐乕僓乕偑傾儞僒儞僽儖偱峫椂偝傟傞儌僨儖悢傪捈愙巜掕 |

| include_estimators | None | None偺応崌丄慡偰偺悇掕婍傪巊梡丅偦傟埲奜偺応崌偼丄巊梡偡傞悇掕婍偺僙僢僩傪巜掕 |

| exclude_estimators | None | None偺応崌丄慡偰偺悇掕婍傪巊梡丅偦傟埲奜偺応崌偼丄巊梡偟側偄悇掕婍偺僙僢僩傪巜掕 |

| include_preprocessors | None | None偺応崌丄慡偰偺僾儕僾儘僙僢僒傪巊梡丅偦傟埲奜偺応崌丄巊梡偡傞僾儕僾儘僙僢僒偺僙僢僩傪巜掕 |

| exclude_preprocessors | None | None偺応崌丄慡偰偺僾儕僾儘僙僢僒傪巊梡丅偦傟埲奜偺応崌丄巊梡偟側偄僾儕僾儘僙僢僒偺僙僢僩傪巜掕 |

| 昞2 僷儔儊乕僞乕偺堦椺 | ||

丂懠偵傕暋悢偺僷儔儊乕僞乕偑偁傝傑偡丅徻偟偔偼岞幃僪僉儏儊儞僩嶲徠偟偰偔偩偝偄丅

Copyright © ITmedia, Inc. All Rights Reserved.