NHKテクノロジーズ、コンテンツ制作関連のさまざまなシステムをAIで監視するシステムを開発:羽ばたけ!ネットワークエンジニア(62)

NHKテクノロジーズはコンテンツ制作を支えるシステム群をAIで効率的に監視するシステムを開発した。各システムの監視装置とAI監視システムのインタフェースとしてモニターの「映像」を使うユニークな仕組みだ。

「NHKテクノロジーズ」(本社:東京、社員数 約2000人)は「NHK」(日本放送協会)の制作技術を担う会社で、番組制作、コンテンツ送出、情報システムの維持管理、放送電波の送受信環境整備など放送に関わる技術業務全般を行っている。同社のデジタル開発技術本部 報道システム運用部(岡田俊一部長)は、コンテンツ制作関連のさまざまなシステムの運用監視を行っている。

NHKのコンテンツ制作を支えるシステムとAI監視システムの狙い

NHKのコンテンツを支えるシステムは多岐にわたり、その運用監視は監視センターで24時間365日行われている。大型の4Kモニター3台に各システムの監視画面が表示される。一度に全システムは表示できないため画面はスクロールしている。

従来の監視業務は、モニターに障害(エラーメッセージ)が表示されると手元のPCに拡大表示して詳細情報を確認→キーワードで過去の障害データベースを検索し対応策を検討→対応→対応内容を障害データベースに記録、という流れでやっていた。

複数のアラームの中からどのワードを選んで障害データベースを検索すればいいのか、検索結果としてどれを参考にすべきか、といった判断が経験の浅い担当者には難しかった。また経験者であっても時間がかかることがあった。そこで、運用監視業務を迅速かつ的確に行い、スキルの高低にかかわらず誰でも簡単に運用監視業務ができるようにするため、多数の監視装置をAIによる監視システムに一元化することにした。

監視モニターの「映像」をAI監視システムの共通インタフェースに

AI監視システムに一元化する上での問題点は、ネットワークがシステムごとに別々、監視装置もシステムの数だけあってインタフェースがバラバラということだ。

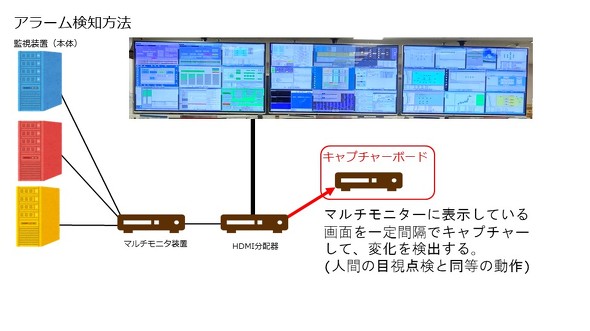

その解決策として「人間が大型のモニターを監視しているのと同様にAIにモニター画面を監視してもらう」というアイデアを思い付いた。

図1のように複数のシステムの監視画面を一定時間間隔でキャプチャーし、前後の画面の差異を障害の発生として認識する。それをAIへの入力として使うのだ。この方法だと各監視装置も、ネットワークも何の手も加えず、そのまま利用できる。

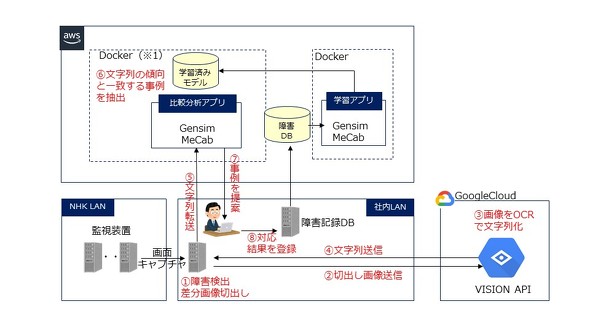

図2は、AI監視システムの概要構成だ。画像からの文字列抽出にはGoogleのVISION API(※2)を使用している。障害データベースから学習済みモデルを作成する「学習アプリ」や発生した障害への対応に有用な事例を抽出する「比較分析アプリ」はGensim(※3)やMeCab(※4)を使って開発されている。

学習アプリは過去約10年分の障害記録から学習済みモデルを作成している。障害が発生したときの流れは、図中の丸数字の通りだ。

- 一定時間間隔で取っている監視装置の画面キャプチャーで前画面との差異があると障害の発生として検知し、差分画像を切り出す

- 切り出した画像をVISION APIに送信

- 画像を文字列化

- 文字列を送信

- 文字列を比較分析アプリへ転送

- 文字列の傾向と一致する事例を学習済みモデルから優先順位を付けて抽出

- 抽出した事例を対応者に提案

開発のいきさつと今後

AI監視システムは最初のバージョンが2022年3月に完成し、その後のテストで有効な事例が表示されることを確認できた。2022年4月以降はアラームの重要度や緊急性の表示機能を追加するとともに、OCR認識率の向上などの改善を進めた。現在は製品としての実用化を目指して開発を継続している。

筆者がNHKテクノロジーズのAI監視システムへの取り組みから学んだことは、AIの専門家でなくてもサービス(VISION API)やオープンソースのライブラリ(Gensim=自然言語処理ライブラリ)を使って比較的簡単にAI応用システムを作れるようになったということだ。ただ、実用レベルまで持っていくには時間と費用がかかるようだ。実力のある企業が実用化し、それをサービスや製品として多くの企業で利用する、というモデルがいいのかもしれない。NHKテクノロジーズのAI監視システムがそのようなモデルとして成功することを期待している。

筆者紹介

松田次博(まつだ つぐひろ)

情報化研究会(http://www2j.biglobe.ne.jp/~ClearTK/)主宰。情報化研究会は情報通信に携わる人の勉強と交流を目的に1984年4月に発足。

IP電話ブームのきっかけとなった「東京ガス・IP電話」、企業と公衆無線LAN事業者がネットワークをシェアする「ツルハ・モデル」など、最新の技術やアイデアを生かした企業ネットワークの構築に豊富な実績がある。本コラムを加筆再構成した『新視点で設計する 企業ネットワーク高度化教本』(2020年7月、技術評論社刊)、『自分主義 営業とプロマネを楽しむ30のヒント』(2015年、日経BP社刊)はじめ多数の著書がある。

東京大学経済学部卒。NTTデータ(法人システム事業本部ネットワーク企画ビジネスユニット長など歴任、2007年NTTデータ プリンシパルITスペシャリスト認定)、NEC(デジタルネットワーク事業部エグゼクティブエキスパート等)を経て、2021年4月に独立し、大手企業のネットワーク関連プロジェクトの支援、コンサルに従事。新しい企業ネットワークのモデル(事例)作りに貢献することを目標としている。連絡先メールアドレスはtuguhiro@mti.biglobe.ne.jp。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

AIで人を画像認識して走ってくるロボット犬を作ってみよう

AIで人を画像認識して走ってくるロボット犬を作ってみよう

MobileNetV2-SSDモデルを使って「人」を物体検知して、その人が居る場所に向かって走って近づくロボット子犬を作成。ROS(ロボット用OS)を使用することで、非常に簡単に実現できる。 雨天や夜間の見にくい画像、視認性を高める新手法をシンガポールの研究者が開発

雨天や夜間の見にくい画像、視認性を高める新手法をシンガポールの研究者が開発

雨天や夜間に撮影した画像には課題がある。視認性が悪いからだ。シンガポールの大学の研究者がこれを改善する新手法を開発した。併せて、複数人が重なって見える画像から姿勢を推定する精度の高い手法も公開した。 「Gensim」による機械学習を使った自然言語分析の基本――「NLTK」「潜在的ディリクレ配分法(LDA)」「Word2vec」とは

「Gensim」による機械学習を使った自然言語分析の基本――「NLTK」「潜在的ディリクレ配分法(LDA)」「Word2vec」とは

最近流行の機械学習/Deep Learningを試してみたいという人のために、Pythonを使った機械学習について主要なライブラリ/ツールの使い方を中心に解説する連載。今回は機械学習を使った自然言語分析のライブラリ「Gensim」について解説します。 Stable diffusionから派生した画像生成AI「stablediffusion-infinity」と「Waifu Diffusion」違いはどこ? 使い方も紹介

Stable diffusionから派生した画像生成AI「stablediffusion-infinity」と「Waifu Diffusion」違いはどこ? 使い方も紹介

画像生成AI「Stable diffusion」の公開後、これを基にした画像生成AIが多数発表されている。Stable diffusionの派生AI、「stablediffusion-infinity」「Waifu Diffusion」の2つを紹介する。