AIエージェントの「スキル」の品質低下を防ぐ? テストと検証機能を強化:マルチエージェントで並列評価を実現

Anthropicは、AIアシスタント「Claude」の動作を拡張するAgent Skills作成ツール「skill-creator」に評価機能とベンチマーク機能を追加した。スキル作成者がコードを書かずにスキルの動作検証や品質を測定できるという。

Anthropicは2026年3月、AI(人工知能)アシスタント「Claude」向けAgent Skillsの作成ツール「skill-creator」の大幅な機能強化を発表した。

Agent Skillsは、ユーザーの指示やメタデータ、スクリプト、テンプレートなどをひとまとめにし、特定のタスクをより適切に実行できるようにする仕組みだ。

skill-creatorの新機能はWeb版の「Claude.ai」とデスクトップ版「Cowork」で利用可能で、開発者向けコーディング支援ツール「Claude Code」のプラグインとしても提供されている。

多くの非エンジニアが業務特化のAgent Skillsを構築

Anthropicによると、2025年10月にAgent Skills機能を公開して以来、スキル作成者の多くはエンジニアではなく、特定の業務分野の専門家だったことが判明したという。

一方、非エンジニアの多くは自身のワークフローについて熟知しているものの、Agent Skillsの作成において次のような課題を抱えていた。

- 新しいモデルでスキルが正常に動作するかどうか分からない

- スキルが適切なタイミングでトリガーしているかどうか分かりにくい

- 編集後に改善されたかどうかを確認する手段が不足している

Agent Skills機能強化の目的は、ソフトウェア開発で一般的な手法(テスト、ベンチマーク、反復改善)をスキル作成プロセスに導入することだ。これにより、コードを一切書くことなく、これらの手法を実践できるようになる。

2種類のスキル分類

Anthropicは、Agent Skillsを大きく2種類に分類している。

- 機能向上スキル

- 基本モデルができない、または安定してできないことを支援する。ドキュメント作成スキルなどが該当する

- ワークフロー設定スキル

- Claudeの作業をチームのワークフローに合わせて順序付けるスキル。秘密保持契約(NDA)のレビューや週次レポート作成などが該当する

この区別はテストの目的に関係する。機能向上スキルはモデルの改善により不要になる可能性があり、評価によりその時期を把握できる。一方、ワークフロー設定スキルは持続性が高いものの、ワークフローとの整合性が価値を決める。

評価機能でリグレッションを検出

skill-creatorは評価の作成を支援する。評価とは、指定したプロンプトに対してClaudeが期待通りに動作するかどうかを確認するテストだ。テストプロンプトと必要なファイルを定義し、良い結果の基準を記述すると、スキルが正常に機能するかどうかを判定する。

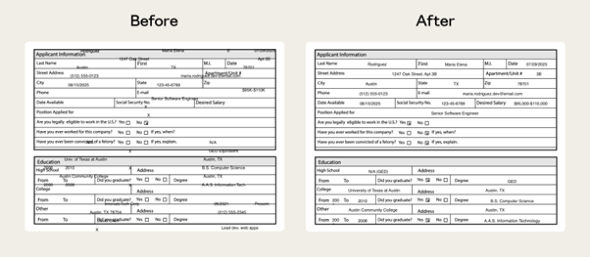

skill-creatorの評価機能を活用してPDFスキルを改善した例。左(Before)ではフォームへの対応が不完全だったが、右(After)では正確な位置にテキストが入力されている(提供:Anthropic)

評価機能は主に2つの用途がある。

- モデル更新などによるスキル品質の低下(リグレッション)の検出

- モデルやインフラの進化に伴うスキルの動作変化を早期に発見できる

- モデル能力の進歩によるスキルの不要化の確認

- スキルなしでも基本モデルが評価に合格するようになれば、そのスキルの手法がモデルのデフォルト(既定)動作に組み込まれた可能性を示す

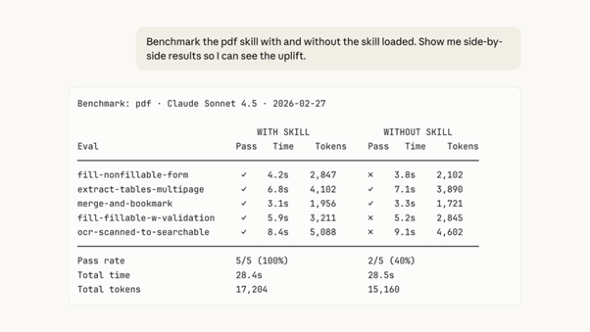

ベンチマークモードも追加され、評価の合格率、経過時間、トークン使用量を追跡できる。

ベンチマークモードの実行結果例。PDFスキルを有効にした場合(WITH SKILL)は合格率100%、無効時(WITHOUT SKILL)は40%と、スキルの効果が数値で可視化される(提供:Anthropic)

マルチエージェントで並列評価を実現

skill-creatorは、評価を並列実行するマルチエージェント機能も備える。評価を順次実行すると時間がかかり、コンテキストがテスト間で混在する可能性がある。skill-creatorは独立したエージェントを起動して評価を並列実行できるようになった。各エージェントはクリーンなコンテキストで動作し、独自のトークンとタイミング指標を持つ。

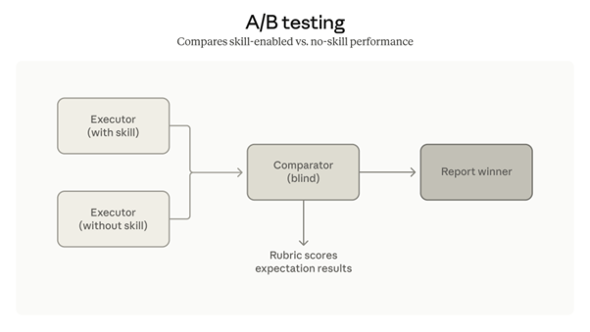

さらに、比較エージェント機能も追加され、2つのスキルバージョン、またはスキルありとスキルなしのA/Bテストが可能になった。どちらの出力かを知らない状態で判定するため、変更が改善につながったかどうかを客観的に確認できる。

スキルのトリガー精度を向上

スキル数が増えると、説明文の精度が重要になる。説明が広すぎると誤ったトリガーが増え、狭すぎるとスキルがトリガーされない。skill-creatorはサンプルプロンプトに対して現在の説明を分析し、誤検出と検出漏れの両方を減らす編集を提案する。Anthropicはドキュメント作成スキル群で同機能を実行し、公開スキル6件中5件でトリガー精度が向上したという。

将来は「スキル」と「仕様」の境界が曖昧に

現在、Agent Skillsは「SKILL.md」にタスクの遂行手順を詳細に記述する必要がある。Anthropicは今後、AIモデルの進化によって「スキル」と「仕様」の境界が曖昧になる可能性があると指摘する。

「将来的には、自然言語で『何をすべきか』を記述するだけで、モデルが実装方法を判断するようになる可能性がある。今回リリースした評価フレームワークは、仕様駆動開発モデルへの移行を見据えた際の基盤になる」と、Anthropicは述べている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

AIがバラバラなUIを作る問題、これで解決? Google提唱の新標準「DESIGN.md」とは

AIがバラバラなUIを作る問題、これで解決? Google提唱の新標準「DESIGN.md」とは

AIが作るUIは、毎回デザインがバラバラになることがある。この課題を解決するかもしれない新標準が登場した。Googleが提唱する「DESIGN.md」の概要と書き方、AIコーディングにおける.mdファイル運用に関する筆者の考え、さらに開発者コミュニティーでの広がりをまとめる。 ホントに役立つスキルを作るには? AnthropicがAIエージェントで使うスキルの構築ガイドを公開

ホントに役立つスキルを作るには? AnthropicがAIエージェントで使うスキルの構築ガイドを公開

何らかのワークフローや定型処理の手順、それに必要な情報をAIエージェントに持たせる「スキル」の構築方法について、Anthropicが公式ガイドを公開した。実際に役に立つスキルを作りたいのなら、このガイドがその第一歩になるかもしれませんよ。 【入門】.claudeフォルダの構造と使い方 Claude Codeを思い通りに動かそう

【入門】.claudeフォルダの構造と使い方 Claude Codeを思い通りに動かそう

Claude Codeを使い始めたものの、プロジェクト内に生成される「.claude」フォルダをそのままにしていませんか? 実はこのフォルダこそが、Claude Codeの振る舞いを決定づける重要なポイントです。このフォルダの構造と役割を整理し、初心者の方でも理解できるように解説します。 Google「Antigravity」「Gemini CLI」の違いは? IDE型、CLI型で分かれる開発体験

Google「Antigravity」「Gemini CLI」の違いは? IDE型、CLI型で分かれる開発体験

Googleは「Antigravity」と「Gemini CLI」の選び方を解説するブログ記事を公開した。IDE型の統合環境を重視するか、CLIベースの自動化を重視するかで選択が分かれるという。 Claudeの「Agent Skills」がMCPと同様、オープン標準に どんな便利スキルがある?

Claudeの「Agent Skills」がMCPと同様、オープン標準に どんな便利スキルがある?

Anthropicは、「Claude」の「Agent Skills」機能をアップデートし、オープン標準として公開した。 生成AIの「弱点」をどう補う? AIエージェント時代に変化するデータベースの役割

生成AIの「弱点」をどう補う? AIエージェント時代に変化するデータベースの役割

チャットbotから自律型の「AIエージェント」へと、企業での生成AI活用が新たなフェーズに進みつつある。こうした中で、データベース領域にも大きな変化を予感させる動きが出始めている。なぜ今、データベースの重要性が高まっているのか。