ブラウン大学の研究チーム、錯視を起こすニューラルモデルを構築:顔や標識をより認識しやすくなるアルゴリズム

ブラウン大学の研究チームは視覚系の研究の一環として、人間のように錯視を起こすニューラルネットワークコンピュータモデルを構築している。一般的なディープラーニングのアルゴリズムに含まれていない要素を取り入れたことで成果を得た形だ。

米ブラウン大学は2018年9月21日(米国時間)、同大学のコンピュータビジョン研究チームによる目の錯覚(錯視)に関する研究成果を発表した。

この研究は、“文脈効果”(context-dependent optical illusion)に起因するタイプの錯視について、神経メカニズムを解明することを目的に行われた。

文脈効果とは、空間的または時間的に前後となる刺激の影響によって、ある(視覚)刺激の知覚の内容が変化してしまう現象。

研究者は次のように述べている。「錯視は、『バグではなく機能』だというコンセンサスができつつある。錯視はわれわれの視覚系のエッジケースかもしれないが、われわれの視覚は、日常生活における物体の識別に関しては非常に強力だ」

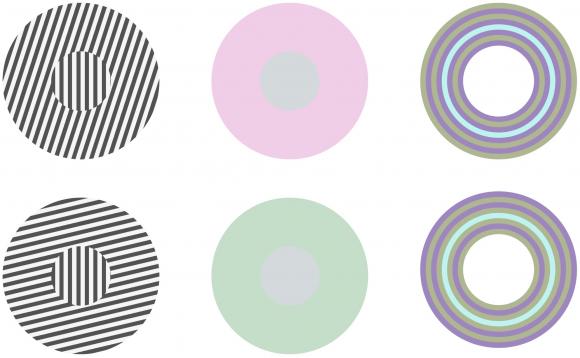

研究で用いた文脈依存型の錯視の例 中央の例では外周円の色が文脈となって、内周の円の色知覚が引きずられてしまう。右側の例では輝度の高い円が周囲の円の色知覚に影響を及ぼす(出典:Serre Lab/Brown University)

研究チームはまず、大脳視覚野の解剖学データと神経生理学データに基づいた計算モデルを作成した。このモデルを作成した目的は、複雑な刺激(例えば文脈効果による錯視を引き起こす画像)を受けたときに、近隣の皮質ニューロン(神経細胞)がどのように相互にメッセージを送信し、お互いの反応を調整するのかを明らかにすることだ。

ディープラーニングのアルゴリズムを改善できる可能性

研究チームはこのモデルにイノベーションを1つ盛り込んだ。特定パターンのフィードバック結合(水平結合)を、ニューロン間に設けたことだ。このフィードバック結合は、視覚的文脈に応じて中央ニューロンの反応を増減(促進または抑制)できる。

ほとんどのディープラーニングアルゴリズムは、レイヤー間のフィードフォワード結合しか含んでおらず、レイヤー内のニューロン間のフィードバック結合という要素は見られない。

モデルの作成後、研究チームは、文脈効果によってさまざまな錯視を引き起こす画像をモデルに入力した。さらに、促進的、抑制的フィードバック結合の強度を“チューニング”した。モデルのニューロンが、視覚野の神経生理学データと同様に反応するようにするためだ。

文脈効果によるさまざまな錯視画像でモデルを繰り返しテストした結果、モデルが人間のように錯視することを確認した。

「われわれのモデルは、文脈効果による錯視に関して、視覚野の働きを説明するのに必要十分なシンプルなものになっている。われわれは、神経生理学データを説明できるモデルからスタートし、人間の心理物理学データを予測することが可能になった」と研究者は述べている。

研究チームはこのモデルを基に、錯視のメカニズムの統一的な説明を提供するだけでなく、人工視覚の進化にも貢献したいと考えている。

研究者によると、最新の人工視覚アルゴリズム(顔のタグ付けや、停止標識の認識などに使われている)は、文脈の把握に苦戦している。研究チームは、文脈による錯視に基づいてチューニングされた水平結合を取り入れることで、この弱点に対処できると考えている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

視覚はどこまで他の感覚器官をだませるか―― 「おいしそう」の科学

視覚はどこまで他の感覚器官をだませるか―― 「おいしそう」の科学

ユーザー参加型の学会として発足し、毎回数万人規模の視聴者を集める「ニコニコ学会β」第5回シンポジウム。本稿では全体のハイライトとなった人間の感覚に注目したセッションを紹介する。 ロボットにDeep Learningを導入して画像認識の精度が向上すると、どう便利になるのか

ロボットにDeep Learningを導入して画像認識の精度が向上すると、どう便利になるのか

Pepperや自動運転車などの登場で、エンジニアではない一般の人にも身近になりつつある「ロボット」。ロボットには「人工知能/AI」を中心にさまざまなソフトウェア技術が使われている。本連載では、ソフトウェアとしてのロボットについて、基本的な用語からビジネスへの応用までを解説していく。今回は、Pepperで使われているDeep Learningを例に、精度が高い画像認識機能を持つロボットの利点を解説する。 雑然と置いた商品を一括で画像認識――NECが無人決済向け技術開発

雑然と置いた商品を一括で画像認識――NECが無人決済向け技術開発

NECは、小売店で決済時に必要な商品読み取りを大幅に効率化する画像認識技術を開発した。生鮮品や日配品、パッケージ品などが雑然と置かれていても一括認識できるという。