テキストから動画を生成できる動画生成AI「Gen-3 Alpha」を提供開始 Runway:映画のワンシーンのような動画を生成できる

Runwayは同社の動画生成AIの最新モデルとなる「Gen-3 Alpha」の提供を開始した。前世代モデルよりも忠実度、一貫性、動きの表現が大きく改善されているという。

スタートアップ企業のRunwayは2024年7月1日(米国時間、以下同)、6月17日に発表した同社の動画生成モデル「Gen-3 Alpha」の提供を開始した。

動画や画像データに基づきトレーニングされたGen-3 Alphaは、同社の前世代モデルである「Gen-2」よりも忠実度、一貫性、動きの表現が大きく改善されているという。

RunwayはGen-3 Alphaについて、同社が「General World Model(汎用世界モデル)」と呼ぶAIシステムの構築に向けた、大きな一歩になるとしている。

汎用世界モデルとは、ある環境の内部表現を構築し、環境内での将来の出来事をシミュレートするAIシステムのことだ。これまでの世界モデルの研究が、ビデオゲームのようなおもちゃのシミュレーションや、運転用の世界モデルの開発といった限定的な環境に焦点を当てていたのに対し、汎用世界モデルでは、現実世界で遭遇するような幅広い状況や相互作用を表現し、シミュレートすることを目的としている。

Runwayは「動画生成モデルは、汎用世界モデルのごく初期の限定された形と考えることができる。現実的な短い動画を生成するために、Gen-2では物理学と運動についてある程度の理解を深めてきたが、機能はまだ非常に限られており、とりわけ複雑なカメラや物体の動きに苦労している。汎用世界モデル構築のために、環境の状況を把握し、それに基づいて行動したり、行動を調整したりするようなモデルの構築を目指している」と述べている。

Gen-3 Alphaの特徴(7つの生成動画例)

Gen-3 Alphaは、RunwayのText to Video、Image to Video、Text to Imageツールを強化しているという。Motion Brush、Advanced Camera Controls、Director Modeなど既存のコントロールモードの他、構造やスタイル、モーションをよりきめ細かくコントロールするためのツールにも対応する。

Gen-3 Alphaは、新しく改良されたビジュアルモデレーションシステムとコンテンツの来歴証明技術「C2PA」など、新しい安全機能とともにリリースされている。

Gen-3 Alphaの特徴は以下の通り。

きめ細かな時間制御

Gen-3 Alphaは、非常に詳細で時間的に密度が高いキャプションでトレーニングされており、想像力豊かな遷移やシーン内の精密なキーフレーミングを可能にする。

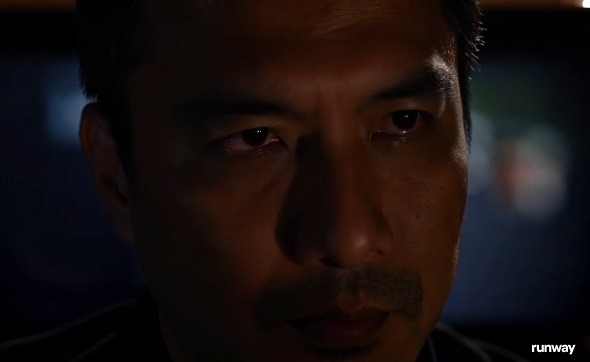

フォトリアリスティックな人物

Gen-3 Alphaは、幅広いアクション、ジェスチャー、感情を持つ表現力豊かな人間キャラクターを生成することに優れており、新たなストーリーテリングの機会を引き出す。

アーティストによる、アーティストのためのツール

Gen-3 Alphaのトレーニングは、研究者、エンジニア、アーティストの分野横断的なチームによる共同作業だった。幅広いスタイルと映画用語を解釈できるように設計されている。

業界向けカスタマイズ

Gen-3モデルファミリーの一部として、Runwayは、Gen-3のカスタムバージョンを作成するために、主要なエンターテイメントやメディアと協力し、パートナーシップを組んでいる。Gen-3モデルのカスタマイズは、キャラクターをよりスタイル面でコントロールでき、一貫性を持たせられる他、特定の芸術的・物語的な要件を満たせるなど、さまざまな機能を持つという。

Gen-3 Alphaを利用するには、スタンダード以上のプランを契約する必要がある。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Microsoft、1枚の写真と音声から本当に話しているかのような動画を生成するAIモデル「VASA-1」を発表

Microsoft、1枚の写真と音声から本当に話しているかのような動画を生成するAIモデル「VASA-1」を発表

Microsoftは、1枚の顔の静止画像と音声クリップから、その顔の人物が本当に話しているかのような動画を生成できるAIモデル「VASA-1」を発表した。 OpenAI、動画生成AI「Sora」を発表 技術レポートで明かされる開発ビジョン、学習の仕組み、課題とは

OpenAI、動画生成AI「Sora」を発表 技術レポートで明かされる開発ビジョン、学習の仕組み、課題とは

OpenAIは、テキストから最大60秒の動画を生成するAIモデル「Sora」を発表した。 テキストからCADデータを自動生成する「Text-to-CAD」α版公開 Zoo

テキストからCADデータを自動生成する「Text-to-CAD」α版公開 Zoo

ZooはテキストデータからCADファイルを自動生成する「Text-to-CAD」のα版を公開した。