OpenAIの生成AIを悪用していた脅威アクターとは? OpenAIが脅威レポートの最新版を公開:どう悪用していたのか

OpenAIは、脅威インテリジェンスレポートの最新版「Influence and cyber operations: an update, October 2024」を発表した。OpenAIはレポートで、サイバーオペレーションを行っていた複数の脅威アクターと悪用の手口を明らかにしている。

OpenAIは2024年10月9日(米国時間)、同社の脅威インテリジェンスレポートの最新版「Influence and cyber operations: an update, October 2024」を発表した。

同レポートは、脅威アクターがどのようにOpenAIの生成AI(人工知能)を悪用しようとしているのか把握するため、2024年10月時点でOpenAIが阻止した活動を分析し、一連の脅威の傾向を特定したものだ。OpenAIによると、2024年初頭から同社の生成AIを悪用しようとしてきた世界中の20以上のサイバーオペレーションや「Deceptive network(欺瞞的なネットワーク)」を阻止してきたという。

OpenAIはレポートの中で、サイバーオペレーションを行っていた脅威アクターを次のように説明している。

OpenAIの生成AIを悪用していた脅威アクターとは? どう悪用していたのか

SweetSpecter

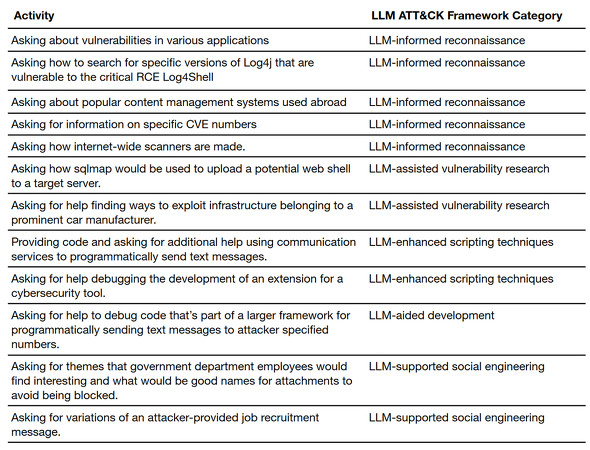

中国を拠点とする脅威アクター「SweetSpecter」は、OpenAIの生成AIを偵察、脆弱(ぜいじゃく)性調査、スクリプト支援、異常検出回避などに悪用していた。またOpenAIの従業員および会社のメールアドレスに対する「スピアフィッシング攻撃」(特定のメール受信者をだまして攻撃に加担させる手口)にも関与していた。

SweetSpecterは、ChatGPTのユーザーを装い、OpenAIの従業員にサポートを依頼するメールを送付していた。メールにはショートカットのlnkファイルが含まれる「some problems.zip」が添付されていた。このlnkファイルにはさまざまエラーやサービスメッセージが記載されたドキュメントを表示させるコードと、バックグラウンドで侵害したマシンを制御し、任意のコマンド実行、スクリーンショットの取得、データを漏えいさせるWindowsマルウェア「SugarGhost RAT」を復号、実行させるコードが含まれていた。

OpenAIのセキュリティチームは、スピアフィッシング攻撃の標的となった従業員と連絡を取り、既存のセキュリティ対策により、これらのメールの到達が阻止されていたことを確認した。さらに、このキャンペーンを支える広範なインフラを分析する中で、同一のインフラを利用してスクリプト作成、脆弱性調査のタスクを遂行しようとするChatGPTアカウントのクラスタを発見し、アカウントを停止させたという。

CyberAv3ngers

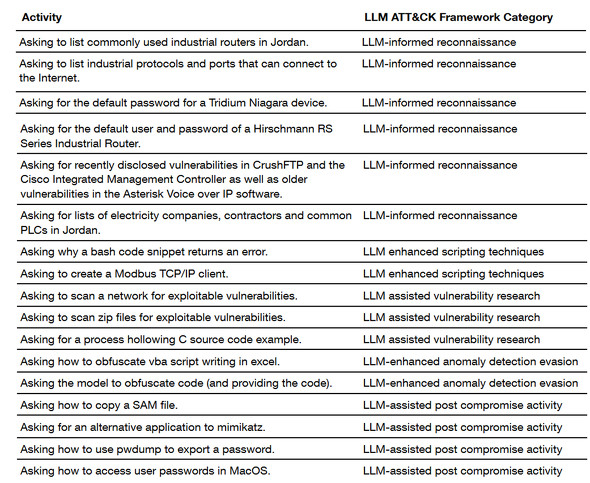

「CyberAv3ngers」は、イランのイスラム革命防衛隊に関連があるとみられる脅威アクターだ。水道、製造業、エネルギーシステムに用いられる産業用制御システム(ICS:Industrial Control Systems)やPLC(Programmable Logic Controller)の破壊活動で知られている。

CyberAv3ngersは、PLCの脆弱性調査やコードのデバッグ、スクリプト作成のアドバイスを得るため、OpenAIのモデルを悪用していた。PLCの初期設定のユーザー名/パスワードを求める質問や、最新の脆弱性に関する情報、ペンテスト用ツールやセキュリティサービスを用いて脆弱なインフラを自動的に発見するためのbash/Pythonスクリプトの作成、改善に関する支援、悪意のあるコードを難読化させる方法を尋ねていた。

OpenAIは、信頼できる情報筋からの評価に基づき、この脅威アクターにより運用されているアカウントを停止させた。

STORM-0817

「STORM-0817」はイランに拠点を置く脅威アクターだ。STORM-0817は、Androidマルウェアとそれに対応するC2(コマンド&コントロール)インフラの実装におけるデバッグやコーディング支援、Instagram用スクレイピングツールの作成におけるコーディング支援、LinkedInプロフィール文の翻訳にOpenAIのモデルを悪用していた。

OpenAIは、STORM-0817により運用されていると特定したアカウントを全て無効化し、業界パートナーに対して侵害の兆候(IOC)を共有した。

OpenAIは「インテリジェンス、調査、セキュリティ研究、セーフティ、ポリシーの各チームと連携し、脅威アクターが高度なモデルを危険な目的で悪用する可能性を予測し、適切な対策を講じる計画を推進する。内部のセキュリティチームと引き続き成果を共有し、主要なステークホルダーに学ぶべき点を伝え、同業者や広範な研究コミュニティーと協力して、安全性とセキュリティを強化していく」と述べている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

正規通信との区別はほぼ不可能な「偽のMicrosoftメール」に注意、「従来のセキュリティでは認識しにくい」のはなぜ? 対策は?

正規通信との区別はほぼ不可能な「偽のMicrosoftメール」に注意、「従来のセキュリティでは認識しにくい」のはなぜ? 対策は?

チェック・ポイント・ソフトウェア・テクノロジーズは、Microsoftの通知を装った5000通以上の偽メールを発見した。これらのメールは、ユーザーが正規の通信と区別することはほぼ不可能だという。 「GPT-4o」でファインチューニングが利用可能に 使い始めるには、事例は、セキュリティは?

「GPT-4o」でファインチューニングが利用可能に 使い始めるには、事例は、セキュリティは?

OpenAIは「GPT-4o」のファインチューニング機能の提供を開始した。コーディングやクリエイティブな執筆といったユースケースで、モデルの出力結果に大きな影響を与える可能性があるという。 2024年のサイバーセキュリティトレンド予測、ここでも生成AIがキーワードに Gartner

2024年のサイバーセキュリティトレンド予測、ここでも生成AIがキーワードに Gartner

Gartnerは2024年のサイバーセキュリティのトップトレンド予測を発表した。トップトレンドの推進要因として、「生成AI」「セキュリティ意識の低い従業員の行動」「サードパーティーのリスク」など6点を挙げた。