国産LLM「tsuzumi 2」提供開始 他社モデルをベースとせず、フルスクラッチで一から開発する理由:高性能と軽量化を両立

NTTは国産LLM「tsuzumi 2」の提供を開始した。超大規模モデルに匹敵する日本語性能と、1GPUでも動作可能な軽量化を両立させたという。

NTTは2025年10月20日、高性能な日本語処理能力を持つ国産LLM(大規模言語モデル)「tsuzumi 2」の提供を開始した。

tsuzumi 2は、2023年に同社が発表したLLM「tsuzumi」の次世代モデルだ。tsuzumi 2では、企業や自治体が保有する複雑なドキュメントに対する理解力や専門知識への対応力を向上させているという。

NTTは、tsuzumi 2の特徴について次のように説明している。

tsuzumi 2の4つの特徴

超大規模モデルに匹敵する日本語性能を実現

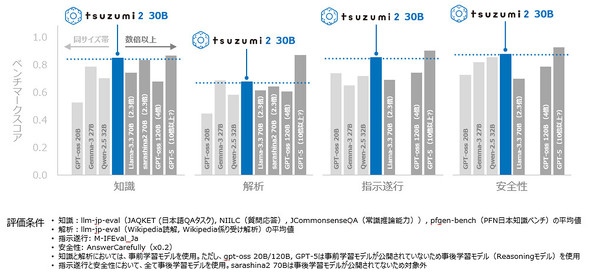

30B(300億)パラメーターのtsuzumi 2の日本語性能は、「gpt-oss-120b」(1200億パラメーター)や「Llama 3.3 70B」(700億パラメーター)といった超大規模モデルに匹敵する性能を実現しているという。

NTTが実施した公開ベンチマークを用いた評価によると、ビジネス領域で重視される「知識」「解析」「指示遂行」「安全性」の4項目において、超大規模モデルに匹敵するスコアを記録したという。

企業や業界に特化したモデル開発効率の向上

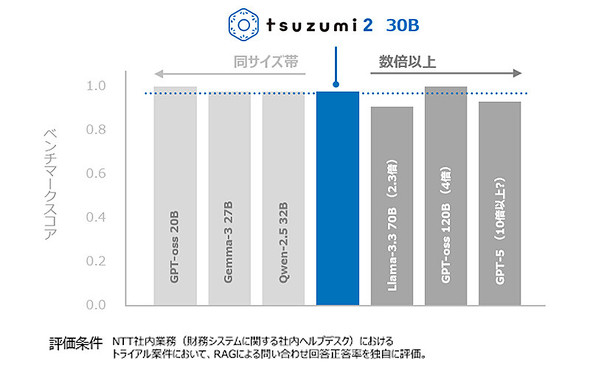

企業でのユースケースとして注目されているRAG(検索拡張生成)やファインチューニングによる企業、業界特化型モデルの開発効率が向上している。tsuzumi 2は、金融、医療、公共分野の知識をあらかじめ強化しており、これらの分野で高い性能を発揮するという。

NTT社内の財務システムに関する問い合わせ対応業務にRAGを活用した評価では、tsuzumi 2は「GPT-5」など大規模モデルと同等の性能を確認したという。

1GPUで動作可能

tsuzumi 2は40GB以下のメモリを保有したGPU1基での動作を想定して開発されている。これにより、API利用料の増大を懸念する高頻度利用のユースケースや、機微情報を扱うためのオンプレミス環境構築において、運用コストを抑えることができるという。

フルスクラッチ開発による信頼性確保

LLMの開発を巡っては、ニューヨーク・タイムズが同社の記事を無断で学習データに利用し著作権を侵害したとしてOpenAIやMicrosoftを提訴するなど、モデル開発過程の信頼性が厳しく問われつつあり、国内でも議論が活発化している。

NTTは「こうした問題を指摘されたモデルを使い続けることは利用者側も責任を問われかねない」と指摘。そこで、tsuzumi 2は他社のモデルをベースとせず、NTTが一からフルスクラッチ開発しているという。

「学習データを管理することにより、データの権利、品質、バイアスの制御が可能となる。モデルの信頼性を確保する上で極めて重要だ」と、NTTは述べている。

学習データの偏りがバイアスをもたらし、LLMの出力結果に悪影響を及ぼすリスクは、AI利用企業のコンプライアンスリスクにも直結する。生成AIの社会実装が進む今、モデルの性能面だけではなく、信頼性やリスク管理の観点もモデルを選定する上で重要な要素となるだろう。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

AWSユーザーで生成AIを使って社内情報活用 RAGの構築は難しくない

AWSユーザーで生成AIを使って社内情報活用 RAGの構築は難しくない

「RAG」という技術を使い、多くの企業が社内情報の活用に取り組んでいます。一方で、「難しそう」と尻込みしている人も多いのではないでしょうか。今回は利用者の多いAWSで、コードを書くことなく簡単にRAGを構築する方法を紹介します。 B200を384基まで利用可能 さくらインターネットのマネージドGPUクラスタサービス「さくらONE」とは

B200を384基まで利用可能 さくらインターネットのマネージドGPUクラスタサービス「さくらONE」とは

さくらインターネットが、GPUクラスタをマネージドサービスとして使える「さくらONE」というサービスを発表した。ユーザー組織は、構築や運用に手間をかけることなく大規模なクラスタを利用できる。本記事では、利用可能な構成を含めて新サービスを紹介する。 企業の「AI活用レベル」を6つの観点で可視化 NECがAI活用支援サービスを提供開始

企業の「AI活用レベル」を6つの観点で可視化 NECがAI活用支援サービスを提供開始

NECは、企業のAI活用を多面的に支援する新サービス「AIディスカバリープログラム+」の提供を開始した。6つの観点から戦略立案やガバナンス設計を支援し、全社的なAI導入の加速を目指すという。