情報漏えいは序章? AIエージェントが悪用される3つの深刻なシナリオ、Microsoftが解説:データベース変更のリスクも

Microsoftは公式ブログで、AIエージェントの普及によって新たなセキュリティリスクが生まれていると指摘。自律的に動作するAIエージェントがリスクをもたらす3つのシナリオを解説した。

AI(人工知能)エージェントは業務の効率化を前進させる存在であると同時に、以前には想定されていなかったリスクをもたらす存在にもなり得る。自律的に判断し、外部のデータやツールと連携するその仕組みは、利便性と引き換えに新たなセキュリティリスクを内包している。

Microsoftは2026年1月21日(米国時間)、公式セキュリティブログでAIエージェントがもたらす固有のセキュリティ課題について解説した。AIエージェントは従来のアプリケーションとは異なり、自ら推論し、意思決定を行い、ツールを呼び出し、ユーザーに代わって他のAIエージェントやシステムと連携して動作する。Microsoftは、この自律性は大きな可能性をもたらす一方、新たなリスクも生み出すとして、想定される3つのリスクシナリオを解説した。

AIエージェント悪用の“3つのシナリオ”

AIエージェントの攻撃対象領域は本質的に広い。AIエージェントはAIモデル、プラットフォーム、ツール、知識ソース、ガードレール(安全装置)、ID(アイデンティティー)管理など、複数の相互接続されたレイヤーで構成される。この多層アーキテクチャ全体で、プロンプトベースの攻撃、グラウンディング(検証可能な情報源にひも付ける仕組み)データの汚染、各種ツールの悪用など、さまざまな脅威が発生し得る。

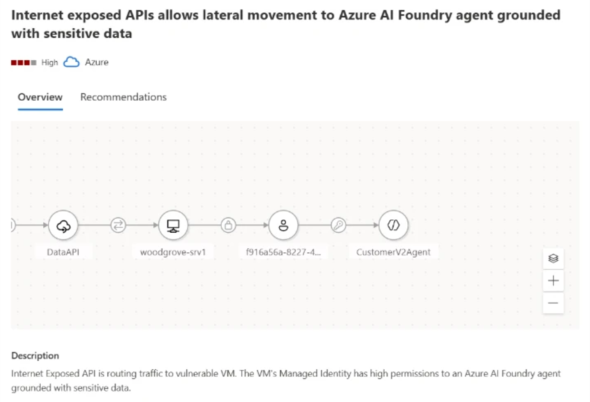

1.機密データに接続されたAIエージェントの悪用

AIエージェントは意図的に、あるいは設定ミスによって、PII(Personally Identifiable Information:個人を特定できる情報)を含む機密情報へのアクセス権を付与されることがある。こうしたAIエージェントは、顧客の取引記録や財務データの分析・処理といった内部業務での利用を想定して導入されることが多い。

攻撃者がこれらのAIエージェントを侵害した場合、本来組織外に出るべきでない機密情報にアクセスされる恐れがある。通常のデータベースに直接アクセスする場合は、アクセスログの取得や監視ツールによるトラフィックの可視化が比較的容易で、不審な操作も検知しやすい。一方、AIエージェントを経由したデータ流出は、正規の業務プロセスの一部として実行されるケースが多い。そのため、通常の業務トラフィックに紛れ込みやすく、検出するのが難しくなる。

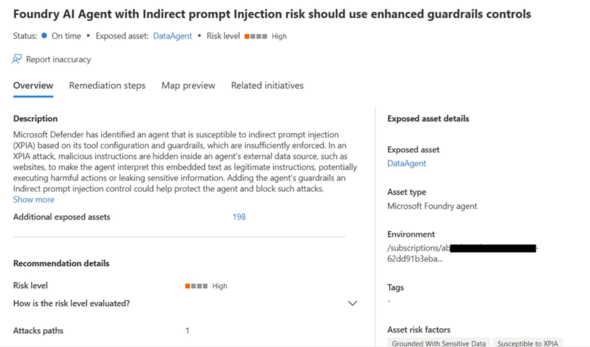

2.間接的プロンプトインジェクション攻撃による操作

AIエージェントはユーザーメッセージ、取得したドキュメント、サードパーティーAPI(アプリケーションプログラミングインタフェース)、各種データパイプラインなど外部データと頻繁にやりとりする。これらの入力は通常信頼できるものとして扱われるが、この仕組みを悪用するのが間接的プロンプトインジェクション攻撃(XPIA)と呼ばれるAI特有の攻撃だ。

直接的プロンプトインジェクションでは攻撃者がモデルに有害な指示を直接発行するが、XPIAでは攻撃者がAIエージェントが処理する外部データソース(ブラウザツールで取得したWebページや要約対象のメールなど)に悪意のある指示を埋め込む。AIエージェント自身はソースを信頼し、自律的に動作するため、不正操作やデータ流出につながる命令を知らずに取り込んで実行してしまう。

特に、XPIAは高い権限で操作を行うAIエージェントでは、被害が大きくなりやすい。例えば、以下のような操作が該当する。

- データベースの設定変更やレコードの更新・削除

- 業務システムにおけるワークフロー(業務手順を自動化した処理)のトリガー実行

- 顧客情報や財務情報などの機密データへのアクセス

- 複数システムにまたがる大規模な自律的アクションの実行

操作されたデータソースがAIエージェントの動作に影響を与え、不正アクセス、データ流出、内部システムの侵害につながる可能性がある。

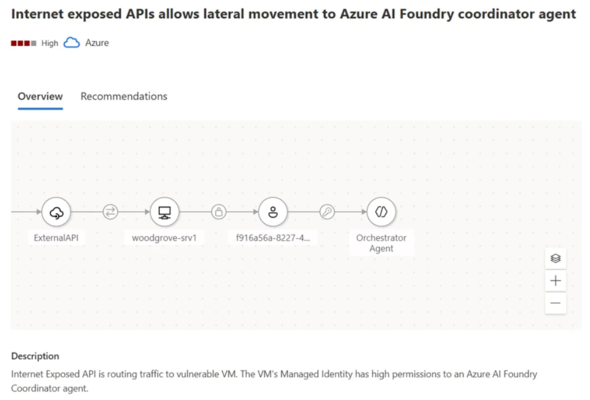

3.システム全体を制御する「コーディネーターエージェント」への侵害

複数のAIエージェントが連携する環境では、全てのAIエージェントが同じレベルのリスクを持つわけではない。狭いタスク固有の機能を処理するAIエージェントもあれば、複数のサブエージェントを管理・指揮するコーディネーターエージェントとして機能するものもある。

コーディネーターエージェントはシステム内の「司令塔」として機能するため特に重要だ。この司令塔となるAIエージェントが侵害されると、単一のワークフローだけでなく、その管理下にある全てのサブエージェントに影響が波及する。

さらにコーディネーターは、顧客との直接的なやりとりを担うケースもある。その場合、取り扱う情報の範囲や責任の所在が広がるため、セキュリティ上のリスクプロファイル(想定される脅威の種類や影響度を整理した評価)は一段と高まる。広範なアクセス権限と、顧客情報や機密データに触れる可能性が組み合わさることで、コーディネーターエージェントは攻撃者にとって非常に魅力的な標的となる。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

「Claude Cowork」にファイル流出の脆弱性 巧妙な間接的プロンプトインジェクションの具体的な中身

「Claude Cowork」にファイル流出の脆弱性 巧妙な間接的プロンプトインジェクションの具体的な中身

Anthropicが公開したAIエージェントのプレビュー版「Claude Cowork」に、ローカルファイル流出の脆弱性が存在することが分かった。巧妙な間接的プロンプトインジェクションを駆使しているという。 トークン破産、情報漏えい、LLM実行遅延――全部「AI Gateway」に任せよう 無料枠で学ぶAIエージェント開発、運用の新常識

トークン破産、情報漏えい、LLM実行遅延――全部「AI Gateway」に任せよう 無料枠で学ぶAIエージェント開発、運用の新常識

気軽に試せるラップトップ環境で、チャットbotを提供するオールインワンの生成AI環境構築から始め、Kubernetesを活用した本格的なGPUクラスタの構築やモデルのファインチューニングまで解説する本連載。今回は、LLMアプリケーション開発や運用で避けて通れない課題を、AI Gatewayで解決するアプローチを解説します。 「バイブコーディングが脆弱なコード量産」 99%の組織が直面 レビューや修正リリースを上回るペースで

「バイブコーディングが脆弱なコード量産」 99%の組織が直面 レビューや修正リリースを上回るペースで

パロアルトネットワークスは、世界10カ国の開発・情報セキュリティ部門を対象にした調査「クラウドセキュリティの現状2025」の結果を発表した。AIツールの進展により1日当たりのサイバー攻撃件数は1年間で230万件から約900万件へ急増したという。