Android開発に強いLLMは? Googleが公開、「Gemini 3.1 Pro」や「Claude Opus 4.6」の実力:評価対象はAndroid特有の開発タスク

Googleは、Android開発タスクにおけるLLMの性能を評価するベンチマーク「Android Bench」を公開した。GitHubで公開されているAndroidリポジトリから収集した実際の開発課題を基に構成されている。

Googleは2026年3月5日(米国時間)、モバイルOS「Android」の開発タスクにおける大規模言語モデル(LLM)の性能を評価するベンチマーク「Android Bench」を公開した。LLMを活用したAndroid開発の品質向上を目指し、モデル開発者に明確な評価基準を提供することが目的だ。

Android特有の開発タスクが評価対象

Android Benchは、GitHubで公開されているAndroidリポジトリから収集した実際の開発課題を基に構成されている。評価対象には、次のようなAndroid特有の開発タスクが含まれる。

- Androidリリース間の互換性問題の修正

- ウェアラブル端末向けネットワーク処理

- UIツールキット「Jetpack Compose」の最新バージョンへの移行

各評価では、LLMにタスクで報告された問題を修正させ、その結果をユニットテストまたはインストルメンテーションテスト(実機上で動作するUIテスト)で検証する。この手法により、LLMが複雑なコードベースを理解し、依存関係を把握して日常的な開発課題を解決できるかどうかを測定する。

「Gemini 3.1 Pro Preview」や「Claude Opus 4.6」の初回評価

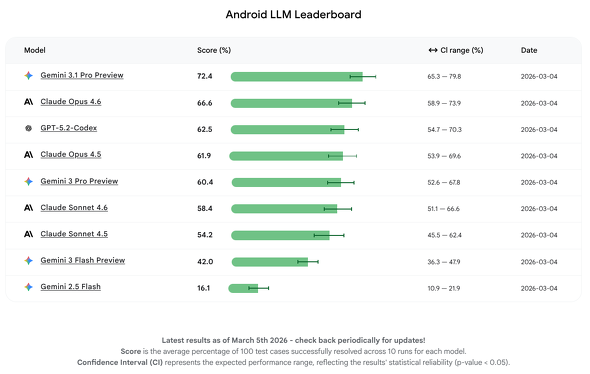

初回リリースでは、エージェント型機能やツール使用は評価対象外とし、LLM単体のコード生成能力を測定した。評価の結果、LLMがタスクを正常に完了できた割合は16〜72%だった。

初回評価で最高スコアを記録したのは「Gemini 3.1 Pro Preview」で72.4%、次いで「Claude Opus 4.6」が66.6%だった。

評価対象となったモデルは、Android統合開発環境「Android Studio」の最新安定版でAPIキーを使用することで試用できる。

評価の透明性の確保

Googleは、評価手法、データセット、テストハーネス(テスト実行環境)をGitHubで公開している。

公開ベンチマークでは、モデルがトレーニング中に評価タスクを学習してしまう「データ汚染」のリスクがある。これを防ぐため、Googleはエージェントの実行ログを手動でレビューし、トレーニングでの使用を抑制するための「カナリア文字列」(意図的に埋め込んだ検知用マーカー)を組み込むなどの対策を講じている。

Googleは今後、データセットの完全性を維持しながら手法を進化させ、タスクの量と複雑さを拡大していく予定だとしている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Gemini 3.1 Pro登場 思考モデルから実務エージェントへ、複雑タスクを完遂するAIに進化

Gemini 3.1 Pro登場 思考モデルから実務エージェントへ、複雑タスクを完遂するAIに進化

思考力の強化に加え、エージェント実行能力を大きく押し上げたGemini 3.1 Pro。本稿では主要ベンチマークや機能改善を整理しつつ、「考えるAI」から「働くAI」へと進むモデル進化の方向性を、開発者視点のコメントとともに読み解く。 Antigravityが目指す「AI開発OS」の野望と未来の開発者の姿

Antigravityが目指す「AI開発OS」の野望と未来の開発者の姿

生成AIツールが進化する中で、CLIによる完全な制御とコンテキスト管理、そしてIDEによる直感的な確認作業という、一見相反する要素の両立が求められています。この実現のために、AIがエディタやターミナルを統合する、いわば「OS」としての役割を担う未来が目前に来ています。今回はGoogleの「Antigravity」を手がかりに、AIとIDEの主従関係が逆転するパラダイムシフトを読み解きます。 AIエージェントに疑問視? Microsoftが「マルチタスク」の課題を指摘

AIエージェントに疑問視? Microsoftが「マルチタスク」の課題を指摘

Microsoftの研究チームは、AIエージェントがマルチタスク環境で陥る4つの主要課題を指摘し、新たなフレームワーク「CORPGEN」を提案した。現実的な勤務スケジュールを持つ「デジタル従業員」としてAIエージェントを展開し、従来手法に比べ最大3.5倍のタスク完了率を実現するという。