VR、人工知能、画像/音声/動画解析、IoTの最先端16事例が披露されたMicrosoft Innovation Day 2016:ITエンジニアの未来ラボ(9)

Microsoft Innovation Day 2016では、先進的な技術やサービスを提供する企業やスタートアップを表彰するInnovation Award 2016のファイナルピッチと表彰式が行われ、日本のスタートアップの最新の取り組みが明らかになった。本稿ではファイナリストたちが発表した優れたアイデアや最先端のサービスの一端をお届けする。

日本のスタートアップが世界に誇れるサービスを披露

IoTや人工知能(AI)などの先進技術を活用したビジネスの展開で欧米に後れを取っていると言われている日本の企業。しかし今、世界に誇れる革新的なサービスを提供しようとするスタートアップの動きが日本国内でも活発化しているのをご存じだろうか。日本マイクロソフトが2016年4月23日に開催した「Microsoft Innovation Day 2016」では、先進的な技術やサービスを提供する企業やスタートアップを表彰する「Innovation Award 2016」のファイナルピッチと表彰式が行われ、日本のスタートアップの最新の取り組みが明らかになった。

本稿ではInnovation Awardのファイナリストが発表した優れたアイデアや最先端のサービスの一端をお届けする。

- “身体ハッキング”でリハビリ革命を起こす「bioSync」

- 日本語音声認識の技術革新と普及に挑む「The VOICE」

- AIを駆使して科学の進歩を加速する「クラウドを活用したライフサイエンス研究画像解析」

- IoTで手軽にホームセキュリティを実現「Secual」

- カメラ画像認識技術により体を動かすだけで本格的な音楽を演奏できる「KAGURA」

- 1枚のシールとスマホでVRを触って楽しめる「Milbox Touch」

- 風景に特化した映像コンテンツで“風景の流通”を目指す「LandSkip」

- 仲介会社の案内なしに賃貸物件を内覧できる「スマート内覧」

- 非接触型バイタルセンサーで在宅介護支援を実現「VitalCatch」

- 店舗のカメラ映像で顧客の感情マーケティングを可能にする「アロバビューコーロ」

- IT農業を低コストで手軽にスタートできる「みどりクラウド」

- 画像・映像データなどの機械学習でメンタルヘルスチェック「MEDICMO-MHC」

- スマホで“場所”に関わる情報をズバリ検索「Pathee」

- 動画共有で社内教育を可視化し業務を効率化「TANREN」

- スマホでメニューを選びテーブルに置くだけで注文が完了「Putmenu」

- プレーに関わる動画を共有・分析し、競技力向上を目指す「Spoch」

“身体ハッキング”でリハビリ革命を起こす「bioSync」

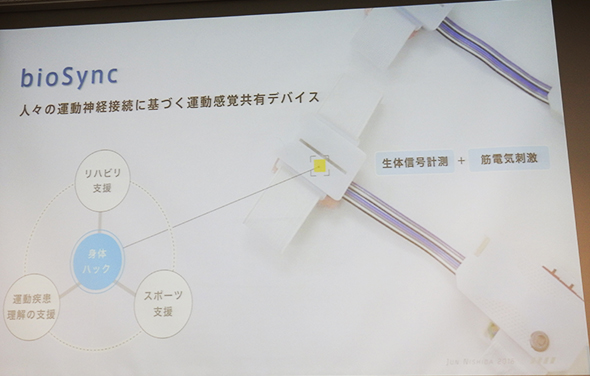

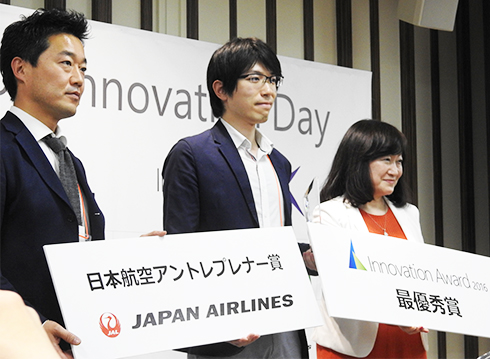

Innovation Awardの最高賞である「最優秀賞+日本航空アントレプレナー賞」に輝いたのは、筑波大学の人工知能研究室が開発を進めている運動感覚共有デバイス「bioSync」である。

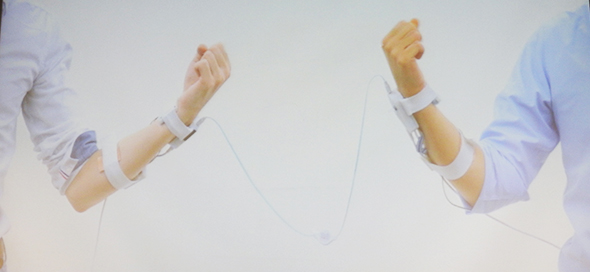

bioSyncは、患者と介助者の運動神経に接続することによって、運動感覚を理解・共有することを可能とするウェアラブルデバイス。生体信号を測定する機能と筋電気刺激を加える機能を持つ生体電極モジュールとコントロール・モジュールで構成されている。これによって、運動感覚を他者と共有することで、リハビリテーションやスポーツ・トレーニングを支援したり、運動疾患を抱える患者の運動状態を支援者や研究者に転送して疾患の理解を深めたりすることが可能になる。

実際にどのような場面で役立つのか。例えば、筑波大学では下肢装着型のロボットスーツ(外骨格ロボット)を使ったリハビリの研究を進めているが、これまでは歩き出しのタイミングや力の入れ方などを言葉で説明する必要があった。bioSyncを患者と介助者に装着して両者の感覚を共有すれば、介助者は直感的に患者の筋活動を確認し、使い方を教示することが可能になる。

また、運動機能疾患を抱える患者の状態を転送して再現することで、患者の支援に役立てることができる。例えば、パーキンソン病の患者の手の震えを再現することで、患者が持ちやすくて中身をこぼしにくいスプーンの開発にも成功している。

筑波大学の人工知能研究室では現在、Xamarinのクロスプラットフォーム技術を使って、bioSyncの生態信号処理ソフトウェアをタブレットやスマホ、PCなどで利用可能にし、病院、展示会、家庭など、さまざまな現場で活用できる体制の整備を進めつつある。

日本語音声認識の技術革新と普及に挑む「The VOICE」

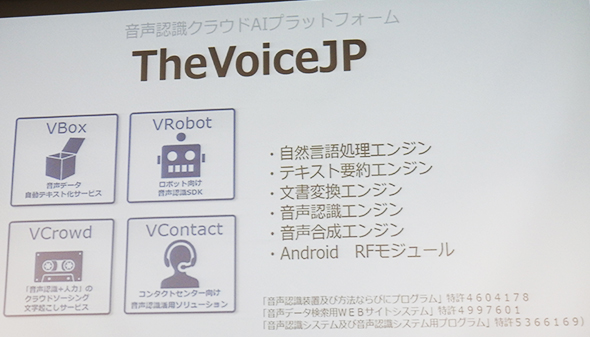

審査員特別賞とThe BRIDGE賞の両賞を受賞したのは、Hmcommが産業技術総合研究所からの技術移転を受けて開発した音声認識クラウドAIプラットフォーム「The VOICE」である。

音声認識技術はこれまで長い間、大きな技術的な革新が見られず普及が進んでいなかったが、アップルのSiri、Amazon AlexaやGoogle Now、Microsoft Cortanaなどの音声アシスタントやコミュニケーションロボットの登場により、普及が本格化する兆しを見せ始めている。しかし、音声認識の精度は十分ではないのが現状である。こうした状況を打開すべく開発されたのがThe VOICEというわけだ。

The VOICEは、音声認識、音声合成、自然言語処理、テキスト要約、文書変換などの要素技術とAIなどの最新技術を駆使して、クラウド上で音声データの分析サービスを提供するプラットフォーム。その上で提供される具体的なプロダクトには、音声データ自動テキスト化サービス「VBox」、ロボット向け音声認識SDK「VRobot」、クラウドソーシング文字起こしサービス「VCrowd」、コンタクトセンター向け音声認識活用ソリューション「VContact」などがある。

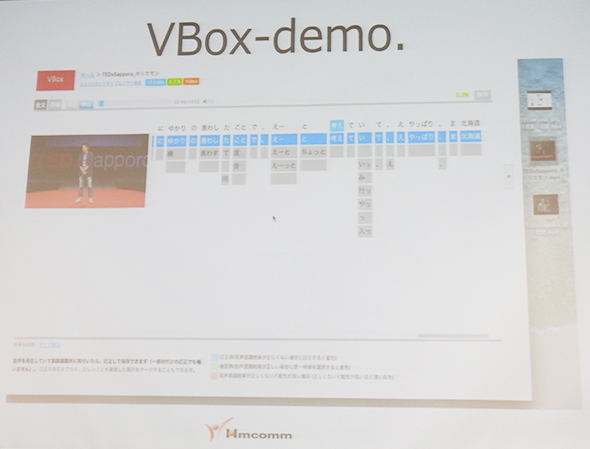

2016年3月にリリースされたVBoxは、動画や音声ファイルをドラッグ&ドロップするだけで自動的に音声認識してテキスト化を行うクラウド型のサービス。音声再生中に誤認識箇所を見つけて訂正し保存することもできる(一部分だけの訂正も可)。また3月には、三菱東京UFJ銀行の法人向けの業務の一部で、音声認識サービス「The VOICE BUSINESS」の提供を通した支援を開始したことも発表している。

今後は、音声認識の精度向上に向けてDeep Learning(深層学習)を強化するとともに、産業技術総合研究所のAIセンターと連携し、大量の音声データを収集して精度を高めること通してAI技術発展の好循環を構築していく。また、サイバーフィジカルの実現に向けて、IoTデバイスから音声情報を収集することによって新たな価値の創出を図るとともに、深層学習エンジニアの育成にも積極的に取り組んでいくという。

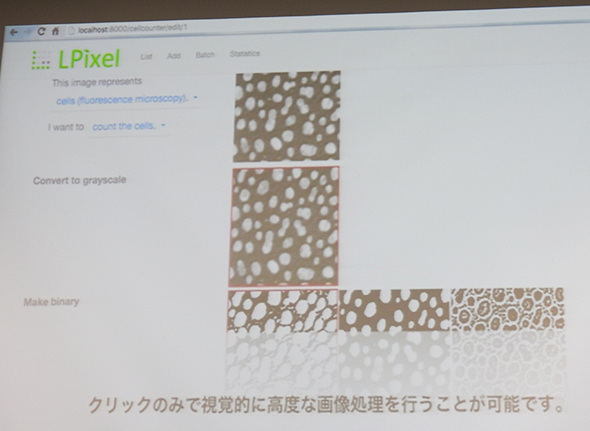

AIを駆使して科学の進歩を加速する「クラウドを活用したライフサイエンス研究画像解析」

The VOICEと同点の評価を獲得し審査員特別賞を受賞したのが、クラウドを活用しAIを駆使したエルピクセルのライフサイエンス研究画像解析システムである。

研究の分野では、画像技術の発展によって多くの画像が使われるようになりつつあり、研究者の多くは画像の解析に時間と労力を費やすようになってきている。中でも、ライフサイエンスの分野では、研究に使用される画像データの量は10年で100倍以上に増大したと言われており、実際に世界の3大科学ジャーナル『Nature』『Cell』『Science』に掲載されたライフサイエンス論文の約9割に画像が用いられているという。

こうした背景を踏まえ、エルピクセルでは、ライフサイエンス研究者の画像処理作業の軽減を目指し、AIを活用してクラウド上で簡単に画像解析ができる新しいシステムの開発に取り組んだ。そのコンセプトは、AIによって高度な画像処理を小学生でも使えるように簡単にし、大量の画像を短時間で、しかも高精度で解析できるようにするということだ。

ここでは、実際の活用例を基に、新システムの利用の流れを見てみよう。

- まずは顕微鏡で撮影した細胞の画像をクラウド上にアップロード

- 撮影対象や撮影方法などの画像情報を入力

- 「細胞の個数を調べたい」などの画像の目的を入力

- 解析の候補が出てくるので、研究者のイメージに近いものを選ぶだけで、高度な画像処理を実行

- 解析完了後、解析手順を書き出して保存できる

- 大量の画像の処理が必要な場合は、ファイルの一括処理やバッヂ処理も可能で、同一条件で大量の画像を解析できる

- 得られた複数の解析結果をグラフ化して比較できる

このように、画像解析を簡単に行えることが分かる。同システムは、β版が2016年の夏に公開される予定で、秋には初期バージョンを販売開始される見通しという。

同社は今後も、大量の画像を自動的にクラウドにアップロードし、AIが勝手に解析を行って、必要とされる解析結果だけを研究者に提示するシステム作りを目指す。

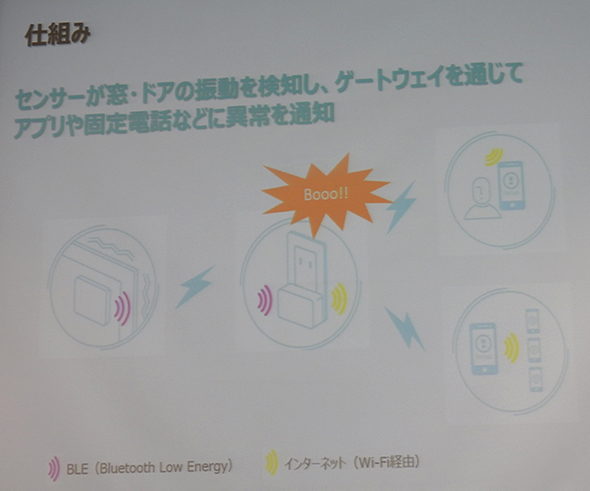

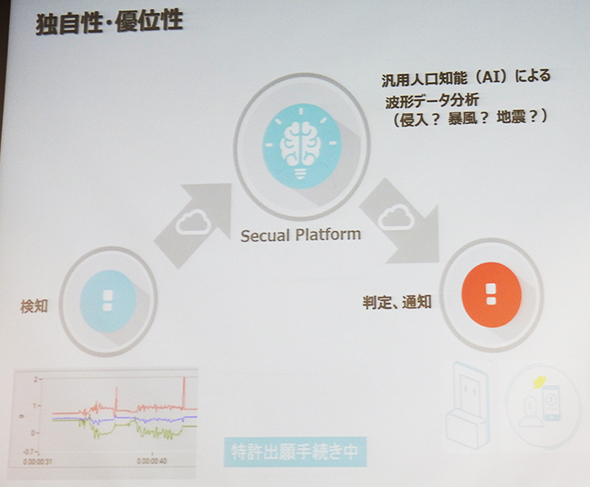

IoTで手軽にホームセキュリティを実現「Secual」

オーディエンス賞とPR TIMES賞の両賞を受賞したのは、Secualが開発した安価で導入が容易なIoTベースのホームセキュリティシステム「Secual」である。

Secualがホームセキュリティのビジネスに参入したきっかけは、欧米と日本でホームセキュリティの普及率の違いに着目したことにある。欧米ではホームセキュリティの普及率は20%に達しているが、日本ではその利用は富裕層に限られており、普及率はわずか2%にすぎない。その状況を踏まえ、「“安心”をもっと身近に、カジュアルに」をコンセプトに安価でスマートなホームセキュリティを日本国内向けに提供することにしたという。

Secualのシステムは、窓に貼り付けて振動を検知するシール型の加速度センサー「窓センサー」と、窓センサーから得られる情報を電波で受信し、音声とブザー音で警報を発する「ゲートウェイ」、そしてこれらをコントロールする「スマートフォンアプリ」で構成されている。

その仕組みは極めてシンプルだ。窓センサーが不審な振動を検知すると、その情報が電波でゲートウェイに伝えられ、ブザーと音声で警報を発すると同時に、あらかじめ登録してあった関係者に自動音声で電話をかけたり、スマホアプリで通知したりする。

Secualの用途は防犯だけにとどまらない。センサーをトイレや冷蔵庫などに貼り付け、使用状況を遠隔地の家族に通知するようにすれば、高齢者の見守りシステムとして利用できる。また、外出時に窓がきちんと閉まっているかどうかを知らせる機能や、緊急地震速報や気象情報をピンポイントで自宅に配信したり、音声で通知したりする機能の追加も予定している。

今後は、スマートロックやスマートカメラなどのIoT製品との連携を図るとともに、駆け付けサービスの提供に向けた提携も模索する。また、見守りサービスをはじめ、空き家や小規模の事業所・店舗の管理など、新たな分野や海外にもビジネスを広げていきたいとしている。

カメラ画像認識技術により体を動かすだけで本格的な音楽を演奏できる「KAGURA」

サムライインキュベート賞を受賞したのは、リアルの楽器を弾いた経験のない人でも、身体の動かすだけで本格的な音楽を演奏できる身体拡張楽器「KAGURA」だ。しくみデザインが開発した。

KAGURAでは、演奏者は自分が映し出された画面上の楽器アイコンを、身体を使ってたたく動作をすることによって演奏を行う。幾つもの楽器があらかじめ用意されており、演奏者は使用する楽器の音やテンポ、音階などを設定できる。もちろん新しい楽器を作ることもできる。演奏者は、演奏を意識せず適当に身体を動かすだけでも、システムが勝手にリズムをとって本格的な演奏に仕上げてくれる。

どのようにして身体を動かすだけで演奏することが可能になるのか。KAGURAでは以下のような技術を使ってそれを実現している。

- しくみデザインが自社開発したカメラ画像認識技術によって、人の動きをリアルタイムに検出

- インテルの動画認識技術RealSenseを活用して人のジェスチャーを認識、距離のノイズを除去

- 水面波紋エフェクトと呼ぶ距離の表現を実現

- 楽音生成アルゴリズムの採用によりフレームレートのレイテンシ(遅れ)を補正

- MIDI(Musical Instrument Digital Interface)/MIDI Clockによる他電子楽器との連携

なお、これらの機能を全てサポートしたKAGURAの最新版(Ver.2)は2016年夏にリリースされる予定だ。

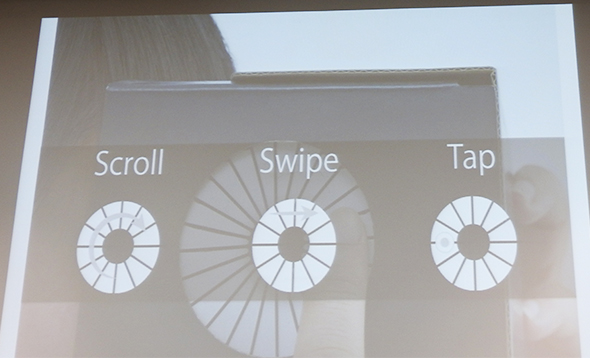

1枚のシールとスマホでVRを触って楽しめる「Milbox Touch」

Tech in Asia賞を受賞したのは、スマートフォンと1枚のシール型入力モジュールを組み合わせて手軽にVRコンテンツを楽しめるダンボール製スマホVRゴーグルである「Milbox Touch」。WHITEが開発した。

Milbox Touchは、ダンボール製のゴーグル内にスマートフォンとシール型タッチインタフェースモジュールを取り付けるだけで、VRコンテンツを、タップやスクロール、スワイプなどの入力操作で手軽に楽しむことができる。

操作性に優れたVRゴーグルを安価に提供できる秘密は、シール型のタッチユーザーインタフェースモジュールにある。これは、導電性インクをシール上に印刷しただけのシンプルなもので、電源も通信モジュールも必要とせず、VRコンテンツのスクロール、タップ、スワイプなどの操作を実現する。

WHITEでは、Milbox TouchをOEMで他社にも提供する予定で、タッチ入力方式を業界標準にしていきたい考えだ。また、Milbox Touch対応アプリとして、かつての人気ゲームの『パックマン』を3D化した「MilboxTouch ver. VR PAC-MAN」(第1弾はAndroid版)を自社で開発して提供している。同社は対応アプリの開発を促進するため、Unity、Xamarin、iOS、Androidに対応するSDKの提供も無償で開始している(参考「使用事例としてVRパックマンも提供開始:タッチ操作付きで安価なスマホVRゴーグル「MilboxTouch」が発売、Unity向けSDKも提供」)。

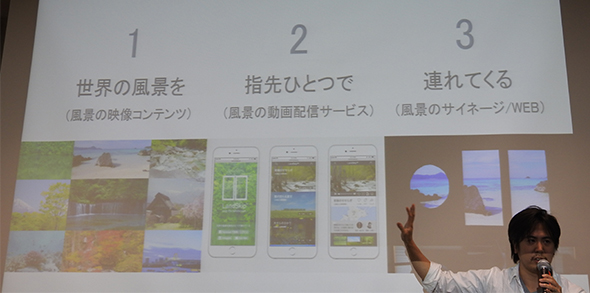

風景に特化した映像コンテンツで“風景の流通”を目指す「LandSkip」

「LandSkip」は、風景に特化した4K画質の映像コンテンツを、家庭、オフィス、病院/介護施設、飲食店/ホテルなどのテレビやサイネージデバイスに配信するサービスである。

提供される映像コンテンツは、全て自然のありのままの風景を切り取ったもので、ズームアウトや首振りなどの処理は行っていない。映像は世界2000箇所以上の場所で撮影しており、365日新しい風景を日替わりで配信を行っている。映像は全て4K画質で、空撮やVR(360度全天球)といった固定視点以外の映像コンテンツの制作にも取り組み始めているという。

LandSkipが目指しているのは、風景コンテンツの流通だ。自社コンテンツだけでなく、現場の近くで映像を制作する観光業界や映像作家と協力して風景を撮影し、流通プラットフォームを提供しながら、優れた風景コンテンツを法人ユーザーや個人のユーザーに提供していく。

既にLandSkipのサイトでは、実際に毎日新しい風景が配信されている。また、配信先の拡大に向け、映像関連の企業との提携も積極的に行っている。既に、ソニーのポータブル超単焦点プロジェクター向けに風景コンテンツを配信している他、2016年5月からはMADSのサイネージ広告プラットフォームへの提供を開始し、病院や店舗など3万カ所以上に毎日風景を配信している。2016年6月からは、スカパー!においてノンテロップ/ノンナレーションの4K風景番組の放送が開始された。

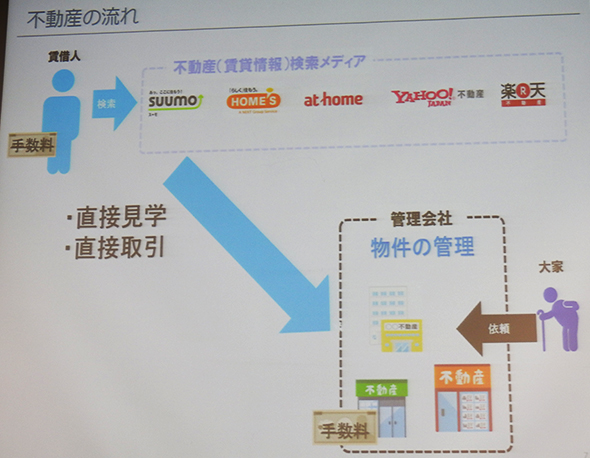

仲介会社の案内なしに賃貸物件を内覧できる「スマート内覧」

ライナフが提供する「スマート内覧」は、利用者が携帯電話を使って不動産仲介業者の案内なしに自分で賃貸物件を直接内覧できるサービスである。

これまで賃貸物件を見つけて内覧するためには、賃貸情報検索サイトで物件を検索して気に入った部屋を見つけ、不動産仲介業者に連絡して内覧日時を決定し、仲介業者に部屋のカギを開けてもらって見学する必要があった。そのため、契約時には物件の管理会社と不動産仲介会社の両方に手数料を支払う必要があった。

スマート内覧では、賃貸情報検索サイトで物件を検索して気に入った部屋を見つけると、サイト上で都合のよい内覧日時を選び、直接現地に行って携帯電話を使って自分で部屋のカギを解錠して見学できる。不動産仲介業者の立ち会いが必要なくなるため、利用者は都合の良い時間帯を選んで自分のペースに合わせて1日に何件でもゆっくりと見学することが可能だ。開閉履歴が残るため、管理会社側も安心だ。また、利用者は契約時に管理会社だけに手数料を支払えばよい。

実際のサービス利用の流れを見ると、利用者はサイト上で見たい部屋を見つけて日時を選択し、確認ボタンをクリックするだけで予約が完了する。内覧の当日は予約時間に現地に直接行って、スマートフォンまたは携帯電話から電話をかけ、自動音声応答に従って、部屋のカギを開けたい場合は「1」を押すと、部屋のカギが自動的に開き、ゆっくりと見学することができる。なお、カギの自動開閉には、ライナフが提供するスマートロック「Ninjya Lock」の技術が使用されている。

同サービスは既に2016年2月から開始しており、三菱地所が2月から、三井不動産住宅リースが3月から、野村不動産が4月から導入している。

スマート内覧の最大のポイントは、賃貸物件の内覧サービスを時間単位で細切れにして提供できること。この技術を使えば、不動産活用の可能性が大きく広がり、「不動産は必要な分だけ使う時代に入った」としている。

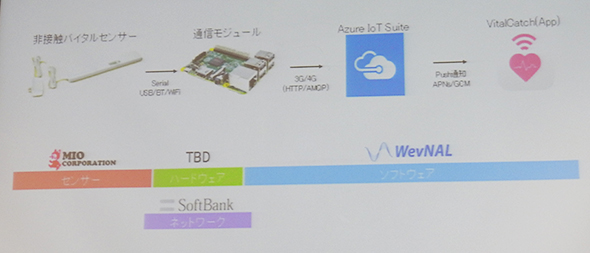

非接触型バイタルセンサーで在宅介護支援を実現「VitalCatch」

WevNALが開発した「VitalCatch with Azure IoT Suite」は、非接触型のバイタルセンサーを利用して終末期在宅患者の状態をモニタリングする見守り介護支援サービス。脈拍、胎動、呼吸の3つの状態を常に監視しており、異常が発生するとプッシュ通知によって介護事業者・親族へ通知する。

同社が見守り介護支援サービスを開発した理由は、高齢化が進んでいるにもかかわらずブラックボックス化したままで変わらない既存の在宅医療の現場を、センサーなどの最新技術を使って可視化することによって、実務の勘だけではなく、データによる論理的なアプローチを組み合わせて、家族が親の様子を24時間365日どこからでも見守ることが可能な環境を実現したいと考えたためだという。

同サービスは、MIO CORPORATIONが製造する非接触バイタルセンサーが受信するデータを、通信モジュールとソフトバンクのネットワークを介して、Azure IoT Suiteに送信して管理する。そして、異常が発生すると、介護事業者や親族のスマホアプリにプッシュ通知する仕組みになっている。

なお、Azure IoT Suite内部では、センサーとAzureサーバ間の通信は双方向で行われており、センサーの情報をただ読み取るだけではなく、センサーの初期化や電波構成の調整などをリモートから行えるようになっている。

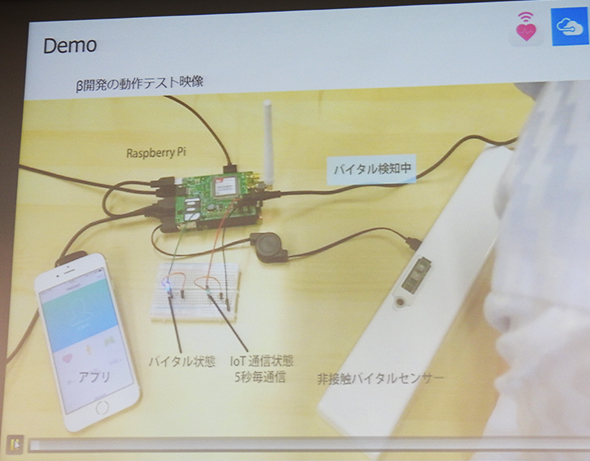

β開発の動作テストの様子を撮影した写真を見ると、バイタルセンサーとスマホ(アプリ)、通信モジュールを確認できる。非接触型バイタルセンサーは、実際にはベッドの下に配置され、バイタル状態とIoT通信状態をAzureへ5秒ごとに送信する。なお、通信モジュールは試作用としてRaspberry Piを使用している。

β開発は既に終了し、2016年4月から製品版の開発に入っており、通信モジュールベンダーの選定やマイクロ波センサーの初期校正、管理画面インタフェースの実装などの作業を進めている。同時に、介護事業者(やさしい手)と協力して実証実験を行っており、2016年中にリリースする計画だ。

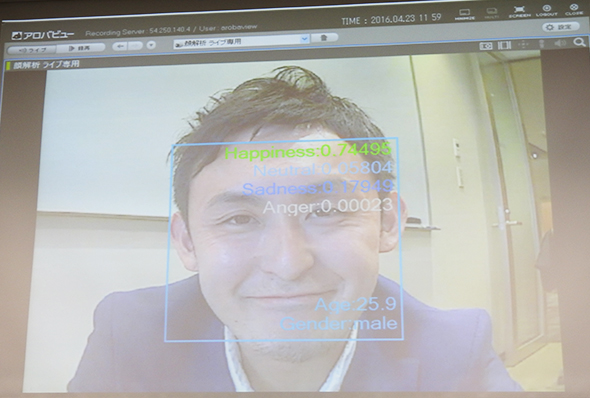

店舗のカメラ映像で顧客の感情マーケティングを可能にする「アロバビューコーロ」

アロバが発表した「アロバビューコーロ(ArobaView Koro)」は、ネットワークカメラで撮影したリアル店舗の映像から、人の感情や属性などの情報を解析し、顧客データとして活用きる映像解析システムである。

これまでリアルの店舗では、POSレジに入力された情報だけを基に顧客情報管理を行ってきた。そのため、例えば、商品を購入しなかった顧客の属性や滞在時間などの情報は得ることができず、ネットショップのように、訪問者数や閲覧数、購入率などを知ることができなかった。リアル店舗においても、商品を購入しなかった顧客を含む来店者の数や年齢、性別などを知ることができれば、商品の購入率や施策の効果を容易に分析できるようになる。

アロバビューコーロでは、ネットワークカメラと最新の映像認識技術を使って、店舗内の映像を解析し、来店者の属性(性別や年齢など)や感情などの情報を抽出できる。これによって、リアル店舗でもネットショップ以上の顧客情報分析ができるようになり、売り上げアップに貢献することが可能になる。

実際にどのような情報を取得できるのか。管理クライアントの顔分析機能のデモ画面を見ると、顧客の顔の映像上に、感情(うれしさ、悲しさ、怒り)のレベル、性別、年齢など、顔の表情を解析した結果が表示されていることを確認できる。

こうした人の属性や感情の解析には、Microsoft Cognitive ServicesのAPIを使っている。ただし、同サービスは静止画にしか対応していないため、いったんローカルシステム上で処理を行って顔部分を静止画として抜き出してMicrosoft Cognitive Servicesに引き渡しているという。

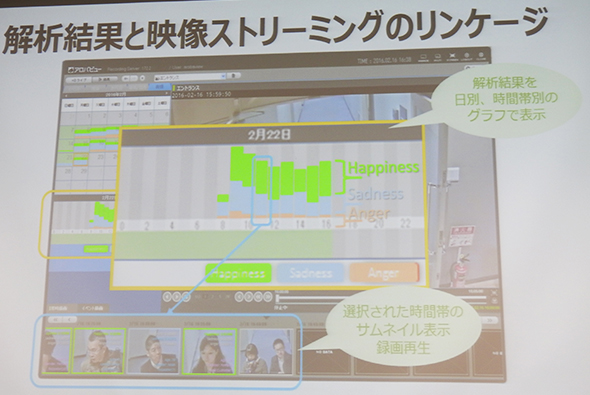

アロバビューコーロは、マルチカメラベンダー対応を実現し、店舗で使用している既存のカメラをそのまま利用できる。また、顔を検知した際の画像(約10秒)をサムネイル表示して再生できる機能や、解析結果を日別・時間帯別のグラフで表示する機能などを提供している。

アロバビューコーは、属性判定・顔照合・人数カウント・感情解析の機能を含め、月額数千円(カメラ1台あたり)で利用を開始することができる。

IT農業を低コストで手軽にスタートできる「みどりクラウド」

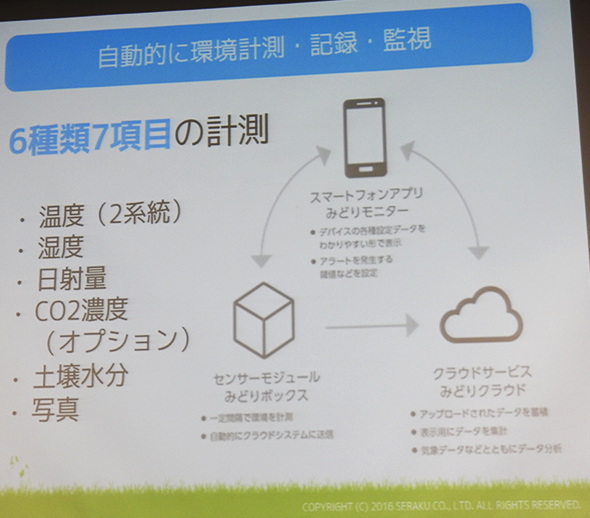

セラクが提供する「みどりクラウド」は、ビニールハウス内の環境を計測するIoTセンサーボックスを設置するだけで、ハウス内の状態を離れた場所から確認できるクラウドベースの温室内環境遠隔モニタリングシステムである。

世界的な異常気象や気象変動の発生、農業事業者の減少、TTPの発効など農業を取り巻く環境が厳しさを増す中、IT活用による農業の効率化が求められている。しかし、農業ITには可視化を実現するための計測・記録のIT化、作業を効率化するための判断・制御のIT化などに膨大なコストが必要になる。そのため、セラクでは、IT化の取り組みを計測と記録の2つに絞ることにより導入コストを低く抑えながら、誰でも簡単に利用できるシステムを開発することにしたという。

こうして開発されたシステムは、ビニールハウス内に設置するセンサーボックス、システムを管理するためのWeb/スマホアプリ、データを蓄積して集計・分析するクラウドサービスで構成される。センサーモジュールはハウス内の環境(温度、湿度、日射量など6種類7項目)を2分ごとに計測し、クラウドシステムに自動送信。クラウド(Azure)上ではデータを蓄積するとともに表示用にデータを集計、気象予報データとの比較などデータ分析を行う。管理モニター上では、各種データを分かりやすく表示され、アラート通知やデバイスの各種設定も簡単に行える。

センサーボックスの販売価格は6万8000円から、クラウドサービスも月々1280円と、低コストで利用を開始できる。また、コンセントに電源を指すだけで誰でも簡単に導入することが可能、Wi-Fi設定もカメラを使って行える。発売は2015年11月からだが、既に全国で220台が稼働しているという。

現在、稼働中のシステムから月間490万件ものデータがクラウド上にアップされている。今後は、環境データだけではなく、農作業記録や育成記録、病害虫記録などのデータも収集し、気象データなども加えて機械学習を適用することで、市場予測や生育予測、病理予測を可能にし、「もうかる農業」を実現していきたいとしている。

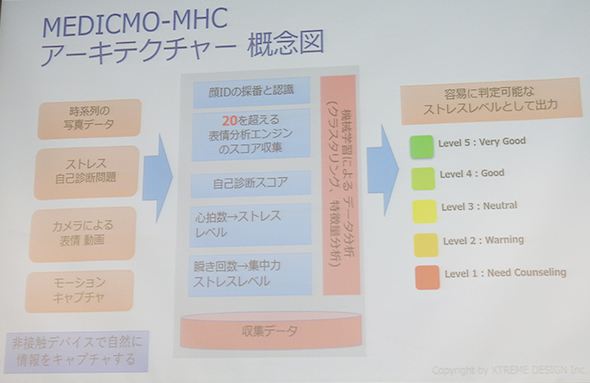

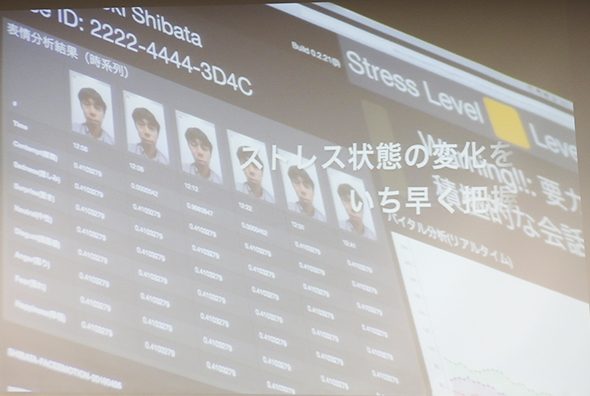

画像・映像データなどの機械学習でメンタルヘルスチェック「MEDICMO-MHC」

エクストリームデザインが開発している「MEDICMO-MHC」は、人のストレス状態の悪化を察知して、その危険を優しく迅速に伝えることができるメンタルヘルスチェックサービスである。

日々さまざまなストレスを抱えて生活している今、そうしたストレスをハラスメントや薬物依存といった間違った方向に発散してしまいう人が増えている。そうなる前に状態の変化に気付いて「どうしたの?」と優しく声をかけることができたら、多くの人を救うことができる。MEDICMO-MHCはそうした対応を実現することを目指して開発が進められている。

MEDICMO-MHCでは、時系列の写真データやカメラ動画、モーションキャプチャーといった非接触デバイスから得られたデータや、ストレス自己診断テストのデータなど、人のストレスの変化を把握できる情報を収集。クラウド上で機械学習を使ってストレスの状態を分析し、その結果を、容易に判定可能なストレスレベルとして出力する。

例えば、タイムカードに打刻時に撮影したような時系列の写真データを使用した例では、ベンダーを枠を超えたマルチクラウド基盤上において、複数ベンダーが提供する20を超える表情測定APIのそれぞれの特徴を生かし、高度なストレス分析を行っている。また、高性能サービス実行基盤デザインにより高速で安全な分析処理を実現している。

エクストリームデザインでは、高性能・低遅延の大規模システムデザインと人口知能エンジン構築の経験を生かしながら、将来的には、ストレスレベル推移の確認すら必要とせず、全てをAIとボットに任せることができるサービスの実現を目指していくとしている。

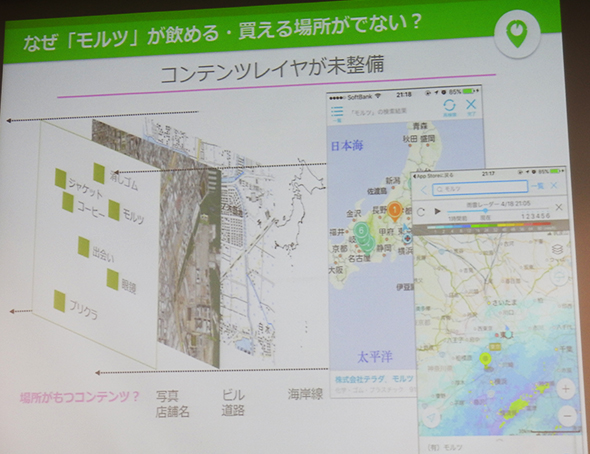

スマホで“場所”に関わる情報をズバリ検索「Pathee」

tritrueが開発した「Pathee(パシー)」は、“場所”に関わるあらゆる情報を整理・更新し、誰もが必要な情報に自由にアクセスできる空間検索エンジンを、スマートフォンアプリで手軽に利用可能にしたサービスである。

現状の検索システムでは、ある地域で欲しい商品を販売している店を探そうとしても、関係のない膨大な検索結果が表示され、結局必要な情報を得られないことが多い。また、既存の地図アプリでも、全く検討外れの検索結果が表示されるのがほとんどだ。

こうした問題の解決に向け、日々変化する“場所”に関わるあらゆる情報を素早く収集・整理し、必要な情報を迅速に提供できるようにしたのがtritrueが開発した空間検索エンジンである。

空間検索エンジンは、Azure上に構築されており、毎月1億以上の“場所”に関わる情報を収集し、文章解析や機械学習の技術を使って自然言語解析や新しい日本語への対応を行っている。また、関連する場所の判定や位置情報付けによって位置情報をマッピングし、データの索引を作成することによって、利用者がキーワードを入れた瞬間に結果を返せるようにしている。

Patheeは、この空間検索エンジンを使ったサービスの1つとして開発されたスマホアプリ。通常の検索エンジンとは異なり、スポット検索を実現し、場所に関係する情報のみを的確に検索できる。もちろん店舗情報だけではなく、公共施設や郵便ポストの他、事件が発生した場所なども検索できる。

空間検索エンジンの技術と人口知能を組み合わせて利用すれば、マンション購入者に対する生活支援サービスや緊急対応サービスにも応用できる。また、IoT関連の情報と連携することにより、これまでの平面の情報だけではなく、空間の情報を整備して活用することが可能になるという。

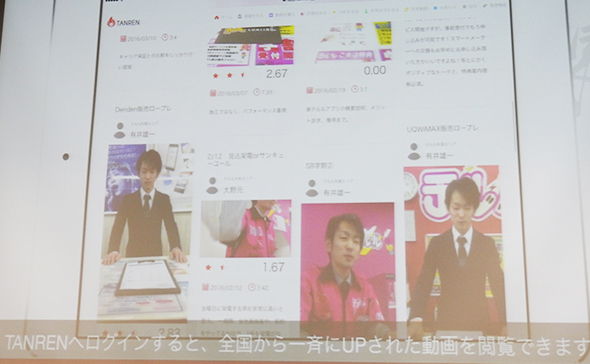

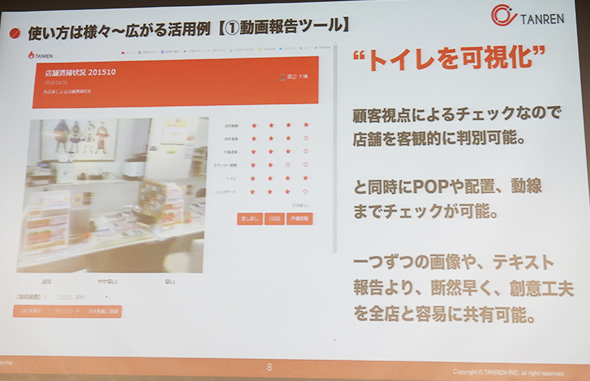

動画共有で社内教育を可視化し業務を効率化「TANREN」

「TANREN」は、スマートフォンを使ってクラウド上で研修動画を共有することにより、社員研修の可視化と効率化を実現するクラウド型のナレッジシェアアプリである。最新版のバージョン3では、iPhoneやiPad、Androidに加え、Windows 10 Mobileでも利用できるようになった。

多くの顧客と向き合う店舗スタッフなどの研修は、研修所などで時間を十分に取って行うことが難しいということもあり、現場完結で終わってしまうことが多く、属人的になりがちだった。TANRENを使えば、研修動画をクラウド上で共有し、いつでもどこでも評価・確認し合うことが可能になり、社内研修の効率化を図ることができる。

社内研修での一般的な利用の流れを見ると、下記のようなステップになる。

- 評価者が課題のテーマを作成

- 対象者は、そのテーマに基いて疑似対応動画を作成しクラウド上で共有する

- 評価者は動画を見ながら評価を行う

- グラフなどを使って課題を可視化する

既に社内教育以外での応用も広がっている。例えば、動画報告ツールとしての活用だ。具体的には、店舗の裏側の洗面所やトイレなどの状況を動画でチェックすることにより、店舗の運営の良しあしを客観的に判別できるようになった他、POPや配置、動線までをチェックすることが可能になった。

研修会社とのコラボにより、評価/管理の業務をアウトソーシングする動きも出ている。既に、見本動画の提供やフィードバックの提供が始まっている。また、Wi-Fi対応のIoT監視カメラを使ってリアルの接客映像を共有・評価し、業務を可視化するTanrenCameraと呼ばれるプロジェクトについても大手携帯キャリアの専門店から順次スタートする見通しという。

今後は、アクションカメラをはじめとするあらゆるデバイスからの入力に対応するとともに、Azure Media Serviceを使った動画配信も可能にする。また、教育事業者とのコラボによる教育コンテンツの共同開発やアウトソーシングについても模索していきたいとしている。

スマホでメニューを選びテーブルに置くだけで注文が完了「Putmenu」

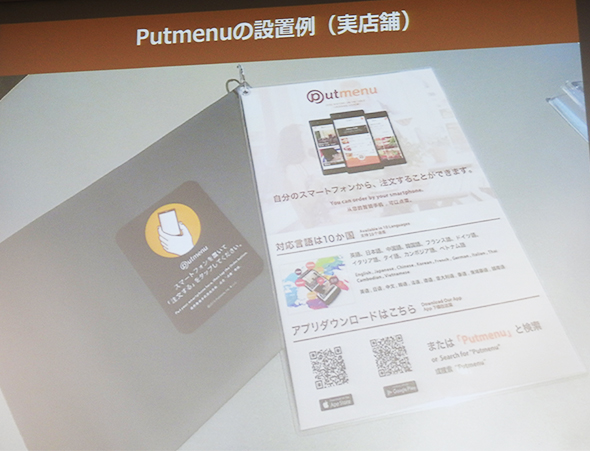

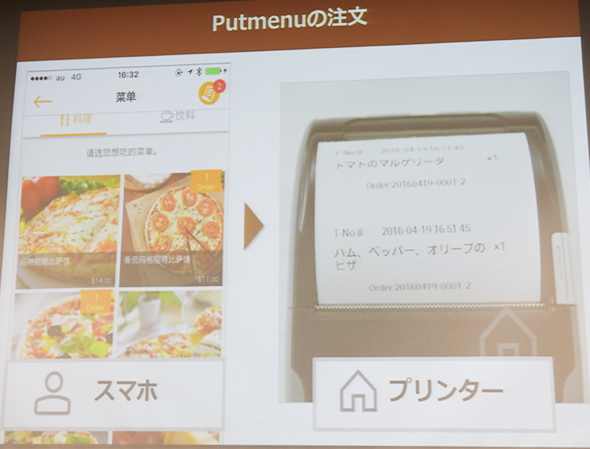

米国Putmenuとボクシーズが共同でアプリケーションを開発し、タグキャストが国内位置情報と来店認証機能を提供する「Putmenu」は、飲食店に来店した利用者がスマートフォンでメニューを選び、テーブルに置くだけで注文が完了して料理が運ばれてくるシステム。メニューは10言語に対応し自動翻訳されるため、外国人旅行者も安心して利用できる。

一般的に飲食店での利用者の行動には来店・注文・会計の3つの段階があるが、このうち来店と会計の領域に対応する製品やサービスは数多く提供されている。Putmenuは注文の領域に対応するものだが、この領域では競合する製品はほとんど見られない。Putmenuでは、来店の領域に対応する情報系アプリや口コミアプリ、会計の領域に対応するPOSシステムなど他社製品との全方位での連携を目指している。

Putmenuのハードウェアは、注文電子シート、専用タブレット、専用プリンタで構成される。このうち注文電子シートには、タグキャストと帝人が共同開発したPaperBeaconを採用、その表面数cmには強い電波が覆っており、スマートフォンをその上に置くだけでメニューを自動検知して注文を受け付けることができる。

まずは来店客の利用の流れを見てみよう。Webサイトなどで対応店舗を見つけて来店し、スマホアプリ(インストールガイドも用意されている)からメニューを選んで、スマホをテーブルに置くだけで、注文電子シートがメニューを自動検知し注文が完了する。料理が配膳され食事を済ませば、すぐに会計を行える。なお、対応店舗を見つけやすくするために、店舗の入り口にはPutmenuのシールが、WebサイトにはPutmenuのバナーが貼られることになっている。

次に店舗側の利用の流れを見てみよう。まず専用タブレットを使ってメニューを作成する(メニューと価格を設定し料理の写真を撮影する)。来店客が注文を完了すると、厨房の専用プリンタから日本語の注文書(座席番号と注文メニュー名)が自動出力されるので、すぐに調理して配膳を行う。来店客が食事を終えて会計を済ましたら、専用タブレットで会計の完了を確認する。

Putmenuは2016年1月から飲食店向けに、3月から旅館・ホテル向けに、提供を開始。10言語対応のルームサービスと物販に対応している。物販サービスでは、スマホから注文することができ、注文が行われると、フロントの専用プリンタから日本語の注文書(注文商品と部屋番号)が出力される。

また、3月からはPutmenuに対応する呼び鈴機能の提供も開始されている。訪日客がスマホアプリのメニュー一覧から「呼び鈴」ボタンを押すと、スマホ画面には、自国の言語で「席に来てください」や「会計をお願いします」などの用件が日本語で表示され、項目を選択するだけで、専用プリンタから用件が日本語に翻訳されてテーブル番号(宿泊施設の場合、部屋番号)付きで出力される。

プレーに関わる動画を共有・分析し、競技力向上を目指す「Spoch」

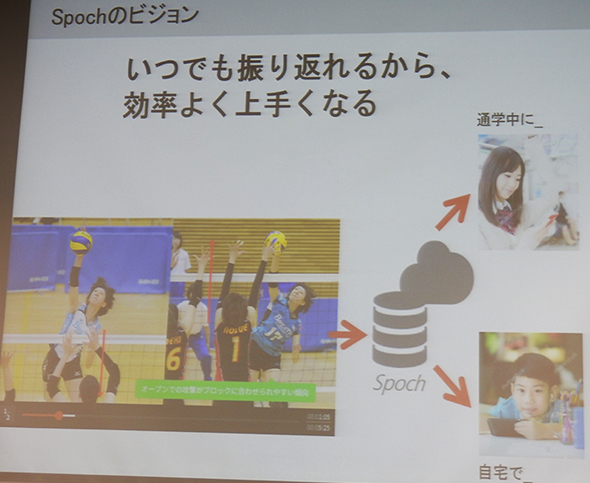

SPLYZAが開発した「Spoch」はアマチュアスポーツの全てのプレーと指導に関わる動画をクラウド上に蓄積し、効率的に活用することで、選手とチームの競技力向上を支援するスマートフォン用の動画共有アプリである。

スマートフォンの普及に伴って、日本国内でもスポーツの練習や試合を撮影する人が増えている。しかし、アマチュアスポーツの指導者のほとんどは、いまだに口頭での説明を中心に指導を行っており、選手の側も、指導には耳を傾けるものの、同じ指導を何度も繰り返し受けるなど、指導やプレーの形式知化/見える化が進んでいないという課題に直面している。

spoch開発のコンセプトは、試合や練習の動画をクラウド上に蓄積してコーチと選手で共有し、選手やプレーごとに再確認したり、効果的な編集を加えて分析することによって、こうした課題の解決に取り組もうというものだ。

spochの特徴は、チームの中でコーチと選手が動画やテキストを共有してコミュニケーションを図るための基盤としてクローズドSNSを提供していることである。また、動画やテキストなどの情報をクラウド上に蓄積して共有することにより、利用者は容量の大きさを気にすることなく安心して使用することができる。

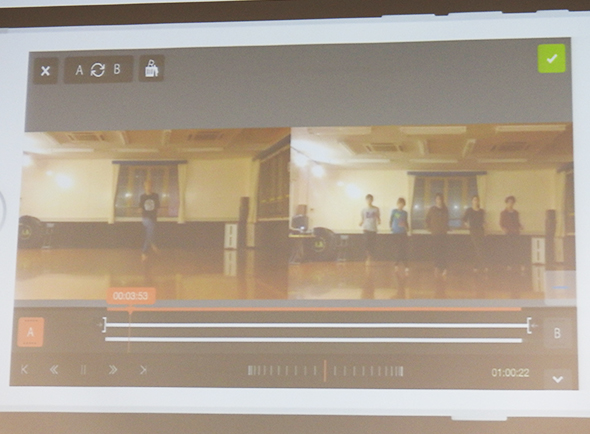

蓄積された動画は、タグによる検索が可能で、プレー名や選手名でタグ付けしておくことで、振り返って見せたい動画をタイムラインから絞り込んで何度も確認することができる。また、動画に対して指導内容を書き込んだり、図形や補助線を書き込んだりすることも可能。さらに、2つの動画を並べて同期させ、比較することもできる。写真の例は、ダンスの様子を比較したもの。先生の動画(左)と生徒の動画(右)を別撮りたものを、音楽で同期させているという。

spochを活用することでどのような効果を得られるのか。まず、試合や練習の動画を、自宅や通学時、試合直前の移動時など、いつでもどこでも繰り返して確認することができ、効率よく上達することができる。また、チームのアカウントの中に、今まで取り組んだ練習メニューや指導内容が蓄積されるため、指導者不足を解消することも可能だ。たとえコーチが経験の浅い先生に変わったとしても、今までやってきたことを継承し、次の指導に生かすことができる。

選手の競技人生のチャンスを広げることも期待できる。例えば、プロ球団のスカウトが選手の特定のプレーに興味を持った時に、選手名でタグ付けされた情報から、プロフィールページを参照してもらったり、他の動画のプレーも併せて見てもらったりすることで、正式なスカウトにつながる可能性が出てくる。

spochは2016年1月末から試験運用に入っており、既におよそ20団体が使用を開始している。5月からは新たに30団体が使用を開始する予定だという。SPLYZAでは、spochの提供により、トップアスリートだけではなく、あらゆるレベルの選手とチームの競技力向上に貢献していきたいとしている。

最終審査に勝ち残ったファイナリスト16社のサービスは、IoT、AI、VR、映像解析、ビッグデータ活用などの先端技術を活用しており、新たな市場やビジネスの創出を見据えた優れた提案やアイデアが含まれていた。Innovation Awardの審査委員長を務めた日本マイクロソフトの伊藤かつら氏は、最終審査に残った作品について、「今すぐにでも世界に通用しそうなサービスが多く、ビジネスの可能性を予感させてくれた」と総評した。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

マッシュアップもIoTへ――「下手な芸人より面白い」「狂気を感じる」「絶句した」な12作品が集まった #MA11 決勝戦まとめ

マッシュアップもIoTへ――「下手な芸人より面白い」「狂気を感じる」「絶句した」な12作品が集まった #MA11 決勝戦まとめ

全国の開発者が、自らの技術力と、世の中に公開されているさまざまなAPI、ハードウエア、センサーなどを「マッシュアップ」して、新たな作品を作り出すコンテスト「Mashup Awards」(MA)が今年も開催。同コンテストの最優秀作を決定する最終プレゼンテーション「ファイナルステージ」と、各賞の発表が、11月18日に東京の渋谷ヒカリエで行われた。 人工知能/自動化が家庭を変える――IoTとしての「家」は開発者にとってのフロンティアか

人工知能/自動化が家庭を変える――IoTとしての「家」は開発者にとってのフロンティアか

「スマートハウス」が持つ機能と、他のさまざまなデータを組み合わせることで、新たなサービスを生み出そうというコンテスト「家CON-2015」が開催され、10月下旬に審査結果が発表された。 IoT時代はイグノーベル賞デバイス、弁当箱、妖怪、ナデラブル、食べラブルがネットとつながる

IoT時代はイグノーベル賞デバイス、弁当箱、妖怪、ナデラブル、食べラブルがネットとつながる

おばかアプリとIoTが出会った夢のシンポジウムの模様をリポート。IoTの先駆者たちが3Dプリンター、Raspberry Pi、Arduino、LeapMotion、Bluetooth Low Energy、クラウド、機械学習やさまざまなセンサーなど最高の技術を無駄使いし、おばかな用法を語り合った。