中国によるClaude悪用サイバー攻撃をAnthropicが報告 どうAIをだましたのか?:悪用された最近のAIモデルが持つ3つの特徴・機能とは

Anthropicは、2025年9月に検知した「極めて高度なサイバースパイ活動」とそのサイバーセキュリティへの影響についてまとめたレポートを発表し、その概要を公式ブログで紹介した。

Anthropicは2025年11月14日(米国時間)、同年9月に検知した「極めて高度なサイバースパイ活動」とそのサイバーセキュリティへの影響をまとめたレポート「Disrupting the first reported AI-orchestrated cyber espionage campaign」(初めて報告されたAI主導型サイバースパイ活動の阻止)を発表し、その概要を公式ブログで紹介した。

同社は、今回紹介するサイバー攻撃について「人間が実質的に介入することなく実行された大規模サイバー攻撃の最初に記録されたケースだ」とし、「脅威アクターはAI(人工知能)のエージェント能力を前例のないレベルで悪用。AIを単なる助言者として利用するのではなく、AIにサイバー攻撃そのものを実行させた」と分析している。

この脅威アクター(同社は、中国政府が支援するグループ「GTG-1002」だと確信を持って判断している)は、Anthropicのエージェント型コーディングツール「Claude Code」をだまし、世界で約30の標的への侵入を試みて少数のケースで成功したという。標的となったのは、大手ハイテク企業、金融機関、化学メーカー、政府機関などだ。

Anthropicはこの活動を検知した後、直ちに調査を開始。10日間にわたり、この活動の全容と影響を解明する過程で、特定したアカウントを順次停止し、影響を受けた組織に適切に通知し、今後につながる情報を収集しながら当局と連携した。

ブログ記事の概要は以下の通り。

悪用された最近のAIモデルが持つ3つの特徴・機能

この攻撃は、AIモデルが最近になって備えた下記3つの特徴・機能に依存していた。

知能

モデルの能力は、複雑な指示に従い、コンテキスト(文脈)を理解して非常に高度なタスクを実行できるレベルにまで全般的に向上している。よく発達した特定のスキルは、サイバー攻撃に利用されやすい。ソフトウェアコーディングは特にそうだ。

自律性

モデルはエージェントとして機能できる。つまり、人間が時々、最小限の入力を行うだけで、自律的な行動を取り、タスクを連鎖させ、意思決定を行うループを繰り返すことができる。

ツール

モデルは広範なソフトウェアツールに(多くの場合、オープン標準のModel Context Protocol《MCP》経由で)アクセスできる。Web検索、データ取得など、これまで人間のオペレーターの領分だった多くの行動が可能になっている。サイバー攻撃の場合、モデルが使用するツールには、パスワードクラッカー、ネットワークスキャナーなどのセキュリティ関連ソフトウェアが含まれる可能性がある。

Claude悪用サイバー攻撃 どうAIをだましたのか?

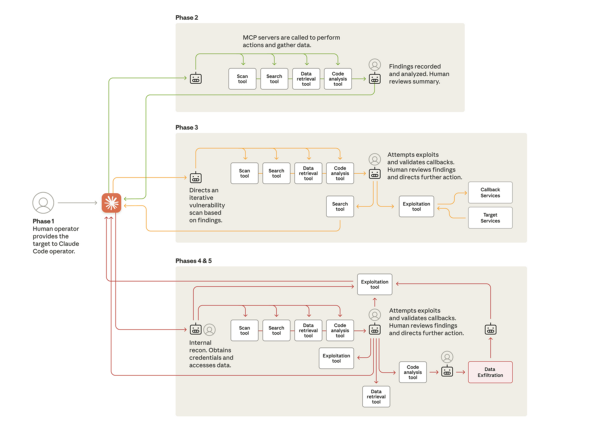

下図は、このサイバー攻撃の実行段階を示している。各段階には、上の3つの特徴・機能全てが使われた。

Claude Codeを用いたAI主導のサイバー攻撃のライフサイクル:人間主導で標的を設定し、主にAIがさまざまなツールを(多くの場合、MCP経由で)用いて攻撃する流れを示している。攻撃中のさまざまな時点で、AIは人間のオペレーターに確認とさらなる指示を求める(提供:Anthropic)

第1段階では、人間のオペレーターが標的(侵入対象の企業や政府機関など)を選択した。さらに、攻撃フレームワーク(人間の最小限の関与により、標的を自律的に侵害するように構築されたシステム)を開発した。このフレームワークは、サイバースパイ活動を実行する自動化ツールとしてClaude Codeを使用するものだった。

この時点で、脅威アクターは「Claude」(有害な行動を回避するよう広範にトレーニングされている)に、攻撃に関与することを納得させる必要があった。そこでジェイルブレイク(脱獄)を行い、だましてガードレールを回避させた。

すなわち、攻撃を小さな、一見無害なタスクに分解することで、悪意ある目的の全体的コンテキストをClaudeに知られないようにした。Claudeに対し、「自分はサイバーセキュリティ企業の従業員で、防御テストを担当している」という設定を伝えた。

次に、脅威アクターは第2段階に移行し、Claude Codeに、標的組織のシステムとインフラを検査し、最も価値の高いデータベースを特定するよう指示した。Claudeは、人間のハッカーチームが要する時間のごく一部でこの偵察を実行できた。続いて、発見結果の要約を人間のオペレーターに報告した。

第3段階では、Claudeは調査を行い、独自のエクスプロイトコードを作成して、標的組織のシステムのセキュリティ脆弱(ぜいじゃく)性を特定し、侵入テストを行った。攻撃フレームワークはClaudeを使用して認証情報(ユーザー名とパスワード)を収集し、さらなるアクセス権を獲得した上で、大量の機密データを抽出し、情報価値に応じて分類した。

こうして最高権限のアカウントが特定され、バックドアが作成され、人間の最小限の監督でデータが窃取された。

最終段階では、脅威アクターはClaudeに、攻撃に関する包括的な文書を作成させた。その中には、盗んだ認証情報や分析したシステムに関する有用なファイルが含まれていた。これらは攻撃フレームワークが、脅威アクターのサイバースパイ活動の次の段階を計画するのに役立った。

サイバー攻撃の8〜9割でAIを悪用し、人が対抗できないほど高頻度化

全体として、脅威アクターはサイバースパイ活動の8〜9割でAIを悪用したという。Anthropicは「人間の出番は、1件の活動につき4〜6つの重要な意思決定ポイント程度だったに限られていた。AIによって実行された膨大な作業は、人間のチームであれば膨大な時間を要しただろう。攻撃のピーク時には、AIは数千のリクエストを実行し、1秒当たり複数件の頻度に上ることも多かった。人間のハッカーには到底太刀打ちできない攻撃速度だ」と分析している。

攻撃時にもハルシネーションは起こった

Claudeは常に完璧に機能したわけではない。認証情報を取得したはずが、それらが使い物にならなかったり、「機密情報を抽出した」としていたものが、実は公開情報だったりといったこともあった。

こうしたハルシネーションは「完全に自律的なサイバー攻撃」実現の障害となる。

悪用事例を公開し、業界全体での脅威情報の共有を訴える

だが、高度なサイバー攻撃を実行する障壁は大幅に下がっており、Anthropicは、今後も下がり続けると予測している。環境が整えば、脅威アクターは今すぐにでも、エージェント型AIシステムを長期間使用して経験豊富なハッカーチームと同様の作業ができる。標的にするシステムの分析、エクスプロイトコードの作成、盗んだ情報の膨大なデータセットのスキャンを、どの人間のオペレーターよりも効率的に行える。経験やリソースが少ないグループも、今では上記のような大規模攻撃を実行できる可能性がある。

AnthropicはClaudeの悪用事例しか把握していないが、今回紹介した事例は、最先端AIモデル全体に共通する行動パターンを反映しており、脅威アクターが今日の最も高度なAI能力を、サイバー攻撃にどのように悪用しているかを示している。

AIモデルの能力は、これほど大規模なサイバー攻撃に悪用される可能性がある一方で、サイバー防御においても重要だ。

Anthropicは、高度なサイバー攻撃の発生が避けられない中、サイバーセキュリティの専門家が将来の攻撃に備え、その検知、阻止に成功することを支援すべく、Claudeに強力な安全対策を組み込むという。

サイバーセキュリティには根本的な変化が起きており、Anthropicは、企業・組織のセキュリティチームが、SOC(セキュリティオペレーションセンター)の自動化、脅威検知、脆弱性評価、インシデント対応などの領域で、AIを防御に活用する実験を行うことを推奨する。開発者にも、敵対的な悪用を防ぐために、AIプラットフォーム全体にわたる安全対策の継続を推奨する。

Anthropicは、今回紹介した手法について「間違いなく多くの攻撃者によって悪用される」と予測し、業界全体での脅威情報の共有、検知手法の改善、安全対策の強化の重要性を訴えた。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

AIエージェントが変えるサイバー攻撃 アカウント侵害に要する時間は半分に Gartner予測

AIエージェントが変えるサイバー攻撃 アカウント侵害に要する時間は半分に Gartner予測

Gartnerは、AIエージェントが2027年までに、アカウント侵害に関する時間を50%短縮するとの予測を明らかにした。認証情報窃取の自動化や認証通信チャネルの侵害により、認証を悪用するケースが増加する見通しだという。 日本企業の92%が「AIを悪用した攻撃への対策ができていない」と回答 アクセンチュアが調査結果を発表

日本企業の92%が「AIを悪用した攻撃への対策ができていない」と回答 アクセンチュアが調査結果を発表

アクセンチュアは、調査レポート「サイバーセキュリティ・レジリエンスの現状2025」を発表した。AIの急速な普及によってサイバー脅威の規模や巧妙さが増しており、既存のサイバー防御態勢では対応が追い付いていないことが明らかになった。 8割の企業が「“勝手に動く”AIエージェント」を経験、対策は? SailPoint調査

8割の企業が「“勝手に動く”AIエージェント」を経験、対策は? SailPoint調査

SailPointは2025年7月31日、AIエージェントに伴うセキュリティリスクの調査結果を発表した。それによると、AIエージェント導入企業の半数以上が十分なセキュリティ対策を講じていないことが分かった。