CNNからGPT-3.5、Stable Diffusionへ 「GPU」が汎用AIインフラになるまで、需要はどう増え続けたのか:AIとGPUの関係:(3)仮想通貨と生成AIの出現

GPUはHPCやAI用途の発展とともに進化してきたが、初めからその存在が一般ユーザーに強く意識されたわけではなかった。仮想通貨マイニングやLLM、画像生成AIの登場とともに、GPUの需要がどう変わってきたのかを振り返る。

グラフィックス処理(画像や映像を描画するための計算処理)を高速に行うためのプロセッサとして開発された「GPU」(Graphics Processing Unit)が汎用(はんよう)的な数値計算にも使われるようになったいきさつについて、第1回、第2回で紹介してきた。

GPUはまず科学技術計算などに代表される「HPC」(High Performance Computing:高性能計算)、次いで人間の脳の構造を計算的に模した「CNN」(Convolutional Neural Networks:畳み込みニューラルネットワーク)に代表されるAI(人工知能)処理に多用されるようになった。ただしどちらの用途においてもユーザーが直接的に触れる場面は多くなかった。

第2回で紹介したNVIDIAの技法「DLSS」(Deep Learning Super Sampling:深層学習を用いた超解像技術)は例外だが、これも「説明されればAI技術を使っていると理解できる」程度で、ユーザーからすれば“AIを使っている”という実感はあまりない。特に競合としてはAdvanced Micro Devices(AMD)がAIを使わない超解像技術「FSR」(FidelityFX Super Resolution)を開発したり、IntelもAIベースの超解像技術として「XeSS」(Intel Xe Super Sampling)を提供したりとなると、DLSSはAIを使った超解像技術というよりはNVIDIAによる超解像技術という印象が強い。

仮想通貨マイニングから生成AIへ:GPU需要の主役交代

むしろコンシューマーに向けて大きな影響を及ぼしたのは、仮想通貨の爆発的な流行である。2010年ごろに「BitCoin」が実用化し、「計算能力があれば誰でも採掘(マイニング:掘り起こし)できる」ということで、仮想通貨は2017年ごろから突如として爆発的に普及。そしてそれをビジネスにしようという業者が多数出現し、サーバ向けかコンシューマー向けかを問わず世界中のGPUが買い占められるという、過去に見たこともないような現象が起きることになった。

ただし仮想通貨は、一定の報酬を参加者同士で競い合う原理上、採掘する人数が増えるほど採算が合わなくなりやすい。2017年の時点でも必ずしも採算が取れるとは言えない状況だったが、2018年には明らかに採算割れ(採掘で得られる利益より、採掘に要する電気代の方が高額になる)を起こすケースが目立った結果、仮想通貨市場の過熱感は急速に沈静化した。

ところがこれと入れ替わるように、新たなAIの波が押し寄せてくることになる。それが「生成AI」や「LLM」(Large Language Model:大規模言語モデル)と呼ばれる、自然言語処理が可能なAI技術である。2018年、当時はまだ非営利法人だったOpenAIという組織が、「GPT-1」というAIモデルを開発する。GPTは「Generative Pre-trained Transformer」(強いて訳せば「生成的事前学習変換器」)の略で、名前の通り事前学習(大量の文章を読み込ませて、そのデータを基に学習)を行ったモデルを利用して、入力に対応できる結果を生成する仕組みである。

GPT-1からGPT-3.5まで

2018年6月にGPT-1がリリースされ、その後継として2019年2月に「GPT-2」がリリースされている。実際に利用してみるとそれほど賢くない(最大の要因は学習データが十分とは言えなかったことだと考えられるが、GPT-1やGPT-2ではネットワークそのものが十分な学習データを格納できるとは言えなかった)ということで、この時点ではあまり話題にはならなかった。

ところが2020年6月に「GPT-3」(ネットワークの構造そのものはGPT-2とほぼ同じだが、パラメーターの量が10倍になった)がリリースされ、その改良型として2022年3月には「GPT-3.5」がリリースされた。これらのモデルでは精度がかなり上がることが確認され、さらにそのGPT-3.5を対話的に利用できる「ChatGPT」が2022年11月に公開されたことで、多くの一般ユーザーが対話的にAIモデルを利用し始めるという新しい流れが生まれた。

ChatGPTとStable Diffusionの登場:生成AIサービスが一気に“生活圏”へ

このChatGPTと前後するように、2022年8月には画像を生成するAIモデル「Stable Diffusion」も発表された。自然言語の形で入力された指示を読み取り、その内容に一致する画像を生成する「Text-to-image」の仕組みを採用したもので、やはりこちらも事前学習(大量の画像をテキスト付きで読み込ませる形)をベースにしたもので、元々はミュンヘン大学で研究されていた「LDM」(Latent Diffusion Model:潜在拡散モデ)という技法を基にStability AIが開発したものである。当初はクラウドでの実行が必須だったが、ユーザーの手元にあるローカルのGPUカード(ただしVRAM<Video Random Access Memory>が8GB以上搭載されているもの)で実行できるようになり、こちらも爆発的に利用者が増えた。

2026年現在ではご存じのように、GPTやStable Diffusionは非常に広範に使われている。LLMで言えばGPT以外にも「Claude」や「Gemini」があり、「Microsoft Copilot」や「Perplexity」といった生成AIサービスも広く使われている。画像生成AIでも「DALL・E 2」「Adobe Firefly」「Midjourney」などのモデルがある他、Stability AIの「DreamStudio」、Microsoft Researchが公開した「Visual ChatGPT」などさまざまなツールや仕組みが登場している。

LLM系で言えば、それぞれのサービスごとに適不適が割とあるし、GPTをベースに特定業種とか特定分野向けのデータを集めて最適化したサービスなども出てきており、百花繚乱といった趣もある。

ただし、そのバックエンドを見てみると、また違う風景が広がっている。

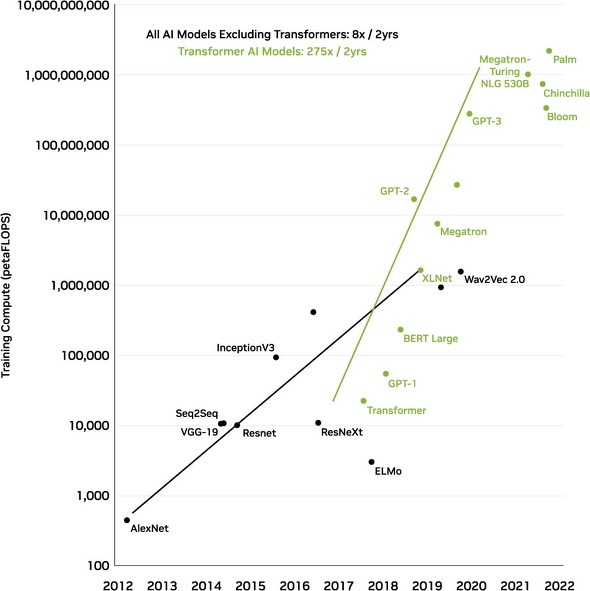

図1は、AIの学習に要する処理性能を比較したものである。縦軸は演算性能で単位は「PFlops」、横軸がそのモデルが登場した時期である。最初にトロント大学が提示したモデルだと、GPU「NVIDIA V100」(以下、V100)を使えば約40分で学習が終わる計算になるのだが、LLMが出てくる以前のCNNでさえ、毎年8倍の割合でモデルが巨大化しており、これに伴って学習時間も増えている。2019年に出た「Wav2Vec 2.0」だと約150万PFlopsが必要とされるので、1枚のV100でこれの学習を終わらせるには1200万秒(139日)を要する。もちろん、そんなに悠長に待ってはいられないので、例えば100枚のV100を連携して稼働させることで1.4日ほどで終わらせるという力業の解決法が取られるわけだ。

LLMの巨大化が招いた“GPU大量消費”:パラメーター数と学習コストの現実

もっと難しいのがLLMで、こちらはモデルがさらに巨大化している。例えばGPT、最新のGPT-4以降のモデルにおけるパラメーター数は公開されていないが、俗に言われているのは、以下である。

- GPT-1:1.17億個

- GPT-2:15億個

- GPT-3:1750億個

- GPT-3.5:3550億個(推定値)

- GPT-4:5000億〜数兆個(推定値)

- GPT-5:1.7兆〜数十兆個(推定値)

単純にパラメーターの数に比例して必要な計算能力が増えるわけではない(パラメーター数ほど増えない場合もあれば、逆にパラメーター数の増分以上に増える場合もある)が、ただLLMを実用に耐えるように「賢く」するためにはどうしてもパラメーター数の増加は避けられず、結果LLMに要求される計算能力は「2年で275倍」などというとんでもない数値になっており、この伸びは現在も変わっていない。

もちろん学習だけではなく推論、つまり学習したデータを基に実際にユーザーの質問に答える部分の方も同様に、必要な計算能力が猛烈な勢いで跳ね上がりつつある。しかも学習の方は一度に一回しか行われない(同じデータを使って複数のモデルの学習を行っても同じモデルが出来上がるだけ)のに対し、推論の方は世界中から同時に、猛烈な量で要求が届くことになる。2025年8月にOpenAIの副社長であるニック・ターレー(Nick Turley)氏が2025年8月に語った実績によれば、ChatGPTのアクティブユーザーはその時点で週7億人を突破した。7億人が常に同時に推論を実行しているわけではないが、その一部だとしても全リクエストを処理するためには膨大な演算能力が必要になる。

こうしたニーズに対し、特にサーバ向けGPUは巨大なデータセンターラックに収められる形で、数千〜数十万枚の規模に達する場合もある。特にLLMの場合、もはや1枚のGPUカードにモデル全体を収め切れなくなっている。例えばGPT-3.5で3550億個のパラメーターが必要と言われているが、これを格納するためには最低でも176GBのメモリが必要となる。ところがこうした大量のメモリを搭載するのはごく一部のハイエンドのサーバ向けGPUのみである。なので複数枚を組み合わせてこのパラメーターをGPUカード上のメモリに格納する必要がある。必然的に枚数は増える方向にならざるを得ない。最近は、例えばMicrosoftの「Copilot+ PC」のように、クラウドではなくPCのローカルで動くようなLLMを実装しているものも増えてきた。これらはさまざまな工夫によって必要となるメモリ量を減らしているものの、その分、返答の精度などに影響が及ぶことがあり、精度や性能が求められるケースでは力不足の声を免れない。

これは画像生成系も同じで、やはり精度を上げようとするとメモリを大量に必要とする。結果、例えば「GeForce」系のコンシューマー向けGPUであっても、搭載メモリ量を16GBに増やしたモデルとして「GeForce RTX 5060 Ti/5070 Ti/5080」がミドルクラスに提供されている。ちなみに、画像生成などを頻繁に実行するユーザーの間では、大容量メモリと高い演算性能を備えたハイエンドGPUが好まれる傾向にある。32GBのメモリを搭載した最上位クラスの「GeForce RTX 5090」(写真)のような製品に人気が集まるのも、もっともなことである。

筆者紹介

冨永 嘉之(とみなが よしゆき) NTTPCコミュニケーションズ

約15年にわたりWebARENAホスティングサービスの企画・開発に従事。VPS/IaaSサービス「Indigo」「Indigo Pro」の開発およびサービス立ち上げを主導してきた。現在はAIソリューション事業部にて、GPUクラウドやNVIDIA Omniverseを実行基盤とするVDIクラウドの企画・開発を担当。インフラ事業者としての技術的強みを生かしながら、AIを活用したアプリケーションを前提としたプロダクト設計や役割分担を意識し、フィジカルAI分野への展開を見据えたサービス企画を推進している。

大原 雄介(おおはら ゆうすけ) テクニカルフリーライター

ITよりもう少し下のレイヤー(半導体技術、OS、CPU・メモリ・I/O・ストレージ・ネットワークのアーキテクチャなど)と組み込み向けを分野とするテクニカルフリーライター。

過去のWeb掲載記事は http://www.yusuke-ohara.com/ に一覧あり。

最新の掲載記事は https://bsky.app/profile/yusukeohara.bsky.social に。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

AI分野での活用も増加している「GPU」の種類と選び方を学ぼう

AI分野での活用も増加している「GPU」の種類と選び方を学ぼう

IT用語の基礎の基礎を、初学者や非エンジニアにも分かりやすく解説する本連載、第19回は「GPU」です。ITエンジニアの学習、エンジニアと協業する業務部門の仲間や経営層への解説にご活用ください。 GPUが足りない、脚光を浴びる「ネオクラウド」とは? McKinseyが解説

GPUが足りない、脚光を浴びる「ネオクラウド」とは? McKinseyが解説

McKinsey & Companyは、GPUが不足する中で登場し、台頭してきた「ネオクラウド」について、市場における立ち位置や、今後の展開について考察した記事を公開した。 生成AI時代のAI基盤を構築 Kubernetesの最新技術「DRA」と「GPU Operator」で実現するGPUクラスタとモニタリング環境構築方法総まとめ

生成AI時代のAI基盤を構築 Kubernetesの最新技術「DRA」と「GPU Operator」で実現するGPUクラスタとモニタリング環境構築方法総まとめ

気軽に試せるラップトップ環境で、チャットbotを提供するオールインワンの生成AI環境構築から始め、Kubernetesを活用した本格的なGPUクラスタの構築やモデルのファインチューニングまで解説する本連載。今回はNVIDIA製GPUを用いたKubernetesクラスタの構築方法をモニタリング環境の構築手順を交えて解説します。