面倒なセキュリティ業務は生成AI・エージェンティックAIによる自動化で、どこまで変わるのか?:セキュリティ担当者の今後は

生成AIの登場で世界中が激変しつつある中、サイバーセキュリティの分野も例外ではない。攻撃者による悪用ばかりが取り上げられ、守る側もAIを活用しないと対抗できないと言われているが、どう活用できるのかイメージできずに導入をためらう企業は多い。SOCなどセキュリティ運用の現場も同様だ。SOCアナリスト向けの生成AI・エージェンティックAI活用に詳しい有識者に、活用例や今後の人の役割などを聞いた。

ChatGPTに象徴される生成AI(人工知能)の登場によって、文章作成からソフトウェア開発までさまざまな知的作業の在り方を一変させている。サイバーセキュリティの分野も例外ではない。生成AIの登場は、攻撃を巧妙化、高度化させるといった側面から語られることもある一方で、解析やセキュリティ運用を効率化し、守る側の力を高めるツールとしても有望だ。既に自社製品で生成AIを活用しているExabeamのセキュリティリサーチ担当シニアディレクター、Steve Povolny(スティーブ・ポヴォルニー)氏に最新の動向を尋ねた。

「自動化、LLMでセキュリティ業務を効率化」の具体例

生成AIやLLM、AIエージェントは、コンテンツ作成やソフトウェア開発、医療や金融、教育など、ありとあらゆる分野で活用され始めている。サイバーセキュリティも、その分野の一つだ。「RSAカンファレンス2025」でも「AI」はキーノートや各セッションでのホットトピックとなっており、ポヴォルニー氏もAIをテーマに講演している。

AIとセキュリティについては「攻撃者が生成AIを悪用してより巧妙なフィッシング詐欺を仕掛けたり、脆弱(ぜいじゃく)性を見つけて攻撃コードを生成したりするのが容易になる」といった文脈で語られることもある。それ以前に、プライバシーとコンプライアンス、プロンプトインジェクションの懸念や、バイアスがかかったデータを学習することによるハルシネーションなどの課題も存在する。

そうしたリスクは踏まえながらも、ポヴォルニー氏は「セキュリティオペレーションセンター(SOC)で積極的にLLMを活用すべきだ」と話す。「LLMはSOCにおける繰り返し作業を自動化してアナリストの作業負荷を軽減し、効率を高め、ひいてはセキュリティを高める上で非常に重要な手段となる」

具体的には、インシデント発生時の対応手順をまとめたプレイブックや要約、レポート作成の自動化が挙げられる。さらに脅威インテリジェンスや資産の重要度といったコンテキストを踏まえながらインシデントを分類し、優先順位を付けることも可能だ。これらによって、Exabeamの得意領域「脅威の検出、調査、対応」(TDIR)を効率化できるという。

他にも、より高度なフィッシングメールやWebサイトを用いたペネトレーションテストに活用したり、AIを活用してセキュリティ機器に適用するルールの作成・チューニングを自動化したり、共通情報モデルとの整合性をチェックしたりといった活用方法が考えられる。

「AIエージェント」「エージェンティックAI」はSOCにどう役立つのか

こうした生成AI・LLMの有効性に加え、ポヴォルニー氏が着目しているのが「AIエージェント」「エージェンティックAI」の活用だ。

「AIエージェントは、特定タスクを遂行するための目的主導型のコンポーネントだ。エージェンティックAIは、変化する状況に対して学習、適応できる自律型システムと言える。AIエージェントがレシピや食材、作り方を提案してくれるレシピアプリならば、エージェンティックAIは1週間分の献立を作成して、必要な食材の購入や受け取りを手配する。今はまだ難しいかもしれないが、いずれは調理までしてくれるような存在だ」

一般的なSOCは、IDS(不正侵入検知システム)/IPS(不正侵入防御システム)やEDR(Endpoint Detection and Response)、NDR(Network Detection and Response)などのログをSIEM(Security Information and Event Management)に集約して、脅威の兆候があればアラートを発する。アナリストはアラートを受け取ると、脅威インテリジェンスなどと付き合わせながらログを精査して、「何が起こり、どのような影響があるのか」を把握した上で封じ込めなどの対処に移る。

LLMやAIエージェントを活用することで、こうした一連のプロセスを自動化し、効率化できるとポヴォルニー氏は説明する。

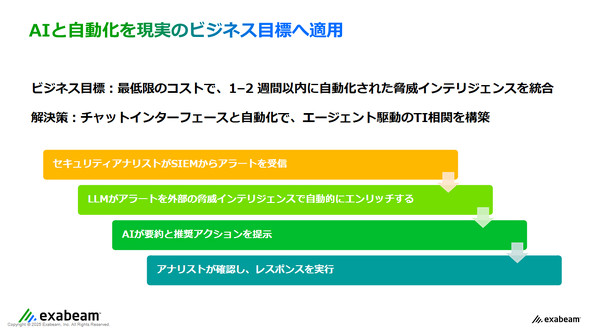

「LLMによって脅威インテリジェンスを用いたアラートのエンリッチメントを自動化し、AIが状況の要約と推奨アクションを提示し、アナリストはその内容を確認してレスポンスを実行する。AIと自動化を活用することで、非常に低コストかつ短期間で脅威インテリジェンスを活用した運用が実現できる」

そんなAIエージェントを活用してSOC運用を支援する一例が、オープンソースのフレームワークを組み合わせて作られた「Self-hosted AI starter kit」(以降、スターターキット)で、GitHub上で公開されている。スターターキットは、包括的なローカルAIやローコード開発環境を迅速に立ち上げるために設計されたDockerテンプレートだ。ポヴォルニー氏はキットを使い簡単なチャットインタフェースを作成し、自作のAIツールを活用して基本的な脅威インテリジェンスを実行できるようにした。チャットのインタフェースから自然言語で「この特定のハッシュ値を含むログはありますか?」と尋ねると、該当するログを見つけ出す。侵害の兆候であるIoC(Indicator of Compromise)を抽出し、「VirusTotal」などの脅威インテリジェンスで検索して「どのようなマルウェアが、そのIoCを残すのか」といった情報まで得ることができる。この結果、アナリストの生産性向上につながる。

「こうした解析は何千行ものログを対象にするので、上級アナリストでさえ何時間もかかる困難な作業だった。こうした領域にこそLLMやAIエージェントが生かせる」

オープンソースの活用が難しい企業はどうすればいいのか

LLM実行環境をローカルで構築しているスターターキットには、ハルシネーションや正確性に課題が残る。精度を実運用レベルに高めるには、プロンプトの設計やモデルサイズの選定をさらに慎重に行う必要があるが、Exabeamはこのようなワークフローの自動化やAIツールとの統合は不可欠と考えているという。

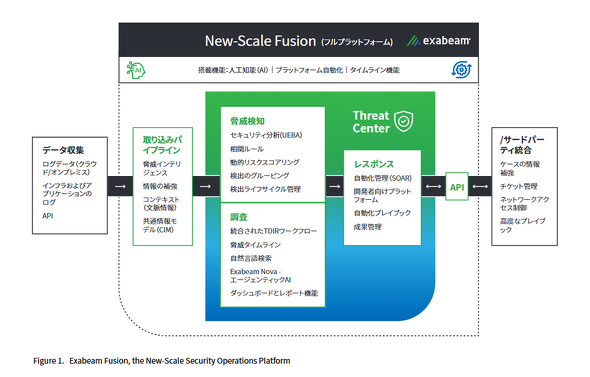

既にExabeamは、AIを活用してSOC運用の自動化を支援する製品を展開している。同社のエージェンティックAI「Exabeam Nova」を統合した「Exabeam New-Scale Fusion」だ。Novaを活用して、調査や分析アシスタント、検索、アドバイザーといった6種類のエージェントが利用できる。

New-Scale Analyticsは、自動化の課題や業務効率化の問題を解決することを目的としている。すなわち、SOCにおける解析作業を効率化することで定型的で単調なタスクを軽減し、アナリストがより生産性高く脅威の検出や対応に当たれるようにする。

New-Scale Analyticsはプラットフォームに蓄積された「アラートケース」を掘り下げ、AIエージェントが生成した調査概要や脅威に関連するユーザーやデバイス、IPアドレス、URLなどの情報を把握できる。インシデント対応のために推奨される修復手順も、AIエージェントが生成して提示する。以前はアナリストが数百件ものログや検出結果、イベントを精査する必要があったが、New-Scale Analyticsはシンプルな概要を見ることから調査を開始できるという。

チャット形式のインタフェースで問い掛けながらインタラクティブな調査もできる。「『Mimikatz』とは何か?」といった一般的な質問はもちろん、「なぜこのケースは『内部関係者による侵害』と分類されたのか根拠を教えてほしい」といった個別ケースについて尋ねると、「最初にエンドポイントがログインしたイベントの後に異なる国から新たなネットワークゾーンへのログインが試行されたから」といった具体的な回答を得られる。

従来はクエリに関する高度な知識を持たなければ実現できなかった「あるユーザーの過去2週間分のイベントの中から、疑わしいものをピックアップしたい」といった複雑な調査を自然言語で、それも英語だけでなく日本語も含めた多言語で行えることをポヴォルニー氏はデモンストレーションを交えて説明した。

こうした生成AIの利点を生かすための鍵となっているのが、Exabeamが従来、強みとしてきた機械学習をベースに脅威を検知、対応する特許技術だ。生成AI時代になってもその強みは変わらず、むしろ機械学習とAIを組み合わせることで、より効果が発揮される。

「大量のデータをただLLMに学習させても、モデルは機能不全に陥るだけだ。機械学習は行動のモデル化に非常に有効で、あるユーザーの行動を時系列でプロファイリングし、モデル化して普段と異なる異常な行動を検出するには、依然として効果的な方法だ。一方、生成AIはそうした用途には適していないが、自然言語で非常に複雑なクエリを実行できる。機械学習モデルを用いて高精度で検出するとともに、生成AIを利用して分析結果を要約することで調査プロセスを簡素化できる」

こうした製品を通して、同社はセキュリティアナリストのスキルセットを向上させることを目指している。「モデルがどのようなイベントを検出したか」をさかのぼってトレースできるようにすることで「説明可能なAI」を実現する。「Human in the loop、つまり人間が調査のワークフローに介在することで、アナリストに取って代わるのではなく、アナリストの経験をより拡張する」と同氏は力を込める。

「Exabeamの強みは機密性やプライバシーにも十分に配慮を払い、製品プラットフォームに生成AI・エージェンティックAIの機能を統合済みである点だ。プラットフォーム内の6種類のAIエージェントを追加コストなく利用できる。システム全体を俯瞰(ふかん)してセキュリティポスチャをチェックし、改善すべきポイントを指摘するエージェントが含まれている」

既に海外はもちろん、国内でもNovaを搭載したプラットフォームを活用して、インシデントの調査、対応に要する時間を大幅に短縮できた顧客が業種を問わず存在する。

AIの進化で、セキュリティ担当者の役割はどう変わるのか

Exabeamは、AIを活用した自動化をさらに強化する方針だ。プレイブックを学習してマルウェアを検出した後に自動的にその内容を実行して、感染したマシンをネットワークから隔離後にイメージを再作成してからアナリストに作業完了のメールを送る、といったことまで自動化できないかリサーチしている。

「こうなるとセキュリティ担当者の主な役割は、AIエージェントの実行結果をレビューすることになるだろう。AIについて過大評価も過小評価もすべきではない。私たちはまだAIが持つ可能性のほんの表面に触れたばかりだ。引き続きよりリッチなSOCを実現すべく強化に取り組み、新たな可能性を模索する」

Copyright © ITmedia, Inc. All Rights Reserved.

関連リンク

提供:Exabeam Japan株式会社

アイティメディア営業企画/制作:@IT 編集部/掲載内容有効期限:2025年10月12日