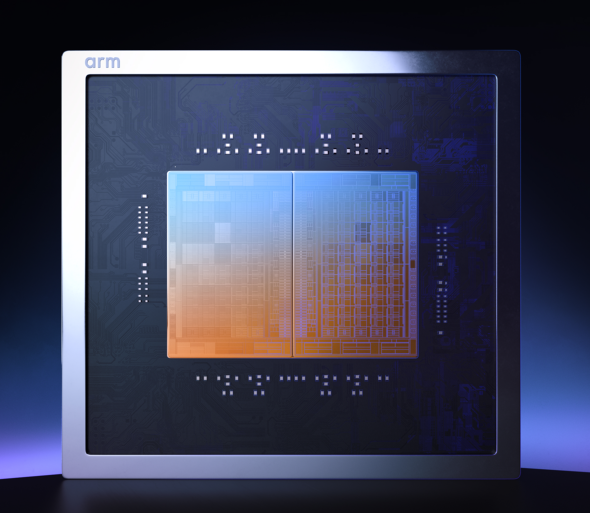

「x86では処理し切れない」 ArmとMeta、AIインフラ向け「CPU」を開発:Armとしては初めての量産半導体

ArmとMetaはデータセンター向けCPU「Arm AGI CPU」を共同開発すると発表した。限られたスペースで大規模な演算能力を実現し、従来のCPUを超えるラック当たりの処理能力を効率よく向上させる。

英国の半導体開発会社ArmとMeta Platforms(以下、Meta)は2026年3月24日(英国時間)、データセンター向けのCPU「Arm AGI CPU」を共同で開発すると発表した。Arm AGI CPUは、AIワークロードのために設計され、従来のCPUよりもラック当たりのパフォーマンスを大幅に向上させるという。

Armは半導体製品の設計を手掛けるビジネスモデルで成長してきたが、Arm AGI CPUでは同社としては初めてとなる半導体の量産、販売に乗り出すことになる。

x86比で性能2倍、AIインフラのCAPEX削減を可能に

Arm AGI CPUは、増大するエージェント型AIワークロードに対応するために設計された、AIデータセンター向けのCPU。MetaはArm AGI CPUの筆頭パートナーおよび共同開発者として参画し、自社インフラの最適化に使用するとともに、Metaのカスタムチップ「MTIA」と連携させて展開する計画だ。

ArmはArm AGI CPUを提供する背景として、AIエージェントの台頭によって世界のコンピューティングが大きな転換点を迎えている点を挙げている。AIモデルのトレーニングから推論、自律的に動くエージェントの展開へと移行するにつれて、AIシステム全体で生成されるトークン量は急速に増加している。それを処理するためには、同じ電力枠内ではるかに多くの演算能力が求められる。

同CPUについてArmは、従来の「x86」アーキテクチャのCPUと比較して、ラック当たり2倍以上のパフォーマンスを提供し、AIデータセンターのCAPEX(設備投資)削減を可能にするとしている。

AIの進化とともに再定義されるインフラ

ArmとMetaは「AIの進化に伴うインフラの再定義」という共通のビジョンを掲げている。

Metaのインフラ責任者であるサントッシュ・ジャナードハン氏は、世界規模のAI体験を提供するには、性能を極限まで最適化した「堅牢(けんろう)で適応力あるカスタムシリコンのポートフォリオが不可欠だ」と述べる。「Armとの共同開発により、データセンターの性能密度を大幅に向上させ、進化し続けるAIシステムを支える複数世代のロードマップを確立できた」

一方、ArmのCEOレネ・ハース氏は、「MetaとのArm AGI CPUの共同開発は、大規模なエージェント型AIのデプロイに最適化された本番環境向けCPUへと拡張する、Armプラットフォームの新たなフェーズを示すものだ」と述べている。

Arm AGI CPUはArmを通じて広くAIエコシステムに提供される。MetaはCPUのボードとラックの設計を、データセンターの効率を向上させるためのコミュニティーOpen Compute Project(OCP)で2026年後半に公開する。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

第308回 NVIDIAの一強は続くのか? 新プラットフォーム「Rubin」が描くエコシステムとDRAM危機の正体

第308回 NVIDIAの一強は続くのか? 新プラットフォーム「Rubin」が描くエコシステムとDRAM危機の正体

NVIDIAが新プラットフォーム「Rubin」を発表。AI需要の爆発によりDRAM不足が深刻化し、PCやスマホの供給にも影響が出始めている。単なるチップから「エコシステム」へと進化し、ネットワークやストレージまでをも飲み込もうとするNVIDIAの戦略と、AIへの過度な投資が招く世界規模のリスクを考察する。 従来サーバと何が違う? GPU増設では越えられない「AIインフラの壁」の正体

従来サーバと何が違う? GPU増設では越えられない「AIインフラの壁」の正体

生成AIを自社環境で本格運用する際、最初に直面する可能性があるのが「インフラの壁」です。AIシステムの安定稼働や、性能確保のために押さえておくべきAIインフラの基本的な知識について、GPUサーバや冷却・電力設備、ストレージなどの観点から解説します。 CNNからGPT-3.5、Stable Diffusionへ 「GPU」が汎用AIインフラになるまで、需要はどう増え続けたのか

CNNからGPT-3.5、Stable Diffusionへ 「GPU」が汎用AIインフラになるまで、需要はどう増え続けたのか

GPUはHPCやAI用途の発展とともに進化してきたが、初めからその存在が一般ユーザーに強く意識されたわけではなかった。仮想通貨マイニングやLLM、画像生成AIの登場とともに、GPUの需要がどう変わってきたのかを振り返る。