AIの推論コストは90%下落も、企業の予算を圧迫か Gartnerが警告:2030年に登場するLLMの推論コスト 2つのシナリオで予測

Gartnerは、2030年までに1兆パラメーターの大規模言語モデルによる推論コストが生成AIプロバイダーにとって2025年比で90%超低下すると予測した。一方、エージェント型AIの普及でトークン需要が増大するため、企業が支出する推論の総コストは増加する見通しだという。

調査会社Gartnerは2026年3月25日(米国時間)、2030年までに1兆パラメーターの大規模言語モデル(LLM)による推論の実行コストが、生成AIプロバイダーにとって2025年比で90%超低下するという予測を発表した。

Gartnerのシニアディレクターアナリストであるウィル・ソマー氏によると、コスト改善は半導体とインフラの効率改善、モデル設計の革新、チップ利用率の向上、推論特化シリコンの活用増加、特定ユースケースへのエッジデバイスの活用拡大によってもたらされるという。

2030年のLLMは最大100倍のコスト効率を実現? 2つのシナリオで予測

こうした傾向を受けて、Gartnerは、2030年のLLMは2022年に開発された同規模の最初期モデルと比較して最大100倍のコスト効率を実現すると予測している。

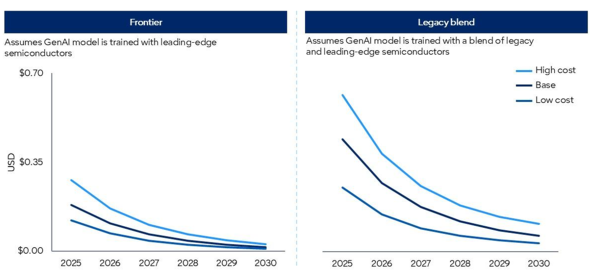

この予測について、Gartnerは最先端チップによる「最先端シナリオ」(下図左)と、市場で入手可能な半導体の代表的な組み合わせに基づく「従来型ブレンドシナリオ」(下図右)の2つのシナリオに基づいて予測した。

「計算能力が低いことを考慮すると、従来型ブレンドシナリオにおけるコストは、最先端シナリオよりもかなり高くなる」(Gartner)

推論コストの低下は「最先端AIの民主化」と同義ではない

Gartnerは、生成AIプロバイダーのトークン単価の低下がそのまま企業顧客に還元されるわけではないと指摘している。トークンとは、生成AIモデルが処理するデータの単位で、3.5バイトのデータ、英語で約4文字に相当する。

エージェント型AIは標準的な生成AIチャットbotと比較して1タスク当たり5〜30倍のトークンを必要とし、人間が生成AIを使用する場合よりもはるかに多くのタスクを実行できる。

トークン単価の低下が高度な生成AIの利用を可能にする一方で、トークン需要を不均衡に押し上げる。トークン消費量の増加がトークン単価の低下を上回るため、推論の総コストは増加する見通しだ。

ソマー氏は次のように述べている。

「CPO(最高製品責任者)はコモディティ型AIのトークン価格の下落を、『最先端推論の民主化』と混同してはならない。コモディティ化したAI能力のコストがほぼゼロに近づく一方、高度な推論を支えるコンピューティングリソースは依然として希少なままだ。そのため、安価なトークンでアーキテクチャの非効率さを覆い隠しているCPOは、エージェント型AIの大規模展開が困難になるだろう」

Gartnerは、多様なモデルポートフォリオにわたってワークロードをオーケストレーションできるプラットフォームに価値が集中すると分析している。日常的な高頻度タスクはわずかなコストで高いパフォーマンスを発揮する「小規模かつドメイン特化型の言語モデル」に振り向け、最先端モデルの高コスト推論は高利益率が見込まれる複雑な推論タスクに限定することがより重要になるとの見解を示している。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

生成AIは幻滅期、AIエージェントは「過度な期待」のピーク ガートナー「未来志向型インフラテクノロジーのハイプ・サイクル」

生成AIは幻滅期、AIエージェントは「過度な期待」のピーク ガートナー「未来志向型インフラテクノロジーのハイプ・サイクル」

ガートナージャパンは「2025年の日本における未来志向型インフラテクノロジーのハイプ・サイクル」を発表した。未来志向型と捉えられる技術やトレンドとなっている35のキーワードを取り上げた。 生成AIは“使う”から“作る”へ 自前構築を選ぶべき理由と「基本の型」とは

生成AIは“使う”から“作る”へ 自前構築を選ぶべき理由と「基本の型」とは

生成AIをサクっと業務活用したい人のための本連載。生成AIチャットbotの課題やリスクを超えるための「自前で構築する」という選択肢について解説します。 「GPUサーバが使える」データセンターを1年で立ち上げ――NTT東日本が“コンテナ型DC”に参入

「GPUサーバが使える」データセンターを1年で立ち上げ――NTT東日本が“コンテナ型DC”に参入

AI活用が広がり、GPUサーバを収容可能なデータセンターが不足することを受け、NTT東日本子会社のNTT-MEがコンテナ型データセンター事業に参入する。短期間で構築でき、地方分散も可能な方式として提供する。 ローカルLLMって何? メリット、デメリット、活用例を分かりやすく解説

ローカルLLMって何? メリット、デメリット、活用例を分かりやすく解説

ローカルLLMは、クラウドサービスではなく、社内サーバやクライアント端末上でLLMを利用できる技術だ。本記事では、GPUコストや運用面に不安を抱えるIT部門、情報システム担当者、経営層向けに、ローカルLLMの概要と導入のポイントを分かりやすく解説する。 超高速のエージェント型コーディングAI「Grok Code Fast 1」が登場 高性能と低コストを両立

超高速のエージェント型コーディングAI「Grok Code Fast 1」が登場 高性能と低コストを両立

xAIが開発したエージェント型コーディング特化の新AIモデル「Grok Code Fast 1」が登場。超高速応答で、高性能と低コストを両立。xAI APIや、GitHub Copilot、Cursorなどから利用できる。