「間違った情報を自信たっぷりに言う問題」に対応したAIモデル Googleが発表:「Project Tailwind」からブランド名を変更

Googleはノート作成ソフトウェア「NotebookLM」について発表した。生成AI(人工知能)のようにテキストを要約させたり提案をさせたりすることができる。最も大きな特徴は、言語モデルをユーザーごとに「グラウンド」できることだ。

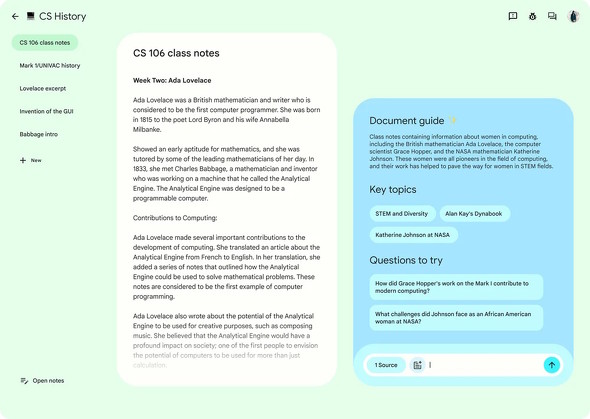

Googleは2023年7月12日(米国時間)、ノート作成ソフトウェア「NotebookLM」について発表した。これは2023年の「Google I/O」で発表された「Project Tailwind」から名前を変えたもので、Google Labsの実験的な製品として展開される。強力な言語モデルを備えており、生成AIのようにテキストを要約させたり提案をさせたりできる。

ハルシネーションにはグラウンディングで対抗

Googleは次のように述べている。

「情報が急激に増加したことで、その扱いに悩む人が増えている。複数のソースから事実やアイデアを統合することは容易ではないし、新しい情報源を見つけても既存の情報とのつながりを作るために時間がかかるという問題もある」

この問題を解決するため生成AIなど対話型のAIモデルを使う動きもあるが、「誤った情報でも自信たっぷりに回答してしまう」という課題(“ハルシネーション”<幻覚>)もある。NotebookLMはこの課題に対応するため、ユーザーのノートや情報源に言語モデルを“グラウンディング”(土台にする、根付かせる)できるようになっている。これは簡単に言えば、AIが回答に使うソースをユーザーが設定できるということだ。

例えば、医学生が神経科学に関する科学論文をNotebookLMにアップロードし、「ドーパミンに関連する主要用語の用語集を作成してください」と指示すれば、論文を基にした適切な用語集を作成できる。

Googleは、NotebookLMの利用方法として「要約」「質問への回答」「アイデアの創出」の3つを想定している。NotebookLMがアクセスできるのはユーザーが設定したソースだけで、スクリプトなどのユーザーの情報は他者には公開されず、「新しいAIモデルのトレーニングにも使用されない」としている。

先に述べたようにAIの回答ソースが明確なため、“ハルシネーション”の懸念は減る。また、複数のソースを使用している場合は各回答にソースから最も関連性の高い引用を表示されるため、Googleは「簡単にファクトチェックできる」と話す。ただし、基にするデータに不備(もしくは間違い)があると当然回答もそれに準じたものになる。Googleもその点については「AIの回答を基のソースと照らし合わせて事実を確認することは常に重要だ」と注意を促している。

なお、2023年7月現在、NotebookLMは米国の一部のユーザーやグループに対してのみ提供される予定だ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Google開発者1000人が答えた「Rustのウワサ」、習得に6カ月以上かかる? 実は遅い? は本当か

Google開発者1000人が答えた「Rustのウワサ」、習得に6カ月以上かかる? 実は遅い? は本当か

Rustの採用が増加しているGoogleが、1000人を超える開発者からの意見を参考に、5つの“うわさ”に向き合った。 大規模言語モデルの「創発的」能力(Emergent Abilities of Large Language Models)とは?

大規模言語モデルの「創発的」能力(Emergent Abilities of Large Language Models)とは?

用語「創発」について説明。大規模言語モデルの計算量やパラメーター数が非常に大きくなると、“あるところ”を境に、突然、新しい能力を獲得して性能が大きく向上する現象を指す。 Stability AI、「LLaMA」ベースのオープンLLM「FreeWilly」を発表

Stability AI、「LLaMA」ベースのオープンLLM「FreeWilly」を発表

Stability AIと同社のCarperAIラボは、オープンにアクセスできる新しい大規模言語モデル(LLM)「FreeWilly1」とその後継の「FreeWilly2」を発表した。