約4割のSaaSがAIを利用 データ利用のルールが不明確なケースも アシュアード調査:預託データをAI学習に利用するSaaS、2割がルール未策定

アシュアードは、約4割のSaaSがAIを利用し、2割は預託データをAI学習に活用しているとの調査結果を発表した。データ利用のルールやポリシーが不明確なサービスも散見されるという。

Web会議ツール連携型AI(人工知能)アシスタント、営業支援(SFA)AIツール、ドキュメント作成、要約AIサービスなど、いわゆる「AI SaaS」の活用がIT部門に限らず、企業の間で広まりつつある。

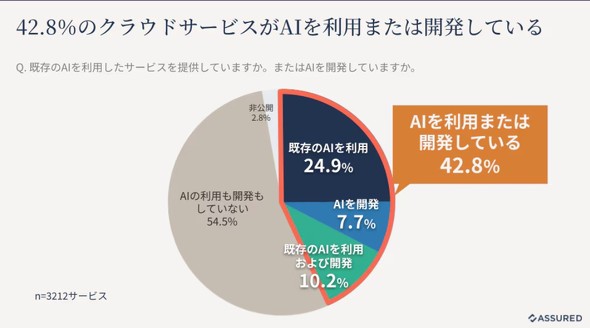

アシュアードが実施した調査(2025年7月実施)によると、調査対象となった3212サービスの内、ChatGPTなど既存のAIを利用したり、自社でAIを開発したりしているサービスが42.8%に上るという。アシュアードは、これらのSaaSの中には、一見するとAIに関係のないように見えるサービスでも、実は内部でAIを利用しているという「隠れAI」サービスもあったと指摘する。

預託データをAIの学習に利用するSaaS データ収集、利用ルール「未策定」が2割

一方、AIを利用または開発しているサービスにおいて、ユーザー企業が入力したプロンプトやアップロードしたファイルが、AIの学習データとして再利用されるか否か、あるいは外部に共有されるかといった「データの利用目的と範囲」が、契約書やプライバシーポリシー上で不明確なケースが散見されたという。

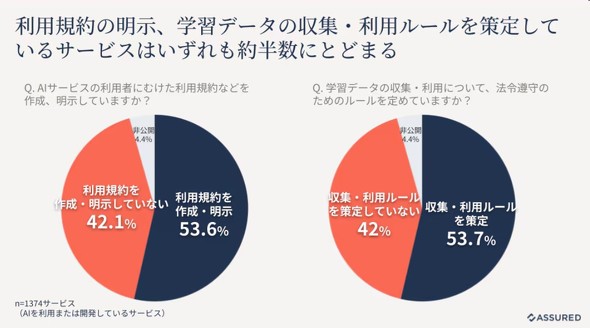

「AIサービスの利用者にむけた利用規約などを作成、明示している」サービスは53.6%、「学習データの収集、利用について、法令順守のためのルールを定めている」サービスは53.7%にとどまり、約4割が未実施という状況だった。

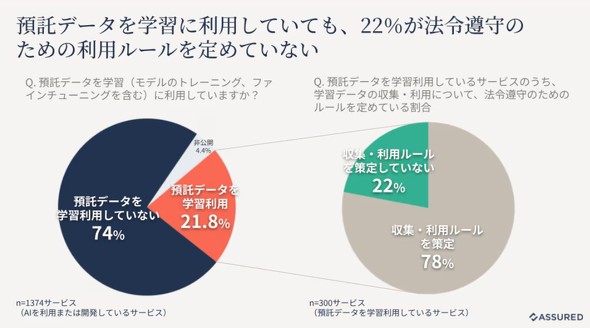

さらに注意が必要なケースとして、2割強のサービスが「預託データを学習(モデルのトレーニング、ファインチューニングを含む)に利用する」と回答した一方、これらのサービスの内、学習データの収集、利用ルールを定めていないサービスが22%あった。

アシュアードは「企業は気付かぬ内に、機密情報や個人情報が意図せずAIの学習に利用されたり、コンプライアンス違反や情報漏えいのリスクを抱えたりする可能性が高まる」と指摘。またAIを利用または開発しているサービスの中には、情報セキュリティ確保のための組織体制(セキュリティリスクの管理体制やセキュリティインシデントへの対応体制など)が十分に確立されていないケースも見られた。

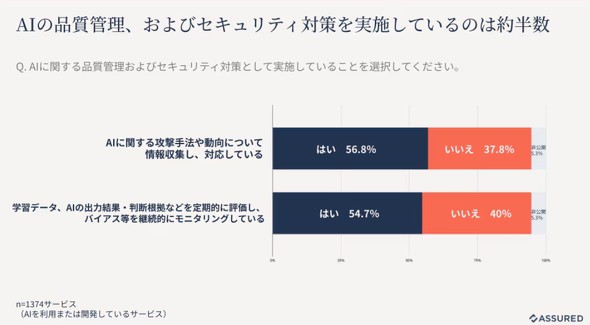

「AIに関する攻撃手法や動向について情報収集し、対応している」のは56.8%、「学習データ、AIの出力結果、判断根拠などを定期的に評価し、バイアスなどを継続的にモニタリングしている」のは54.7%と、約4割が未実施の状況だった。

アシュアードは「各社が提供するSaaSなどにおいて、AIの利用を前提としたサービスが増えていることを示している。これらのサービスを利用する際には、AIならではの観点でセキュリティ対策状況を確認する必要がある」と述べている。

SaaS導入の際、機能やコストだけでなく「AIの利用実態」や「預託データの学習有無」といった、これまでのSaaS選定にはなかったAI観点での評価が必要となりつつある。加えて、この問題はSaaSを提供する事業者だけでなく、自社のアプリケーションやサービスに生成AIを組み込むことを検討する企業にとっても、人ごとではない。生成AIを活用する上で、顧客データや個人情報の取り扱いに関するポリシーに加えて、AIの利用や学習に関するポリシーも整備し、ユーザーに開示するといった新たな取り組みが不可欠となる。

なお、こうした取り組みを進めていく上で参考になるのが、総務省と経済産業省が公開している「AI事業者ガイドライン」だ。「AI開発者」「AI提供者」「AI利用者」という3つの主体に分けて、それぞれが取り組むべき指針を示している。こうした情報源も参考にしながら、率先して取り組みを推進すべきだろう。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

生成AI活用は「データの壁」に阻まれる 経営層が知るべき、デジタル庁の「データガバナンスガイドライン」とは

生成AI活用は「データの壁」に阻まれる 経営層が知るべき、デジタル庁の「データガバナンスガイドライン」とは

多くの企業が生成AI活用に意欲を示す一方、「データの品質」が成果を妨げる最大の要因となっている。では、生成AIに注目する企業の経営層は何に取り組むべきなのか。そこで役立つのが、デジタル庁が2024年6月に公開した「データガバナンスガイドライン」だ。 世界のAI投資額、1分間に121万ドル超 前年比312%増 Domo調査

世界のAI投資額、1分間に121万ドル超 前年比312%増 Domo調査

生成AIの活用が広まる中、Domoは年次レポート「Data Never Sleeps:AI版」で、そのインパクトを1分間という単位で可視化した。世界のAI投資額は1分間に121万ドル超となるなど生成AIは加速の一途をたどっている。 AI開発が“壊滅的な結末”につながる可能性は? AI専門家と精鋭予測者が予測

AI開発が“壊滅的な結末”につながる可能性は? AI専門家と精鋭予測者が予測

「ChatGPT」の登場以来、生成AIが急速に普及している。多様な生成AIモデルが登場する中、急激な進歩により「AIが人間にとって制御不能な存在になるのでは」と懸念する議論も起こりつつある。では、AI開発が進むことでそうしたリスクが顕在化する可能性はどの程度あるのか。