AI開発が“壊滅的な結末”につながる可能性は? AI専門家と精鋭予測者が予測:「社会リスク」の評価、予測結果は真っ二つに割れる

「ChatGPT」の登場以来、生成AIが急速に普及している。多様な生成AIモデルが登場する中、急激な進歩により「AIが人間にとって制御不能な存在になるのでは」と懸念する議論も起こりつつある。では、AI開発が進むことでそうしたリスクが顕在化する可能性はどの程度あるのか。

「ChatGPT」に代表される生成AI(人工知能)の急速な普及が、ビジネスだけでなく研究開発(R&D)や、人々の日常生活にも大きな変化をもたらしている。特にソフトウェア開発におけるコード生成/変換、データ分析など、これまで人間が行っていた多くのタスク、業務を効率化する手段として大きく注目されている。

だが、AIの急激な進歩により、技術革新のサイクルがこれまで以上の速度で進むことで、人間による制御が困難になる可能性やリスクも指摘されている。では、AI開発が進むことでそうしたリスクが顕在化する可能性はどの程度あるのだろうか。

こうした背景の下、最先端のAIシステムの能力を科学的に評価し、その潜在的なリスクを明らかにすることを目指す非営利研究機関のMETR(Model Evaluation & Threat Research)は、米国の民間シンクタンクであるFRI(Forecasting Research Institute)と共同でパイロット研究を実施。以下の2つの出来事が発生する可能性を予測するとともに、AIの急激な進歩が社会に与える影響を調査した。

- もしAIが2027年までに多様なAI R&Dタスクにおいてトップレベルの人間の研究者と同等の能力を獲得した場合、その後、AIの進歩率が3倍以上に加速する可能性はどの程度あるか(この加速とは、ChatGPT登場以前から最近のChatGPT 5リリースまでの過去3年間分に相当するAIの改良が、毎年見られるようになることを指す)

- もしAIが急激に進歩した場合、社会に極端な事象をもたらす可能性はどの程度あるか。世界のエネルギー消費量が前例のない変化(1年で半減または倍増)を遂げたり、破滅的な結末を迎える可能性が高まったりする可能性はあるか

同調査は、AIと機械学習の技術研究経験を持つ8人の専門家と、過去の予測コンテストで高い予測精度を達成した10人の精鋭予測者(スーパー予測専門家)(*)への調査結果に基づいている。調査では、AIの進歩を「実効計算能力」(Effective Compute)と呼ばれる指標で測定している。これは計算リソースの増加と、アルゴリズム改良の両方を含む尺度だ。

*精鋭予測者は、予測プラットフォーム「Good Judgment Open」で高い正確性を達成した人、または米国の知能高等研究計画局(IARPA)が2011年から2015年にかけて実施したAggregative Contingent Estimation(ACE)プログラムにおいて、予測の正確さで上位2%に入る成績を収めた人を対象としたという。

専門家と精鋭予測者で「社会リスク」評価が真っ二つに

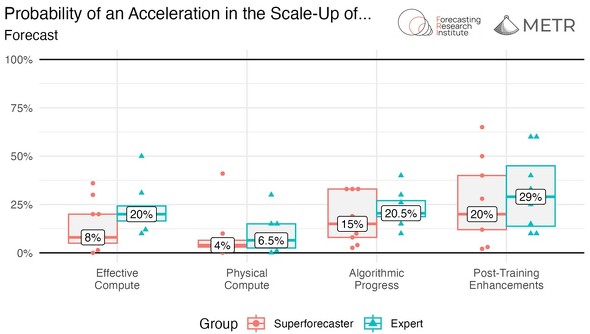

調査結果によると、2029年までにAIの進歩率が3倍以上に加速する可能性について、専門家の予測中央値は20%、精鋭予測者は8%だった。MITRは「両グループの予測はばらつきがあるものの、この加速が実現する可能性は低いという点で意見が一致している」と分析している。一方、AIの進歩を3倍以上に加速させる可能性が高い要因として両グループは「ポストトレーニングの改良」を挙げた。

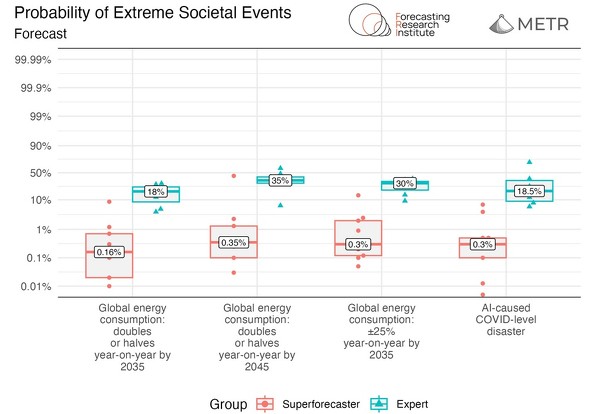

社会に極端な事象をもたらす可能性については、専門家と精鋭予測者の間で意見が分かれていた。精鋭予測者は調査で取り上げた4つの極端な事象について予測中央値が0.5%未満となったのに対し、専門家の場合、全ての事象について予測中央値が18%を超えた。AIが引き起こすCOVID-19(新型コロナウイルス感染症)級の世界的危機の発生可能性について、専門家の予測中央値は18.5%だったのに対し、精鋭予測者は0.3%だった。

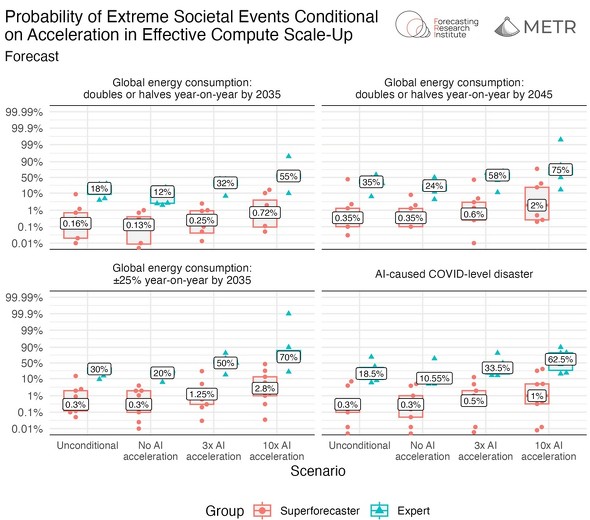

METRによると、AIの進歩率を3倍あるいは10倍と仮定した場合でも、両者の予測のギャップが埋まることはなかったという。ただし、両者はともに、AIの進歩率を高く仮定した場合、社会に極端な影響をもたらす可能性の予測が高まる傾向にあった。

METRは「専門家と精鋭予測者の双方が、AIが進歩する可能性がある点はおおむね合意している。一方で、この進展が前例のない社会的なリスクや影響をもたらす可能性については、強い意見の相違が見られた」とした上で、「検討対象とした『極端な影響』のシナリオには前例のないものも含まれており、もし現実のものになるとすれば、社会全体での入念な準備が必要となる可能性もある。より長期にわたってAI研究開発の評価手法を構築し、AIによるR&Dの自律化がもたらす影響をより精緻にモデル化したり、このパイロット調査をより大規模なものに拡大させたりすることが極めて重要だ」と結論付けている。

ETRとFRIによるパイロット調査は、あくまで仮定のシナリオに基づいている。とはいえ、AIが単なるツールではなく企業のビジネスを支える新たな軸となりつつある今、AIの進化を楽観視し、安易に導入を進めれば、予期せぬトラブルやリスクにさらされかねない。自社のビジネスにとってAIはどのような影響をもたらすのか、あらためてリスクを分析、評価した上で、AIガバナンスなど対策に乗り出す必要があるだろう。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

人工超知能(ASI:Artificial Superintelligence)とは? AGIとの違い

人工超知能(ASI:Artificial Superintelligence)とは? AGIとの違い

用語「ASI(人工超知能)」について解説。AGI(汎用人工知能)が人間と同等の知能を持つのに対し、ASIはそれを超えて、人間をはるかに超える知能を持ち、あらゆる分野で最も優れた能力を発揮するAIのことを指す。また、ASIは自律的に自己改善を行う特徴を持つとされている。 ジェボンズのパラドックス(Jevons Paradox)とは?

ジェボンズのパラドックス(Jevons Paradox)とは?

「効率化によって、かえって消費が増えてしまう」という逆説的な現象のこと。もともとは、産業革命期に見られた蒸気機関の効率化と、それに伴う石炭消費の増加をめぐって提起されたが、現代でも電力やAIの計算資源を語る際に引き合いに出されることがある。 コーディングAIをもっと使いやすく、新標準「AGENTS.md」公開:いわばコーディングエージェント用の「README」

コーディングAIをもっと使いやすく、新標準「AGENTS.md」公開:いわばコーディングエージェント用の「README」

コーディングエージェント用の新標準ファイル「AGENTS.md」の公式サイトが公開された。人間用の説明書「README.md」に相当するAI向けの指示書で、既に複数の開発ツールが対応を進めている。