Google、Android用AR SDK「ARCore 1.0」の正式版と、AIベース画像情報付加技術「Google Lens」のアップデートを発表:ARアプリ開発基盤と画像情報付加サービスが進化

Googleは、同社が進めるスマートフォンカメラのスマート化を支える「ARCore 1.0」の正式版と、「Google Lens」のアップデートを「Mobile World Congress」で発表する。

Googleは2018年2月23日(米国時間)、同社のAndroid用拡張現実(AR)SDKの正式版「ARCore 1.0」と、人工知能(AI)やコンピュータビジョンをベースに、スマートフォンのカメラに写った映像を解析し、文脈に基づいて適切な情報を表示する「Google Lens」のアップデートを、スペインのバルセロナで2月26日(現地時間)に開幕する「Mobile World Congress」で発表することを明らかにした。

GoogleはARCoreとGoogle Lensにより、スマートフォンカメラのさらなるスマート化を進めている。ARCoreでは、カメラに映る環境を理解し、そこにオブジェクトや情報を配置できるアプリケーションを作成できる。Google Lensは、カメラに映った名刺から連絡先情報を自動的に抽出、表示するといったことが可能で、近いうちに、公園で見かけた犬の品種の識別なども可能になるという。

ARCore 1.0のリリースに伴い、開発者はARアプリをGoogle Playストアで公開できるようになる。ARCoreは1億台のAndroidスマートフォンで動作し、これら全てのデバイスで高度なAR機能を利用できるという。動作するモデルは下記の13種類だ。

- Pixel(Google)

- Pixel XL(Google)

- Pixel 2(Google)

- Pixel 2 XL(Google)

- Galaxy S8(Samsung Electronics)

- Galaxy S8+(Samsung Electronics)

- Galaxy Note8(Samsung Electronics)

- Galaxy S7(Samsung Electronics)

- Galaxy S7 edge(Samsung Electronics)

- V30(LG Electronics)

- V30+(LG Electronics、Android Oのみ)

- Zenfone AR(ASUS)

- OnePlus 5(OnePlus)

ARCoreは現在販売中のこれらだけでなく、Googleとパートナーを組む多くのメーカー、例えばSamsung Electronics、Huawei、LG Electronics、Motorola、ASUS、Xiaomi、HMD Global/Nokia、ZTE、ソニーモバイル、Vivoなどが2018年に投入するデバイスでも動作する。

さらに、ARCore 1.0では環境に対する理解が向上しており、ユーザーはテクスチャを持つ表面(ポスター、家具、おもちゃ箱、本、缶など)に仮想資産を配置できる。Android用公式IDE「Android Studio」のβ版のエミュレーターがARCoreをサポートしており、デスクトップから仮想環境のアプリをすぐにテストできる。

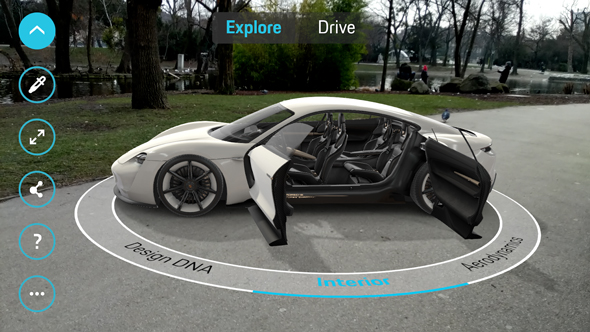

Googleと提携しているSnapchat、Sotheby's、Porsche、JD.com、NetEaseといった企業は、サンプルアプリを構築、披露している。

一方、Google Lensは、プレビュー版が広く提供される。数週間後に、AndroidデバイスまたはiOSデバイスで最新の「Googleフォト(英語版)」を使っているユーザーは、Google Lensプレビュー版を利用できるという。

同じく数週間後に、互換性のあるフラグシップデバイス(英語版)を使用するユーザーは、GoogleアシスタントでカメラベースのLens体験を享受できる。Googleは、時間をかけてより多くのデバイスをサポートしていくとしている。

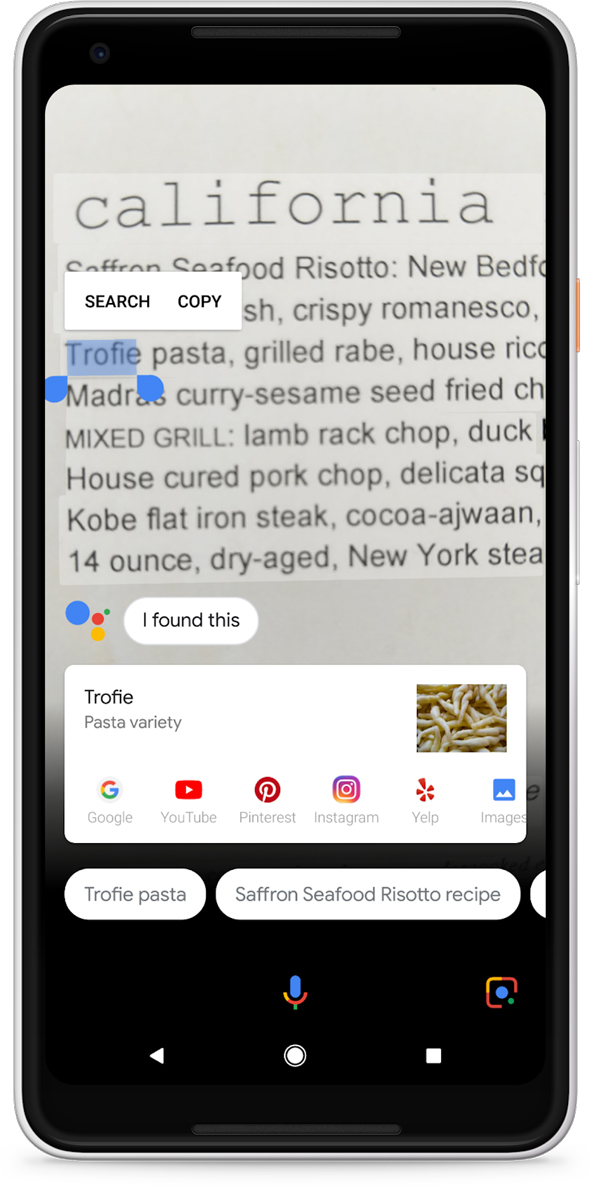

また、Google Lensはまだプレビュー版だが、改良が重ねられている。テキスト選択機能や、シングルタップで写真から連絡先やイベント情報を生成する機能が追加された他、数週間以内に、一般的な動植物の種類を識別する機能が強化されることになっている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

グーグルの機械学習/AIへの取り組みを支える「AIファーストデータセンター」とは

グーグルの機械学習/AIへの取り組みを支える「AIファーストデータセンター」とは

米グーグルが開発者向けイベント「Google I/O 17」で、同社のコンシューマー向けサービスにAI/機械学習を広範に適用、これによってサービスプロダクトを相互に結び付け、システマチックに進化させていることをアピールした。その裏にはもちろん、TensorFlowとGoogle Cloud Platformがある。同社は機械学習処理を高速化する「Cloud TPU」、Androidデバイス上のAI処理のための「TensorFlow Lite」について、併せて紹介した。 AIの民主化で前進、データのアップロードのみでカスタム機械学習モデルが自動的に構築される「Cloud AutoML」をGoogle Cloudが発表

AIの民主化で前進、データのアップロードのみでカスタム機械学習モデルが自動的に構築される「Cloud AutoML」をGoogle Cloudが発表

Google Cloudは2018年1月17日、容易に短時間で、ユーザーがカスタム機械学習モデルを構築できるサービス、「Cloud AutoML」を発表した。第1弾として、画像認識を行う「Cloud AutoML Vision」のアルファ提供を開始した。 Cloud AutoML Visionは、どう使えるサービスなのか

Cloud AutoML Visionは、どう使えるサービスなのか

Google Cloudが2018年1月下旬に発表した「Cloud AutoML Vision」は、機械学習の専門知識がなくとも画像認識を使ったカスタムの機械学習ができるサービスだ。どのように使えるものなのかを、具体的に紹介する。