Meta、6種類のデータを処理できるマルチモーダルAI「ImageBind」をオープンソースで公開:画像、音声、テキスト、深度、熱、慣性に対応

Metaは、明示的な監視を必要とせずに、6つのモダリティ(データ種別)のデータを一度に結合できる初のAIモデル「ImageBind」を開発し、オープンソースとして公開した。

Metaは2023年5月9日(米国時間)、明示的な監視(生のデータを整理してラベル付けするプロセス)を必要とせずに、6つのモダリティ(データ種別)のデータを一度に結合できる初のAI(人工知能)モデル「ImageBind」を開発し、オープンソースとして公開したと発表した。

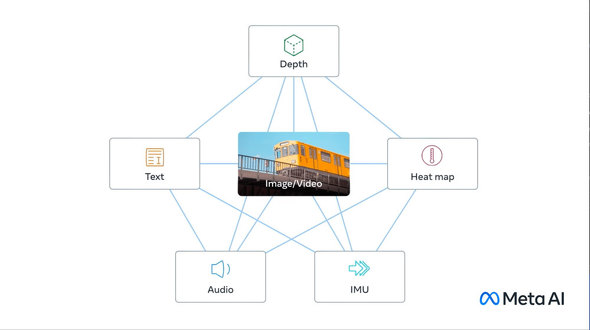

ImageBindは、画像/ビデオ、音声、テキスト、深度(3D)、熱(赤外線)、慣性測定単位(IMU:動きや位置を計算する)といったモダリティについて、単一の埋め込み(共有表現空間)を学習することで、これらのモダリティ間の関係を認識できる。

Metaは、人間のように、異なる種類のデータを総合的に分析できる機械を開発するための重要な一歩だと述べている。写真の中の物体が、「どのような音を出すか」「どのような3D形状か」「温かいか、冷たいか」「どのように動くか」を一度に全体的に理解できる機械を開発できる可能性がある。

Metaによると、同社の画像生成AIシステム「Make-A-Scene」にImageBindを組み込むことで、熱帯雨林や、にぎやかな市場の音から画像を生成することもできる可能性がある。

また、コンテンツの認識、接続、モデレーションをより正確に行い、クリエイティブデザインをより高度に支援できるようになる可能性もある。Metaはその例として、リッチなメディアのシームレスな生成や、幅広いマルチモーダルな検索機能の実現を挙げている(マルチモーダルは、テキスト、数値、音声、画像など、複数のモダリティを組み合わせたり、関連付けたりして処理できることを指す)。

Metaは、周囲のあらゆるデータから学習するマルチモーダルAIシステムの開発に取り組んでおり、ImageBindの開発はその一環だ。ImageBindは、使用されるモダリティが増える中で、各種モダリティを組み合わせたシステムの開発を容易にする。こうしたシステムの一例として、3DとIMUセンサーを組み合わせ、没入型の仮想世界を提供するものが挙げられる。

さらにImageBindは、写真、ビデオ、オーディオファイル、テキストメッセージを、テキスト、オーディオ、画像の組み合わせで検索するなど、記憶を探索する豊富な方法を提供できる可能性もある。

一般的なAIシステムでは、個々のモダリティに対して特定の埋め込み(機械学習において、データとその関係を表すことができる数値のベクトルを指す)が存在する。ImageBindは、モダリティの組み合わせごとに別のデータでトレーニングする必要がなく、複数のモダリティにまたがる共通の埋め込み空間を作ることが可能なことを示していると、Metaは説明している。

Metaは、これは重要なことだと発表の中で強調している。例えば、交通量の多い街路の音声データと熱データ、あるいは海辺の崖の深度データとテキスト記述を含むサンプルでデータセットを作ることは、研究者にとって現実的ではないためだ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

マルチモーダルAI(Multimodal AI)とは?

マルチモーダルAI(Multimodal AI)とは?

用語「マルチモーダルAI」について説明。テキスト/画像/音声/数値など複数の種類のモダリティー(データ種別)を一度に処理できる統合されたAIモデルを指す。 Meta、画像や動画内のあらゆるオブジェクトを識別できるAIモデルを発表

Meta、画像や動画内のあらゆるオブジェクトを識別できるAIモデルを発表

Metaは画像や動画内のあらゆる物体を識別できる「Segment Anything Model」(SAM)とデータセットの「Segment Anything 1-Billion mask dataset(SA-1B)」を公開した。 大規模なインフラを自由に使えないAI研究者向けに、Metaが「小規模で高性能な言語モデル」を公開

大規模なインフラを自由に使えないAI研究者向けに、Metaが「小規模で高性能な言語モデル」を公開

Metaは、同社開発した言語モデル「LLaMA」(Large Language Model Meta AI)を研究者向けに公開した。「人間の文章生成に似た方法で文章を生成できる」という。