壒惡仺僥僉僗僩曄姺偺Speech Recognition API偺巊偄曽偲丄2017擭4寧偵偍偗傞Watson丄Google Cloud Speech API偲偺堘偄丗擣幆宯API妶梡擖栧乮4乯乮2/3 儁乕僕乯

夋柺偺嶌惉

丂MainWindow.xaml偺僜乕僗偵偮偄偰偼埲壓偺傛偆偵側偭偰偄傑偡乮仸夋柺晹暘偺僜乕僗僐乕僪偺夝愢偼杮楢嵹偺庯巪偐傜奜傟傞偺偱妱垽偟傑偡乯丅

<Window x:Class="SpeechRecognitionAPI.MainWindow"

xmlns="http://schemas.microsoft.com/winfx/2006/xaml/presentation"

xmlns:x="http://schemas.microsoft.com/winfx/2006/xaml"

xmlns:d="http://schemas.microsoft.com/expression/blend/2008"

xmlns:mc="http://schemas.openxmlformats.org/markup-compatibility/2006"

xmlns:local="clr-namespace:SpeechRecognitionAPI"

mc:Ignorable="d"

Title="Speech Recognition API" Height="350" Width="525">

<Grid>

<StackPanel VerticalAlignment="Center" HorizontalAlignment="Center">

<Button Name="btnRec" Width="200" Height="50" Click="btnRec_Click">

<StackPanel Orientation="Horizontal">

<Label Name="lblBtnRec" Width="35" Height="30" Content="REC" Background="Red" Foreground="White" Visibility="Collapsed"/>

<TextBlock Name="tblkBtnRec" Margin="20,0,0,0" VerticalAlignment="Center"/>

</StackPanel>

</Button>

<ComboBox Name="cmbLocale" Width="200" Margin="0,20,0,0">

<ComboBoxItem Content="ja-JP" IsSelected="True" />

<ComboBoxItem Content="en-US" />

</ComboBox>

<TextBox Name="tboxResult" Width="450" Height="150" TextWrapping="Wrap" Margin="0,20,0,0" />

</StackPanel>

</Grid>

</Window>

張棟偺嶌惉

丂MainWindow.xaml.cs偱幚嵺偵僾儘僌儔儉偐傜屇傃弌偡偲偙傠傪嶌惉偟傑偡丅僾儘僌儔儉偺棳傟偲偟偰偼旕忢偵僔儞僾儖偱丄埲壓偺傛偆偵側傝傑偡丅

- 傾僋僙僗僉乕傪巊梡偟偰Token傪庢摼偡傞

- 壒惡傪榐壒偟丄壒惡僼傽僀儖傪嶌惉偡傞

- Token傪巊梡偟偰丄Speech Recognition API偵壒惡僼傽僀儖傪搉偟丄僥僉僗僩乮JSON宍幃乯傪庢摼偡傞

丂Text To Speech API偲摨條丄僒乕價僗偑懳墳偟偰偄傞尵岅偺堦棗傪庢摼偡傞API偑側偄傛偆側偺偱丄崱夞偼僾儘僌儔儉撪偵儕僗僩傪帩偮偙偲偵偟傑偡乮僾儘僌儔儉傪娙曋偵偡傞偨傔偵丄崱夞偼塸岅偲擔杮岅偺傒偲偟傑偡乯丅

丂傑偢丄崱夞偼Speech Recognition API偐傜曉偭偰偔傞僨乕僞偑JSON宍幃側偺偱丄偙偺JSON宍幃偱曉偭偰偔傞僨乕僞傪庴偗庢傞偨傔偺僋儔僗傪嶌惉偟傑偡丅

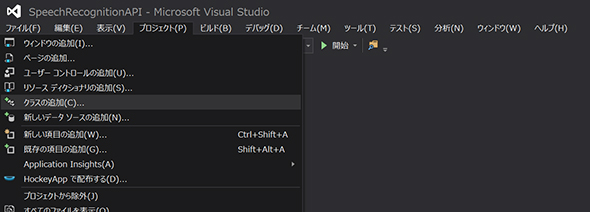

丂儊僯儏乕僶乕偺乽僾儘僕僃僋僩乿偐傜乽僋儔僗偺捛壛乿傪僋儕僢僋偟傑偡丅

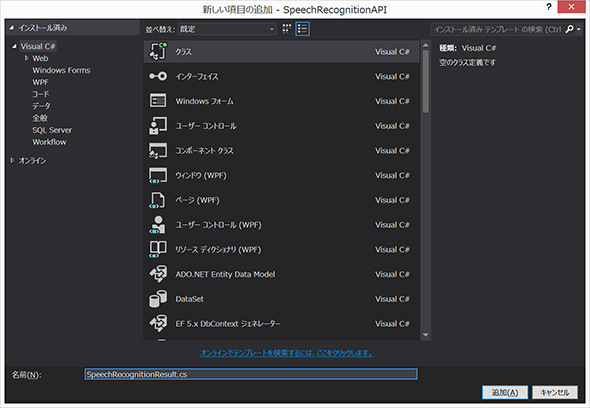

丂捛壛偡傞偺偼捠忢偺僋儔僗偱偡丅柤慜傪乽SpeechRecognitionResult.cs乿偲偟偰乽捛壛乿儃僞儞傪僋儕僢僋偟傑偡丅

丂僋儔僗偑捛壛偝傟偨傜丄埲壓偺撪梕傪僐僺乕偟偰偦偺僋儔僗偵儁乕僗僩偟偰偔偩偝偄丅

using System;

using System.Collections.Generic;

using System.Linq;

using System.Text;

using System.Threading.Tasks;

// 捛壛

using System.Runtime.Serialization;

namespace SpeechRecognitionAPI

{

[DataContract]

class SpeechRecognitionResult

{

[DataMember]

public string version { get; set; }

[DataMember]

public Header header { get; set; }

[DataMember]

public Result[] results { get; set; }

[DataContract]

public class Header

{

[DataMember]

public string status { get; set; }

[DataMember]

public string scenario { get; set; }

[DataMember]

public string name { get; set; }

[DataMember]

public string lexical { get; set; }

[DataMember]

public Properties properties { get; set; }

}

[DataContract]

public class Properties

{

[DataMember]

public string requestid { get; set; }

[DataMember]

public string HIGHCONF { get; set; }

}

[DataContract]

public class Result

{

[DataMember]

public string scenario { get; set; }

[DataMember]

public string name { get; set; }

[DataMember]

public string lexical { get; set; }

[DataMember]

public string confidence { get; set; }

[DataMember]

public Properties2 properties { get; set; }

}

[DataContract]

public class Properties2

{

[DataMember]

public string HIGHCONF { get; set; }

}

}

}

丂懕偄偰傾僋僙僗僉乕傪巊梡偟偰Token傪庢摼偡傞張棟偱偡偑丄Token偺庢摼偵偮偄偰偼丄Translator API丄Text To Speech API偺偲偒偲傑偭偨偔摨偠偱偡丅Token偼10暘娫桳岠側偺偱丄慜夞庢摼帪偐傜10埲忋宱夁偟偰偄偨傜嵞庢摼偡傞傛偆丄庢摼偟偨帪娫傪曄悢偵庢偭偰偍偒傑偡丅

// ----------------------------------------------

// Token傪庢摼偡傞張棟

// ----------------------------------------------

string GetAccessToken()

{

try

{

//庢摼偟偨Bing Speech API 偺 Key

string subscriptionKey = "xxxxxxxxxxxxxxxxxxxxxxxx";

WebRequest request = WebRequest.Create("https://api.cognitive.microsoft.com/sts/v1.0/issueToken");

//儕僋僄僗僩愝掕

request.Method = "POST"; // 儊僜僢僪偼POST

request.Headers.Add("Ocp-Apim-Subscription-Key", subscriptionKey);

request.ContentLength = 0;

// 儕僋僄僗僩傪搳偘傞

WebResponse response = request.GetResponse();

Stream responseStream = response.GetResponseStream();

//丂儗僗億儞僗傪庴偗庢傞

StreamReader streamReader = new StreamReader(responseStream);

//丂Token傪庢摼偟偨帪娫傪庢摼

tokenRefreshedTime = DateTime.Now;

// 儗僗億儞僗乮Token乯傪曉偡

return streamReader.ReadToEnd();

}

catch (WebException webException)

{

Stream responseStream = webException.Response.GetResponseStream();

StreamReader streamReader = new StreamReader(responseStream);

tblkMessage.Text = streamReader.ReadToEnd();

return null;

}

catch (Exception exception)

{

tblkMessage.Text = exception.Message;

return null;

}

}

丂懕偄偰丄壒惡僼傽僀儖傪搉偟偰僥僉僗僩傪庢摼偡傞張棟偱偡丅API偺儕僋僄僗僩儊僜僢僪偼POST偵側傝傑偡丅Speech Recognition API偱偼丄儕僋僄僗僩偺昁恵僷儔儊乕僞乕偲偟偰埲壓偺抣傪娷傔傞傛偆偵婰嵹偝傟偰偄傑偡丅

| Name | Format | 摿婰帠崁丄椺丄巊偄曽 |

|---|---|---|

| Version | Digits and "." | 悇彠偑3.0側偺偱丄乽version=3.0乿偲婰嵹偡傟偽OK |

| requestid | GUID | 儕僋僄僗僩偛偲偵僌儘乕僶儖偱儐僯乕僋側ID傪怳傟丄偲偺偙偲側偺偱丄僾儘僌儔儉撪偱儕僋僄僗僩偺偨傃偵ID傪庢摼偡傞丅椺偲偟偰偼乽requestid=b2c95ede-97eb-4c88-81e4-80f32d6aee54乿偲偄偆宍幃偵側偭偰偄傞 |

| appID | GUID | 屌掕抣偲偺偙偲丅乽appID = D4D52672-91D7-4C74-8AD8-42B1D98141A5乿偲婰嵹偡傟偽OK |

| format | UTF-8 | 悇彠宍幃偼JSON乮偦傟埲奜偵偳偺傛偆側宍幃傪僒億乕僩偟偰偄傞偺偐偺婰弎偑側偄乯丅乽format=json乿偲婰嵹偡傟偽OK |

| locale | UTF-8乮IETF Language Tag乯 | 乽Bing Speech Recognition API乿偺儁乕僕偺乽Supported Locales乿偵偁傞抣乮ja-JP丄en-US側偳乯傪巜掕偡傟偽OK |

| device.os | UTF-8 | 偙偺儕僋僄僗僩傪搳偘傞傾僾儕働乕僔儑儞偑嵹偭偰偄傞OS傪巜掕偡傞僷儔儊乕僞乕丅偙偆偱側偗傟偽側傜側偄偲偄偆偺偼側偄偑丄乽Windows OS乿乽Windows Phone OS乿乽XBOX乿乽Android乿乽iPhone OS乿偲偄偭偨宍偱巜掕偡傟偽OK |

| scenarios | UTF-8 | 壒惡擣幆傪幚峴偡傞偨傔偺暥柆丄攚宨丄応柺偺僷儔儊乕僞乕丅僒億乕僩偡傞抣偼乽ulm乿偐乽websearch乿丅偄傠偄傠挷傋偰偼傒偨偑丄偙偺僷儔儊乕僞乕傪偦傟偧傟曄偊傞偙偲偵傛傞塭嬁偼晄柧 |

| instanceid | GUID | 僨僶僀僗偛偲偵僌儘乕僶儖偱儐僯乕僋側ID傪怳傟丄偲偺偙偲側偺偱丄壗偐揔摉側抣傪屌掕抣偱帩偭偰傕偄偄偟丄搒搙怴偟偄ID傪庢摼偟偰傕栤戣側偄傛偆偩丅椺偲偟偰偼乽instanceid=b2c95ede-97eb-4c88-81e4-80f32d6aee54乿偲偄偆宍幃偵側偭偰偄傞 |

// ----------------------------------------------

// 壒惡僨乕僞偺僥僉僗僩曄姺寢壥傪庢摼偡傞張棟

// ----------------------------------------------

string GetSpeechRecognitionResult(string pAccessToken, string pLocale, string pWavFile)

{

try

{

string url = " https://speech.platform.bing.com/recognize";

url += "?version=3.0";

url += "&requestid=" + Guid.NewGuid().ToString();

url += "&appid=D4D52672-91D7-4C74-8AD8-42B1D98141A5";

url += "&format=json";

url += "&locale=" + pLocale;

url += "&device.os=Windows OS";

url += "&scenarios=ulm";

url += "&instanceid=" + Guid.NewGuid().ToString();

// 儕僋僄僗僩嶌惉

HttpWebRequest request = WebRequest.CreateHttp(url);

request.Method = "POST";

request.ContentType = "audio/wav; samplerate=16000";

request.Headers.Add("Authorization", "Bearer " + pAccessToken);

// 壒惡僼傽僀儖偺撉傒崬傒

FileStream fs = new FileStream(pWavFile, FileMode.Open, FileAccess.Read);

byte[] bs = new byte[fs.Length];

fs.Read(bs, 0, bs.Length);

fs.Close();

Stream writer = request.GetRequestStream();

writer.Write(bs, 0, bs.Length);

WebResponse webResponse = request.GetResponse();

Stream responseStream = webResponse.GetResponseStream();

DataContractJsonSerializer dcjs = new DataContractJsonSerializer(typeof(SpeechRecognitionResult));

SpeechRecognitionResult result = (SpeechRecognitionResult)dcjs.ReadObject(responseStream);

if(result.header.status == "error")

{

return result.header.status;

}

return result.results[0].lexical;

}

catch (WebException webException)

{

Stream responseStream = webException.Response.GetResponseStream();

StreamReader streamReader = new StreamReader(responseStream);

return streamReader.ReadToEnd();

}

catch (Exception exception)

{

return exception.Message;

}

}

丂僐儞僗僩儔僋僞傗儃僞儞僋儕僢僋帪偺僀儀儞僩傪娷傔傞偲丄嵟廔揑偵偼乽MainWindow.xaml.cs乿偼丄偙偪傜偺傛偆偵側傝傑偡乮仸僋儕僢僋偟偰僟僂儞儘乕僪偱偒傑偡乯丅

丂億僀儞僩偲偟偰偼丄榐壒偵偼mciSendString傪巊梡偟偰偄傑偡丅傑偨丄埲慜偼壒惡僼傽僀儖偺僒儞僾儕儞僌儗乕僩偑16khz偲偄偆惂尷偑偁偭偨婰壇偑偁傝傑偡偑丄2017擭4寧尰嵼偺僪僉儏儊儞僩偵偼摿偵僒儞僾儕儞僌儗乕僩偵娭偡傞惂尷偼彂偐傟偰偄傑偣傫丅偟偐偟丄擮偺偨傔崱夞偺僾儘僌儔儉偱偼榐壒帪偵僒儞僾儕儞僌儗乕僩16khz偺壒惡僼傽僀儖傪嶌惉偟偰偄傑偡丅

丂傑偨丄曉偭偰偔傞JSON偺僨乕僞偺偆偪丄壒惡僨乕僞偺僥僉僗僩壔偺寢壥偑擖偭偰偄傞抣偼乽name乿乽lexical乿偱偡丅婎杮揑偵name傪巊偊偽偄偄偲巚偄傑偡丅

娭楢婰帠

儃僢僩偵Cognitive Services傪慻傒崬傫偱傒傞

儃僢僩偵Cognitive Services傪慻傒崬傫偱傒傞

儅僀僋儘僜僼僩偑採嫙偡傞Cognitive Services偑偳傫側傕偺偐傪丄Text Analytics API傪巊偄側偑傜尒偰傒傛偆丅 暷IBM偑價僢僌僨乕僞暘愅婎斦僒乕價僗傪奼廩丄僐僌僯僥傿僽僐儞僺儏乕僥傿儞僌偺尋媶惉壥傕搵嵹

暷IBM偑價僢僌僨乕僞暘愅婎斦僒乕價僗傪奼廩丄僐僌僯僥傿僽僐儞僺儏乕僥傿儞僌偺尋媶惉壥傕搵嵹

暷IBM偼丄僙儞僒忣曬側偳偺戝検僨乕僞傪婎偵恖娫偺傛偆偵堄巚寛掕偡傞僐僌僯僥傿僽僐儞僺儏乕僥傿儞僌偺尋媶惉壥傪丄幚惢昳傗僒乕價僗偵庢傝崬傫偱偄偔偲敪昞偟偨丅SoftLayer娐嫬傕憐掕偡傞丅 Google Cloud Vision API偺僷僽儕僢僋兝斉偑岞奐

Google Cloud Vision API偺僷僽儕僢僋兝斉偑岞奐

暷僌乕僌儖偼2016擭2寧18擔丄乽Google Cloud Vision API乿偺僷僽儕僢僋兝斉傪岞奐偟偨丅API僐乕儖偺傒偱夋憸偺摿挜揑側梫慺傗堦斒揑側儔儞僪儅乕僋側偳傪儔儀儖晅偗偟偨傝丄懡條側尵岅偺暥帤擣幆乮OCR乯婡擻傪棙梡偱偒傞丅

Copyright © ITmedia, Inc. All Rights Reserved.