リバースエンジニアリングでマルウェアを分類する自律型AIエージェント「Project Ire」 Microsoft発表:自律型AIが挑む「リバースエンジニアリングの自動化」

Microsoftは2025年8月5日、「Project Ire」を発表した。これはソフトウェアを分析し、マルウェアかどうかを判定する自律型AIエージェントのプロトタイプだ。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

Microsoftは2025年8月5日(米国時間)、自律型AI(人工知能)エージェントのプロトタイプ「Project Ire」を発表した。Project Ireの目的は「ソフトウェアの出どころや目的に関する手掛かりが全くない状態で、完全なリバースエンジニアリングを実現すること」だ。

一筋縄ではいかないマルウェア分類

マルウェアの分類は担当者に高い負荷がかかる作業だ。Microsoftのセキュリティツール「Microsoft Defender」は毎月10億台以上のデバイスをスキャンしている。だが、こうした作業は分類担当者がエラーやアラート疲れに直面しやすく、担当者間のレビュー方法を標準化することも難しいという課題がある。

また、セキュリティ分野における他のAIアプリケーションと異なり、マルウェア分類には計算によって正解を導ける検証装置が存在しない。リバースエンジニアリング対策など、善悪の判断が難しい挙動も多く、分類担当者は一つずつ証拠を積み重ねて結論を出す必要がある。

その結果、専門家の燃え尽き症候群が業界全体で問題になっているという。

Project Ireは、専門ツールを用いてソフトウェアをリバースエンジニアリングする自律型システムとして機能することで、これらの課題に対応しようとする試みだ。同社によると、低レベルのバイナリ解析から制御フローの再構築、高レベルなコード動作の解釈に至るまで、多層的な推論が可能になっている。

リバースエンジニアリング自動化のための技術的アプローチ

Project Ireは、リバースエンジニアリング専用のツールを使用する自律システムとして、これらの課題に対処する。そのプロセスは、大きく4つのフェーズに分かれている。

第1フェーズは「構造把握」だ。Project Ireは、解析対象のファイルの種類や構造を自動で特定する「トリアージ」処理を実施する。第2フェーズは「処理フローの構築」だ。「angr」や「Ghidra」といったフレームワークを用いてソフトウェアの処理フロー(制御フローグラフ)を構築し、その情報を分析の基盤とする。

第3フェーズは「関数の特定と要約」。LLM(大規模言語モデル)がAPI経由で専門ツールを呼び出して主要な関数を特定、要約する。分析結果は「証拠の連鎖」として時系列で記録され、判断に至るまでの過程を追跡、監査できるログの形で保存する。

第4フェーズは「正確性の確認」だ。第3フェーズで作成したログと報告書の主張を照合する「検証ツール」を呼び出し、情報の正確性を確認する。

テストでは「手動でなければ分類できないファイル」も解析

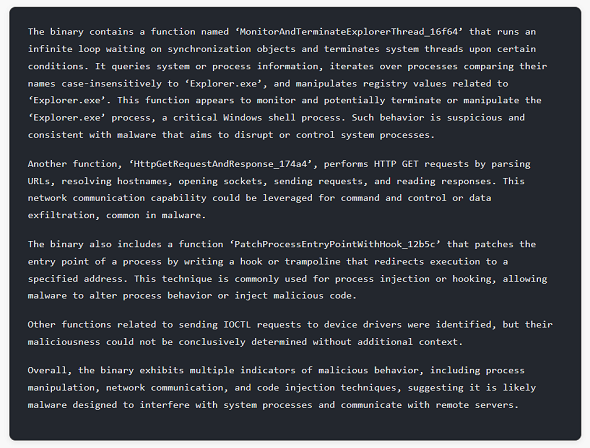

Project Ireの有効性を確かめるため、2つの評価テストが実施された。図1と2は、テスト中に生成された2つの成功したマルウェア分類のレポートを示している。

1つ目のテストでは、公開されているWindowsドライバのデータセット(悪意のあるものは「Living off the Land Drivers」データベース、良性のものは「Windows Update」から取得した)を使用した。

このテストでProject Ireは、全ファイルの90%を正しく識別し、良性ファイルのうち誤って脅威と判定した割合はわずか2%だった。例えば、カーネルレベルのルートキットを解析した際は、ジャンプフックやプロセス終了といった複数の悪意ある特徴を特定し、正しくマルウェアとして分類した。

図1. Project Ireレポート、SHA256のサンプル。「この関数は、重要なWindowsシェルプロセスである‘Explorer.exe’プロセスを監視し、終了または操作する可能性があるようです。このような動作は不審であり、システムプロセスを中断または制御することを目的としたマルウェアと一致します。」というメッセージが表示されている(提供:Microsoft)

図1. Project Ireレポート、SHA256のサンプル。「この関数は、重要なWindowsシェルプロセスである‘Explorer.exe’プロセスを監視し、終了または操作する可能性があるようです。このような動作は不審であり、システムプロセスを中断または制御することを目的としたマルウェアと一致します。」というメッセージが表示されている(提供:Microsoft)2つ目のテストでは、既存の自動化システムでは分類できず、リバースエンジニアリングの専門家による手動レビューが必要なファイル、いわゆる「ハードターゲット」のファイルを対象とした。

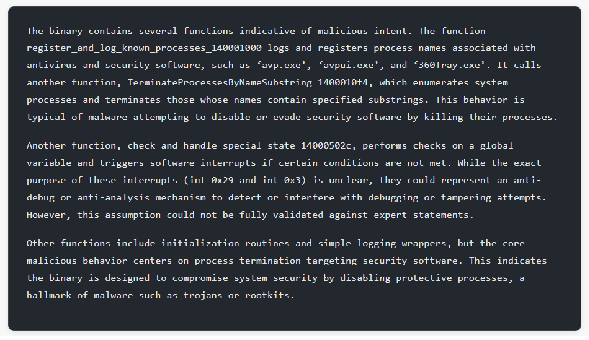

図2. Project Ireレポート、SHA256のサンプル。「このバイナリには悪意を示す幾つかの関数が含まれています。関数 register_and_log_known_processes_140001000 は、‘avp.exe’、‘avpui.exe’、‘360Tray.exe’ といったアンチウイルスやセキュリティソフトウェアに関連するプロセス名をログに記録し登録します。」というメッセージが表示されている(提供:Microsoft)

図2. Project Ireレポート、SHA256のサンプル。「このバイナリには悪意を示す幾つかの関数が含まれています。関数 register_and_log_known_processes_140001000 は、‘avp.exe’、‘avpui.exe’、‘360Tray.exe’ といったアンチウイルスやセキュリティソフトウェアに関連するプロセス名をログに記録し登録します。」というメッセージが表示されている(提供:Microsoft)Project Ireは現実世界のシナリオを想定したこのテストで自律的に動作し、悪意あると判定されたファイルのうち9割(適合率スコア:0.89)を正しく識別し、偽陽性率は4%にとどまった。

Microsoftは今後、システムの速度と精度をさらに向上させ、あらゆるソースからのファイルを初見で正しく分類できるようにすることを目標としている。最終的なビジョンは、新たなマルウェアを大規模に、メモリ内で直接検出することだという。

関連記事

「AIを管理するAI」が身近な存在に? 自律型AIエージェントが仕事や職場にもたらす影響をSalesforceが予測

「AIを管理するAI」が身近な存在に? 自律型AIエージェントが仕事や職場にもたらす影響をSalesforceが予測

セールスフォース・ジャパンは、「自律型AIエージェントが仕事や職場にもたらすSalesforce Futuresの4つの予測」を発表した。2025年は、マルチAIエージェントシステムが中心的な役割を果たすようになるという。 国内経営層、AIに「懸念よりも期待」が7割、急増する非人間アイデンティティー管理が課題

国内経営層、AIに「懸念よりも期待」が7割、急増する非人間アイデンティティー管理が課題

職場のAI利用はどこまで進んでいるのか。国内企業の経営層はAIをどう捉えているのか。 8割の企業が「“勝手に動く”AIエージェント」を経験、対策は? SailPoint調査

8割の企業が「“勝手に動く”AIエージェント」を経験、対策は? SailPoint調査

SailPointは2025年7月31日、AIエージェントに伴うセキュリティリスクの調査結果を発表した。それによると、AIエージェント導入企業の半数以上が十分なセキュリティ対策を講じていないことが分かった。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.