地理的に離れたデータセンターを統合 NVIDIAが新技術「Spectrum-XGS」を発表:AIモデルの巨大化に対処

NVIDIAは、地理的に分散したデータセンター群を接続し、単一の巨大なデータセンターとして機能させるための新技術「NVIDIA Spectrum-XGS Ethernet」を発表した。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

NVIDIAは2025年8月22日(米国時間)、地理的に分散したデータセンター群を統合し、単一の巨大なデータセンター「AI(人工知能)スーパーファクトリー」として機能させるための新しいネットワーク技術「NVIDIA Spectrum-XGS Ethernet」を発表した。

同社は「AIモデルの大規模化に伴い、単一のデータセンターが供給できる電力や収容能力が限界に達しつつある。この課題に対処するため、NVIDIA Spectrum-XGS Ethernetを開発した」としている。

大陸をまたぐデータセンターを1つに

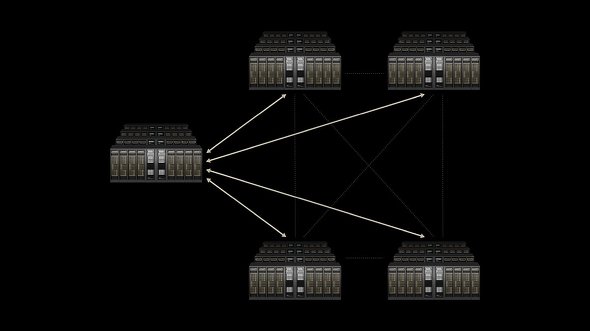

従来、データセンターの処理能力を向上させる手段は主に2つあった。1つ目は単一のサーバの処理性能を高める「スケールアップ」、2つ目は施設内でサーバの数を増やす「スケールアウト」だ。NVIDIAはこれらに次ぐ3つ目の手段として複数のデータセンターを相互接続する「スケールアクロス」というアプローチを提案する。

NVIDIA Spectrum-XGS Ethernetは、NVIDIAのネットワーク製品群「NVIDIA Spectrum-X」を拡張するものだ。NVIDIA Spectrum-Xにはネットワークスイッチや、サーバをネットワークにつなぐNIC(ネットワークインタフェースカード)「NVIDIA ConnectX-8 SuperNIC」などが含まれる。大規模AI基盤を構築、運用する企業を対象に設計されている。

中核となる技術は、データセンター間の物理的な距離に応じてネットワークを動的に最適化するアルゴリズムだ。これによって、通信の遅延(レイテンシ)やそのばらつき(ジッタ)といった長距離接続における課題を解決する。その他にも輻輳(ふくそう)制御機能や遅延管理機能を備えており、地理的に分散したGPUやサーバ間でのAI学習データを効率的にやりとりするためのライブラリ「NVIDIA Collective Communications Library」(NCCL)の処理速度を向上させるという。

NVIDIAの創業者兼CEOであるジェンスン・フアン氏は「NVIDIA Spectrum-XGS Ethernetによって、都市、国、大陸を越えて、複数のデータセンターを連携させ、1つの巨大なAIスーパーファクトリーを構築する」と述べている。

AIクラウドプロバイダーのCoreWeaveが導入を決めており、同社の共同創業者兼CTO(最高技術責任者)であるピーター・サランキ氏は、NVIDIA Spectrum-XGS Ethernetがもたらす効果について、「当社のデータセンターを単一のスーパーコンピュータとして提供できるようになる」と語っている。

このニュースのポイント

Q: 「NVIDIA Spectrum-XGS Ethernet」とは何ですか?

A: NVIDIAが発表した新しいネットワーク技術で、地理的に分散したデータセンター群を統合し、単一の巨大なデータセンターとして利用できるようする。

Q: 「Spectrum-XGS Ethernet」の特徴は何ですか?

A: Spectrum-XGS Ethernetの特徴は、以下の通りです。

- 距離に応じた動的最適化:データセンター間の物理的距離に応じてネットワークを動的に最適化するアルゴリズム

- 遅延やばらつき対策:通信の遅延やばらつきといった長距離接続の課題を解決

- 輻輳制御と遅延管理:ネットワーク全体の安定性を高めるために輻輳制御機能と遅延管理機能を実装

- NCCLの強化:AI学習データを効率的にやりとりするためのNVIDIA Collective Communications Library(NCCL)の処理速度を向上

関連記事

NVIDIA、AIエージェントに重要なリーズニングも高速化する「Blackwell Ultra」を発表 その特徴と性能は?

NVIDIA、AIエージェントに重要なリーズニングも高速化する「Blackwell Ultra」を発表 その特徴と性能は?

NVIDIAは、約1年前に発表したAIファクトリープラットフォーム「NVIDIA Blackwell」の後継となる「NVIDIA Blackwell Ultra」を発表した。 データセンターネットワークをAIワークロードに最適化するには

データセンターネットワークをAIワークロードに最適化するには

AI導入を進める企業にとって、GPUやAIサーバを支えるネットワークの最適化は不可欠だ。CIOの期待に応えるには、AIワークロードに対応したインフラ戦略と相互接続技術の選定が重要となる。 データセンター向けAIプロセッサ市場規模、2029年には1510億ドルへ Omdia予測

データセンター向けAIプロセッサ市場規模、2029年には1510億ドルへ Omdia予測

Omdiaはクラウドおよびデータセンター向けAIプロセッサ市場についての調査結果を発表した。2022年には100億ドル弱の市場規模だったが、2024年は780億ドルへ成長した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

本記事は制作段階でChatGPT等の生成系AIサービスを利用していますが、文責は編集部に帰属します。

リリース

リリース