Oculus Rift、Unity、Openframeworks...感覚器官フル稼働の仮想空間を実現する:UXレポート IVRC 2013(2/3 ページ)

「前庭感覚」「風」を表現する仕掛け

Oculus Rift内の映像は全周の3D映像をUnityで製作している。

この作品では、視野全体を覆う映像に加えて「前庭感覚」という、自分の体が前に傾くことで進んでいく感覚や、終わった際のガクっと揺れる感覚を視覚的に再現したことで、よりリアルな「スライダー感覚」を再現するコンテンツの作り込みを行っている。ロープを操るウィンチはArduino経由で制御している。ここで、開始時や終了時の滑りだした感じ、動いている最中の揺れ、終わった時の「ガックン」感を再現している。体験中に感じる風については、体験者に向けられたサーキュレーターをPCから制御して出している。

実際の「俺の部屋」をスキャンして再現した「俺の部屋」

ほとんどのステージはモデリングして作られたものだが、ステージ「俺の部屋」だけは違う。

一人暮らしの部屋をロープで滑っていくこのステージの設定は、KinectとArtic studio(リンク)という点群データが取れるツール(3次元スキャナ)を使ってチームリーダー自身の部屋をスキャンし、ポリゴンデータに復元して部屋を再現したものだ。

動きまで含めたCGの作り込み、ウィンチや風を含めた体感のクオリティの高さなど、全体が評価されての優勝だったが、それぞれは別々に開発されたため、完成時のテストで全体のタイミングを合わせるのは苦労の連続だったとのこと。

ヘッドトラッキング機能がもたらした没入感の向上

もともと、6月末のプレゼン審査の段階では、ヘッドトラッキングを備えていないソニー製ヘッドマウントディスプレイとモーター類だけで実現しようとしていたという。それが、Oculus Riftの採用を決めたことで、高い没入感を表現できるようになり、9月18日から行われた予選でも決勝戦でも第1位となった。

IVRCは、ツールの進化と共に語られる。このバーチャルロープスライダーでも、審査員の岩田洋生教授(筑波大学)から「テーマとして、ターザンのロープ遊びは目新しいものではないが、最新のツールを使ったことで体験のクオリティが上がった」というコメントがあった。

水と映像、多角視点に配慮した作品「花水」の表現

明和電機賞に輝いた筑波大学の「花水」(はなすい)もUnityで開発したものだ。手に「ミスト発生デバイス」を持ち、2メートル四方の暗室に入る。暗室には足元にプロジェクターが置かれていて、手持ちのデバイスから発生したミストに、Unityで作成された3Dの映像を映し出す。まるで手持ち花火のような効果をミストで味わえる作品だ。

デバイスにはマイコンボード「mbed」が仕込んであり、Wi-Fiで制御する。デバイス先頭に超音波振動子があり、そこでミストを発生させる。発生したミストをファンで前に押し出す。

ミストの映像を投影するための工夫

ミストに映像を投影する際には、通常のスクリーンとは違い、広い角度に光が拡散しないため、プロジェクターが鑑賞者の方を向いていないとほとんど見えなくなるという。そのため、デバイスの位置に応じてユーザーとは反対側のプロジェクターから映像を出力する必要がある。

ここでは、体験場所の下にカメラを用意し、AR Toolkitを使ってミスト発生デバイスの場所をトラッキングする対策を施していた。ミスト発生デバイスの場所/角度を判断して、映像を投影する仕組みだ。

映像はUnityで制御する3台のPCが、それぞれのプロジェクターをつなげて三次元空間上に投影している。花火はバーチャル空間上で生成されており、プロジェクターそれぞれから投影すべき映像を描画しているため、見ている人の角度によってきちんと違う角度の映像が見えるというハイテクぶりである。

その一方で、プロジェクターの位置合わせ、キャリブレーションは人力で行っているという、力技も合わせた努力の結晶で「花水」は開発された。

Copyright © ITmedia, Inc. All Rights Reserved.

Arduinoで制御されるウィンチ

Arduinoで制御されるウィンチ 花水の体験ブース。足元に置かれたプロジェクターから映像が投影される

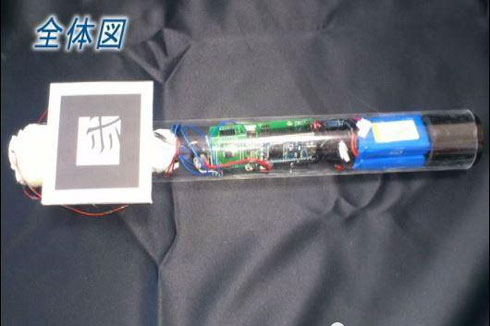

花水の体験ブース。足元に置かれたプロジェクターから映像が投影される デバイスの全体図(提供:花水職人)

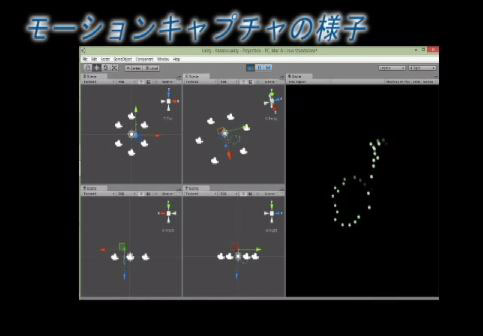

デバイスの全体図(提供:花水職人) ミスト発生デバイスの位置を取得して3D空間上に反映させている様子(提供:花水職人)

ミスト発生デバイスの位置を取得して3D空間上に反映させている様子(提供:花水職人)