Stability AI、「Stable Diffusion 3」の先行プレビュー版を発表:基盤技術を解説する研究論文も公開

Stability AIは、同社の画像生成モデル「Stable Diffusion」の最新版となる「Stable Diffusion 3」を発表した。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

Stability AIは2024年2月22日(米国時間、以下同)、画像生成AI(人工知能)モデル「Stable Diffusion」の最新モデルである「Stable Diffusion 3」の先行プレビュー版を発表した。3月5日には、Stable Diffusion 3の基盤技術を解説する研究論文も公開した。

Stable Diffusion 3では、画像と言語の表現力を向上させる新たなアーキテクチャを採用し、以前のバージョンと比較してテキストの理解力やスペルの表現能力を向上させていると、Stability AIは述べている。

Stable Diffusion 3の特徴は次の通り。

Stable Diffusion 3の特徴

パフォーマンスの強化

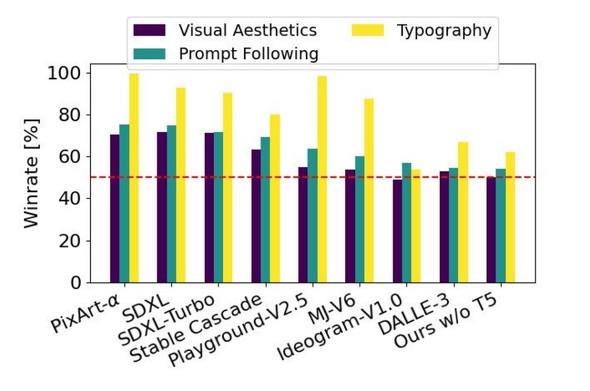

Stability AIは、人間によるフィードバック評価に基づき、「SDXL」「SDXL Turbo」「Stable Cascade」「Playground v2.5」「Pixart-α」などのオープンモデルや、「DALL-E 3」「Midjourney v6」「Ideogram v1」などのクローズドソースシステムと比較して、与えられたプロンプトの文脈にどれだけ近いか(「プロンプトの順守」)、プロンプトに基づいてテキストがどれだけレンダリングされているか(「タイポグラフィ」)、画像の美しさ(「視覚的美学」)を比較した。

その結果、Stable Diffusion 3は上記の全ての領域で、他の画像生成AIと同等もしくはそれを上回っていたという。

新たなアーキテクチャの採用

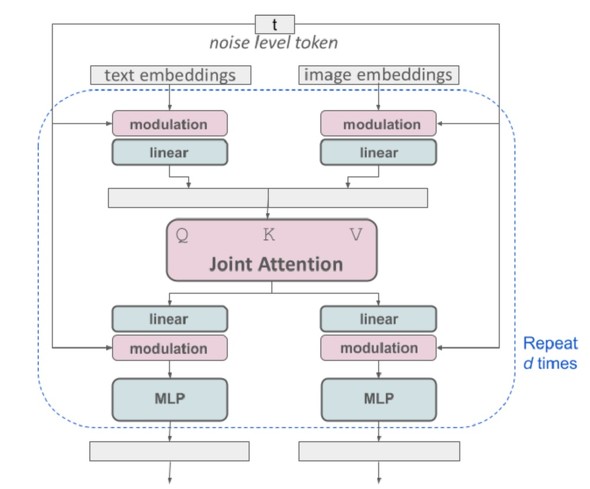

Stable Diffusion 3では、従来のStable Diffusionモデルと異なる新たなアーキテクチャ「MMDiT」(Multimodal Diffusion Transfomer)を採用している。

MMDiTは、Diffusion Transformerを基盤とするアーキテクチャであり、テキストと画像、それぞれのデータ(モダリティ)用に別々の重みを持つ2つのトランスフォーマーを使用して、両方による推論を組み合わせる仕組みだ。推論の重み付けには、Rectified Flow(RF)と呼ばれる手法を採用しており、モデルの性能を向上させたという。

これらのアプローチにより、プロンプトに対する理解度とタイポグラフィが向上している。このアーキテクチャを動画など複数のモダリティに応用することもできると、Stability AIは述べている。

柔軟なテキストエンコーダー

Stable Diffusion 3では、テキストエンコーダーとして47億パラメーターを持つ「T5」(Text-to-Text Transfer Transformer)を採用している。

推論にT5を使用しなければ、メモリ消費量を大幅に抑えることができる。テキストの順守率がわずかに低下するものの、画像の美観には影響を与えない。しかし、T5を含めることで、Stable Diffusion 3のテキスト表現能力を最大限発揮できると、Stability AIは述べている。

今後の展開

Stability AIは、パフォーマンスと安全性を向上させるための洞察を得るべく、先行プレビュー版の参加者を募集している。参加するには、ウェイティングリストに登録する必要がある。

Stability AIは先行プレビュー版のフェーズを経て、今後、8億〜80億のパラメーターに対応するStable Diffusion 3のモデルを公開予定としている。

関連記事

誰もが知っておくべき画像生成AI「Stable Diffusion」の仕組みと使い方

誰もが知っておくべき画像生成AI「Stable Diffusion」の仕組みと使い方

Stable Diffusionの概要と基本的な仕組み、それを簡単に使うための公式なWebサービスである「DreamStudio」を紹介し、Stable Diffusionで画像生成する際に行われていることについて駆け足で見ていきましょう。 5分で分かるディープラーニング(DL)

5分で分かるディープラーニング(DL)

ディープラーニング(深層学習)をビジネスで活用したい人に向け、最新技術情報に基づき、深層学習の概要、ニューラルネットワークの仕組み、深層学習の代表的な手法としてコンピュータビジョン向けのCNN/GAN、および自然言語処理向けのRNN/Transformer(BERT/GPT)の概要を、5分で読めるコンパクトな内容で紹介。最後に、次の一歩を踏み出すための参考情報もまとめる。 Stability AI、動画生成AI「Stable Video Diffusion」のAPIを公開

Stability AI、動画生成AI「Stable Video Diffusion」のAPIを公開

Stability AIは、同社が提供するDeveloper Platformで「Stable Video Diffusion」のAPIを公開した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.