GPT-4に次ぐ性能? LLM「Mistral Large」が登場 Azureでも利用可能:多言語対応、文化的背景理解に強み

Mistral AIがリリースしたLLM、Mistral Largeはテキスト理解、変換、コード生成などさまざまなタスクに活用できる。MistralはAzure AI Studioなどで利用できる。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

フランスのAIスタートアップ企業であるMistral AIは、2024年2月26日(フランス時間)、大規模言語モデル(LLM)「Mistral Large」をリリースした。Mistral Largeは「Microsoft Azure」上で利用できる。低遅延ワークロードに対応したLLM、「Mistral Small」の提供も開始した。

Mistral AIのフラグシップモデル Mistral Large

Mistral AIによると、Mistral Largeは高性能のテキスト生成モデルであり、高いレベルの推論能力を備えており、テキスト理解、変換、コード生成を含む複雑な多言語推論タスクに使用できるという。

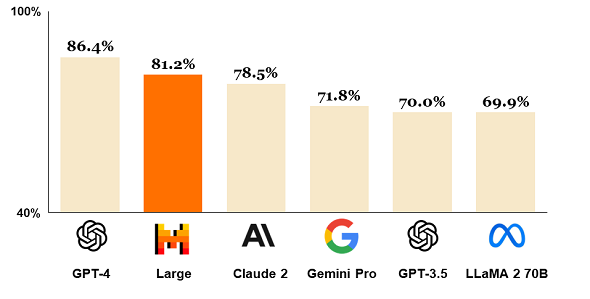

同社の発表では、Mistral Largeは標準的なベンチマークで高い結果を達成している。APIを通じて一般に利用可能なモデルとしては、GPT-4に次いで世界第2位と主張している。

Mistral Largeの機能と強み

同社が主張するMistral Largeの機能と強みは以下の通り。

多言語対応と文化的背景の理解

英語、フランス語、スペイン語、ドイツ語、イタリア語にネイティブに対応し、文法や文化的背景を理解できる。

3万2000トークンのコンテキストウィンドウ

コンテキストウィンドウのトークン数が3万2000あるため、大きいサイズのドキュメントを理解できる。

指示や命令に対する正確な応答

命令を正確に遂行する能力が高いため、開発者はモデレーションポリシーの設計が可能になる。

ネイティブで関数の呼び出しが可能

関数呼び出しのネイティブサポートで、大規模で複雑なアプリケーションの開発や更新が効果的に行える。

Microsoftと提携し、Azure上でモデルを提供

Mistral Largeは2024年3月時点、以下の方法で利用可能だ。

- La Plateforme:Mistral AIのインフラでホストされているアクセスポイント「La Plateforme」で、アプリケーションやサービスを作成できる

- Azure:「Azure AI Studio」と「Azure Machine Learning」でも利用できる

- セルフデプロイメント:開発者自身の環境にデプロイし、モデルの重み付けができる。これにより、センシティブな情報を扱うユースケースに対応できる。利用には、Mistral AIへの問い合わせが必要

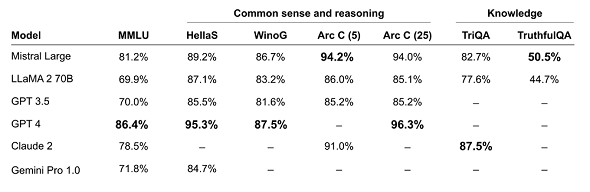

Mistral Largeの性能

一般的に使用されるベンチマークで、Mistral Largeの性能をトップクラスのLLMモデルと比較した結果は以下の通り。

推論と知識

Mistral Largeは推論能力に強みを持っているという。「MMLU」(大規模マルチタスク言語理解を測るために設計されたベンチマーク)をはじめ、「HellaSwag」「WinoGrande」など7つのベンチマークでパフォーマンスを比較した結果を以下に示す。

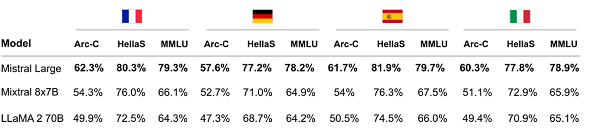

多言語対応

Mistral Largeはフランス語、ドイツ語、スペイン語、イタリア語に対応している。

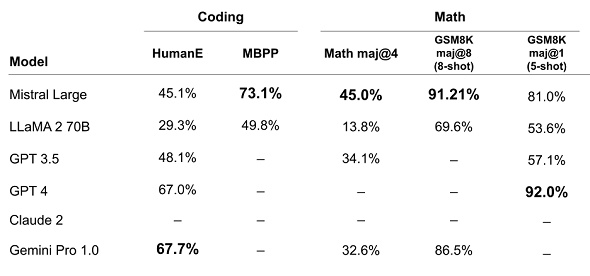

数学とコーディング

Mistral Largeは、数学とコーディングのタスクで高いパフォーマンスを示している。

低遅延ワークロードに最適化された新しいMistral Small

Mistral AIはMistral Largeと並行して、レイテンシとコストを最適化したモデル、「Mistral Small」もリリースした。同社によると、「Mistral Smallは『Mixtral 8x7B』(同社が2023年12月にリリースしたGPT3.5 と同等レベルのLLM)を超える性能を持ち、レイテンシが低いためオープンウェイトモデルとフラッグシップモデルの中間的なソリューションとして最適である」という。

JSONフォーマットと関数呼び出し

「Mistral Large」と「Mistral Small」では、JSONフォーマットモードと関数呼び出し機能を利用できる。

JSONフォーマットモードでは、言語モデルの出力が有効なJSONフォーマットになるように固定される。この機能により、開発者はより自然にモデルを操作して、開発パイプラインで簡単に使用できる構造化された形式で情報を抽出できるようになる。

関数呼び出しは、独自のツールを使用してMistralのエンドポイントを操作できるようになる機能だ。これにより、内部コード、API、データベースとの複雑なインタラクションが可能になるという。

関連記事

オープンソースのLLMをローカルで実行できる「Ollama」Windowsプレビュー版、公開

オープンソースのLLMをローカルで実行できる「Ollama」Windowsプレビュー版、公開

Ollama Projectは、オープンソースの大規模言語モデルをローカル環境で実行できる「Ollama」のWindowsプレビュー版を公開した。 Google、次世代AIモデル「Gemini 1.5」を発表 「10万行のソースコードから修正を提案するデモ」も公開

Google、次世代AIモデル「Gemini 1.5」を発表 「10万行のソースコードから修正を提案するデモ」も公開

Googleは、同社の大規模言語モデル「Gemini」の次世代モデルである「Gemini 1.5」を発表した。 コード生成用オープンアクセスLLM「StarCoder2」を公開 ServiceNow、Hugging Face、NVIDIA

コード生成用オープンアクセスLLM「StarCoder2」を公開 ServiceNow、Hugging Face、NVIDIA

ServiceNow、Hugging Face、NVIDIAは、コード生成用のオープンアクセスLLMファミリー「StarCoder2」を公開した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.