Meta、テキストから動画生成、動画編集、音声生成ができる基盤モデル「Meta Movie Gen」を発表:「競合する幾つかの業界モデルを超える性能」をうたう

Metaは、画像、動画、音声といったメディアを生成する基盤モデル「Meta Movie Gen」を発表した。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

Metaは2024年10月4日(米国時間)、画像、動画、音声といったメディアをAI(人工知能)で生成できる基盤モデル「Meta Movie Gen」(以下、Movie Gen)を公式ブログで発表した。

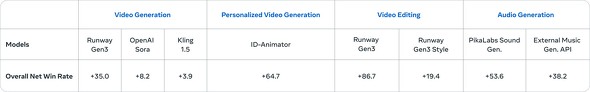

Movie Genは、簡単なテキスト入力に基づく動画生成、パーソナライズされた動画生成、正確な動画編集、音声生成の4つの機能を提供する基盤モデル「Movie Gen Video」「Personalized Movie Gen Video」「Movie Gen Edit」「Movie Gen Audio」で構成されている。Metaは「これらの機能に関する人間による評価結果において、Movie Genは競合する幾つかの業界モデルを上回っている」と述べている。

各モデルは具体的に何が競合モデルを「上回っている」のか?

最大16秒、16fpsの動画を生成するMovie Gen Video

30B(300億)パラメーターのトランスフォーマーモデルであるMovie Gen Videoは、テキストプロンプトから高品質で高精細の画像や動画を生成できる。16fps、最大16秒の動画の生成が可能だ。

Movie Gen Videoは物体の動き、主体と物体の相互作用、カメラの動きを推論でき、さまざまな概念に対して妥当な動きを学習できる。MetaはMovie Genに関する論文の中で、「Movie Gen Videoは、テキストから動画を生成する機能において『Runway Gen3』『LumaLabs』『OpenAI Sora』といった商用システムなど、これまでの最先端の成果を上回る性能を発揮している」と述べている。

画像とテキストからパーソナライズされた動画を生成するPersonalized Movie Gen Video

Metaは、Movie Gen Videoを拡張し、パーソナライズされた動画生成をサポートするPersonalized Movie Gen Videoを開発した。Personalized Movie Gen Videoは、人物の画像を入力とし、テキストプロンプトと組み合わせることで、その人物とテキストプロンプトから得た豊富な視覚的情報を含む動画を生成する。

Metaは「このように人間のアイデンティティーと動きを維持したパーソナライズされた動画を生成する機能は、現在の商用システムには存在しない」と述べ、Personalized Movie Gen Videoが過去の研究成果を上回る性能を達成していることを示す比較結果を紹介している(後述)。

テキストで動画を編集するMovie Gen Edit

Movie Gen Videoに編集機能が加わったバージョンであるMovie Gen Editは、動画とテキストプロンプトの両方を入力として受け取り、正確にタスクを実行し、求められた出力を生成する。ビデオ生成と高度な画像編集を組み合わせ、要素の追加、削除、置き換えなどの局所的な編集や、背景、スタイルの変更などの全体的な変更もできる。

Metaは論文の中で、専門スキルがなくても正確な編集ができるMovie Gen Editの機能についても、現在の商用システムには存在しないと述べ、Movie Gen Editが過去の研究成果を上回る性能を達成していることを示す比較結果を紹介している(後述)。

BGMや効果音が含まれる最大45秒の音声を生成するMovie Gen Audio

13BパラメーターのMovie Gen Audioは、動画とテキストプロンプト(オプション)を入力として、最大45秒の高品質で忠実度の高い音声を生成する。生成する音声には、周囲の音、日常的な効果音、楽器によるBGMなどが含まれ、全て動画コンテンツと同期している。

Metaは論文の中で、Movie Gen Audioは、効果音生成、音楽生成、音声拡張において、「PikaLabs」「ElevenLabs」といった商用システムを含む最先端の成果を上回る性能を発揮すると述べ、Movie Gen Audioとこれらのシステムの比較結果を紹介している。

比較結果

Metaはブログ記事の中で、Movie Genと他のモデルとの比較結果を下記のように紹介し「正のNet Win Rateは、人間がMovie Genを、競合する業界モデルよりも高く評価したことを示すものだ」と述べている。

今後の計画

Metaは、Movie Genの改良を継続し、将来のリリースに向けて取り組むとともに、その過程で映画制作者やクリエイターと緊密に連携し、こうした協力者からのフィードバックを統合していく考えだ。

MetaはMovie Genの将来のユースケースとして、ある1日の出来事を動画にしてInstagramのリールで共有したり、テキストプロンプトを用いて編集したり、友人のためにカスタマイズしたアニメーションのバースデーメッセージを作成し、WhatsAppで送信したりする例を挙げている。

関連記事

Meta、「Llama 3.2」を公開 新たに追加されたビジョンモデルと軽量モデルはどう使える?

Meta、「Llama 3.2」を公開 新たに追加されたビジョンモデルと軽量モデルはどう使える?

Metaは、同社の大規模言語モデルの最新版「Llama 3.2」を提供開始した。中小規模のビジョンモデル(11Bと90B)と、エッジデバイスやモバイルデバイスに搭載可能な軽量のテキスト専用モデル(1Bと3B)をラインアップしている。 Meta、オープンLLMの最新版「Llama 3.1」を発表 「4050億パラメーターモデル」が利用可能に

Meta、オープンLLMの最新版「Llama 3.1」を発表 「4050億パラメーターモデル」が利用可能に

MetaはオープンLLMの最新版「Llama 3.1」を公開した。llama.meta.comとHugging Faceから無料でダウンロードできる。MetaのCEOであるマーク・ザッカーバーグ氏はLlama 3.1の公開に合わせて声明を発表し、オープンなAIの展望を語った。 Meta、AIワークロード用に設計した次世代カスタムメイドチップを発表

Meta、AIワークロード用に設計した次世代カスタムメイドチップを発表

Metaは、AIワークロード用に設計されたMetaカスタムメイドチップの次世代バージョンを発表した。最新バージョンのカスタムチップは、前世代と比較してパフォーマンスが大幅に向上しているという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.