川崎重工がエッジAIを活用する理由――電車のドアに挟まる物を検出、伝達まで猶予は2秒:AIモデルの精度を上げるには(2/2 ページ)

運転士や車掌に伝えるチャンスは約2秒

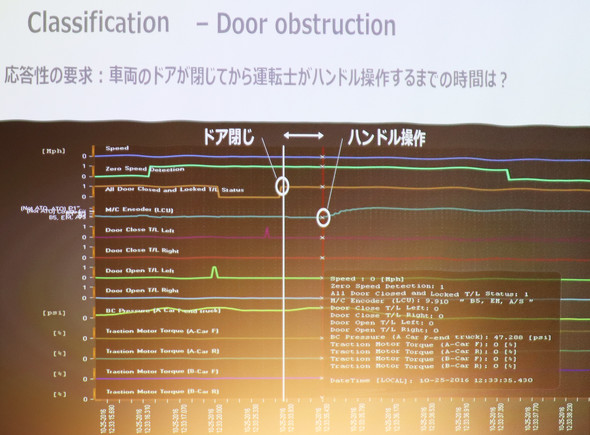

続いて、中岸氏は実運用を踏まえ、戸挟み物を検出して電車運転士や車掌に伝えられる“時間”を検証した。しかし、ここにも課題があったと振り返る。

「このモデルを実運用させるには、車掌が車両のドアを閉じてから、運転士がハンドルを操作して電車を出発させる前に、ドアに戸挟み物があることを伝えなければならない。電車から得られるセンサーデータで確認したところ、車両のドアを閉じてから運転士かハンドルを操作する間は『約2秒』だった。ネットワークを介した画像識別の場合、遅延が発生するため、エッジAIに頼る必要があると分かった」

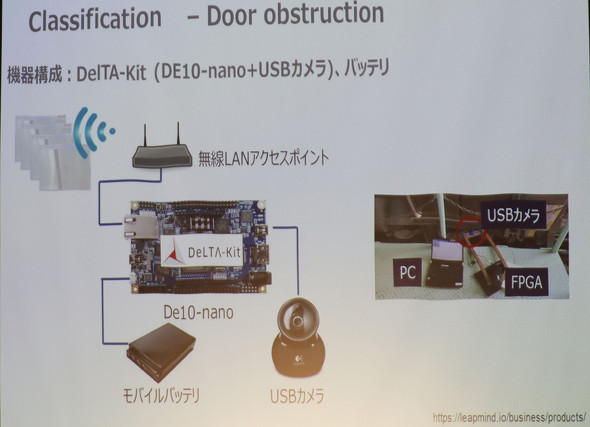

そこで、本番運用でエッジAIを活用することを想定し、LeapMindの深層学習PoC(概念実証)キット「DelTA-Kit」を用いて戸挟みの検出から車掌への伝達にかかる時間を検証した。結果、ドアが閉じてから戸挟みを検出して、車掌に光で異常を伝えるまで約0.3秒で済むことを確認した。

「エッジAIを活用すれば、約2秒の間に戸挟み物を検知して、伝達できるかもしれないことが分かった。今後、研究開発を進め、現場の声を取り入れながら、本番運用できる状態にまで持っていきたい」

ダブルチェックをAIに任せたい

もう一つ紹介したのが、車両下部の機器箱に付いているラッチハンドル(以下、ハンドル)の位置を検出するAIモデルの研究開発だ。

車両下部には運行に必要な機器を収納する箱が設置されており、その箱を開閉するためのハンドルが取り付けられている。整備点検中はこの箱を開けて点検しているが、運行時はハンドルを閉めて、線路上に機器が落下しないようにしている。

「線路上に物を落とすことは絶対にしてはならないことだ。そのため、整備点検終了後はこのハンドルを閉めたかどうか、3〜4人の整備員でチェックしている。このチェックをAIモデルに任せることで、現場の省力化につながるのではないか、と研究開発に取り組んでいる」

しかし、先述した研究開発と同様、こちらのAIモデルも当初は精度が出なかったという。ハンドルを閉めた状態の画像を「正常」、ハンドルを開けた状態の画像を「異常」として学習させても、全ての画像が正常という判定を受けてしまったのだ。そこで中岸氏は発想を転換することにした。

「『過学習になっているのではないか』『光の当たり方など環境が変わっているからではないか』など、うまくいかない原因を考えたが、AIモデルをなかなか改善できずにいた。そこで、AIモデルをどうするかではなく『ものづくり企業だからこそ、ハンドルに何かできるのではないか?』と発想を変えた。ハンドルに特徴を増やすことで精度を上げられるのではないかと考え、ハンドルそのものに赤いテープを付加したり、ハンドルを閉じたときの位置に緑色のテープを付加したりした」

中岸氏は、照明を近くに置いた状態で検証を実施。正解率は低いものの、テープを付加しなかったハンドル画像で学習させたAIモデルに比べ、テープを付与していた方が、AIモデルの精度が上がっていることを確認したという。

「正解率が低いため、今後も研究を進めていく必要はあるが、物に対して特徴を明確に付与することで、どのような環境でもハンドルを検出できるAIモデルを開発できるのではないかと期待している」

中岸氏は、今回の2つの取り組み、そしてエッジAIへの展望を述べて講演を締めくくった。

「製造業の現場では『現場で現物を見て現状を判断する』といわれている。だが、『ワークライフバランス』『働き方改革』『労働人口の減少』がささやかれる今、いかに省力化しつつ生産性を上げるかが、製造業の現場に求められている。とはいえ、働き手が減っても、高い質を維持して製造を続けなければいけない。30年以上前から『業務の一部に画像認識技術を使えないか』という声があったが、エッジAIによる画像認識技術分野の登場で、30年越しに、要望に応えられるのではないかと考えている。ただ、何かが実現するのを待っていても、誰かがやってくれるわけではないので、今後も自分たちで何が実現できるか研究開発を続けて模索していきたい」

関連記事

製造業がアジャイル開発を実践するには? デンソー デジタルイノベーション室長に聞く「イノベーションの前提条件」

製造業がアジャイル開発を実践するには? デンソー デジタルイノベーション室長に聞く「イノベーションの前提条件」

ITでビジネスに寄与する「攻めのIT」という言葉が叫ばれるようになって久しい。だが多くの企業において、成果に結び付かない単なる掛け声に終始してきた傾向が強い。では、この言葉の真意とは何か――デンソーで「攻めのIT」を実践、リードしているデジタルイノベーション室長 成迫剛志氏に、今、企業とエンジニアが持つべきスタンスを聞いた。 ニューラルネットワークライブラリTensorFlow/Kerasで実践するディープラーニング

ニューラルネットワークライブラリTensorFlow/Kerasで実践するディープラーニング

最近流行の機械学習/Deep Learningを試してみたいという人のために、Pythonを使った機械学習について主要なライブラリ/ツールの使い方を中心に解説する連載。今回はニューラルネットワークのライブラリであるTensorFlow/Kerasについて解説します。 日本企業がDXにつまずく理由と、経営・管理・現場層、それぞれの役割

日本企業がDXにつまずく理由と、経営・管理・現場層、それぞれの役割

DX(デジタルトランスフォーメーション)のトレンドが高まり、多くの企業が取り組みに乗り出している。だが「具体的に何をすればいいのか分からない」、取り組みを進めてみても「なかなか成果につながらない」など、プロジェクトを推進できていない例が多い。その真因は何なのか?――既存資産を持たないスタートアップや新興企業ではなく、一般的な企業が既存資産を守りながらDXを推進するためのポイントを聞いた。

Copyright © ITmedia, Inc. All Rights Reserved.