13億パラメーターを持つGPT言語モデルをrinnaが公開、日本語に特化:商用利用も可能

rinnaは13億パラメーターを持つ日本語に特化したGPT言語モデルをMITライセンスで公開した。性能は約14パープレキシティー。一般的な日本語の特徴を持つ文章を自動生成できるという。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

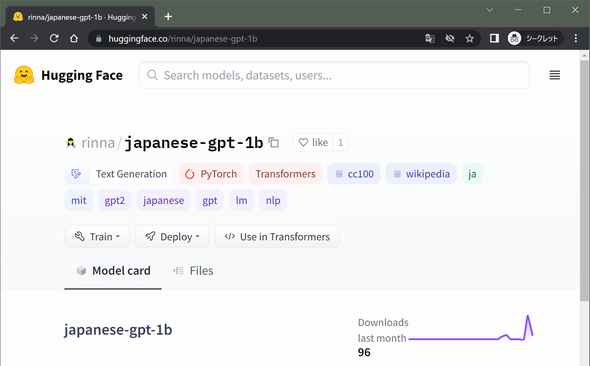

AIキャラクター開発企業のrinnaは2022年1月26日、13億パラメーターを持つ日本語に特化したGPT(Generative Pre-trained Transformer)言語モデルを公開した。MITライセンスで商用利用が可能。公開先は自然言語処理モデルライブラリHugging Face。

GPTは、人間が使う会話や文章に出てくる単語の確率の組み合わせから次の単語の確率を計算する言語モデルだ。

例えば、「確率(吾輩は猫である)=確率(吾輩)×確率(は|吾輩)×確率(猫|吾輩,は)×確率(で|吾輩,は,猫)×確率(ある|吾輩,は,猫,で)」のような方法で計算する。この性質を用いて、「吾輩は」という単語を入力したとき、次の単語として確率が高い「猫」を予測できる。

性能は14パープレキシティー

rinnaが公開した日本語GPTでは、学習データとして、日本語のC4やCC-100、Wikipediaといったオープンデータを使用した。公開前に既に十分に学習させており、性能は約14パープレキシティー。これは、GPTが次の単語を予測するときに単語候補の数を14個に絞れる性能を意味する。そのため、一般的な日本語の特徴を持つ文章を自動生成できるという。

rinnaはこれまで、日本語の自然言語処理に特化した、3.3億パラメーターのGPTや、1.1億パラメーターのBERT(Bidirectional Encoder Representations from Transformers)といった事前学習モデルを公開してきた。自然言語処理の研究では、モデルのパラメーター数が多いほど性能が高いことが知られている。

関連記事

2021年の「AI/機械学習」はこうなる! 5大予測

2021年の「AI/機械学習」はこうなる! 5大予測

2020年は、自然言語処理(NLP)のTransformer技術に基づくBERT/GPT-3や、画像生成のディープフェイクが大注目となる一方で、倫理に関する問題がさまざまな方面でくすぶり続けた。2021年の「AI/機械学習」界わいはどう変わっていくのか? 幾つかの情報源を参考に、5個の予測を行う。 Microsoft、自然言語処理モデルGPT-3がAzureで使える「Azure OpenAI Service」を発表

Microsoft、自然言語処理モデルGPT-3がAzureで使える「Azure OpenAI Service」を発表

イーロン・マスク氏らが設立したOpen AIの開発による自然言語処理モデル「GPT-3」を、Microsoftが独占ライセンスの下で、Microsoft Azure のサービスとして提供開始すると発表した。GPT-3は、人間の書いた文章と見分けがつかないほど自然な文章を作成できるとして、注目を集めている。- [文章生成]パープレキシティーとドロップアウトにより、よりよい文章生成を目指してみよう

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Hugging Faceに公開されたrinnaのGPT言語モデル(

Hugging Faceに公開されたrinnaのGPT言語モデル(