OpenAI、AIモデルのマルチモーダル対応やファインチューニング機能強化を発表 無料でどこまで使える?:コスト効率を高めるプロンプトキャッシングも導入

OpenAIは、同社のAIモデル向けの「Realtime API」(パブリックβ版)、「Chat Completions API」の音声入出力サポート、「ビジョンファインチューニング」機能、「Model Distillation」スイート、「プロンプトキャッシング」を発表した。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

OpenAIは2024年10月1日(米国時間、以下同)、同社のAI(人工知能)モデル向けの「Realtime API」(パブリックβ版)、「Chat Completions API」の音声入出力サポート、「ビジョンファインチューニング」機能、「Model Distillation」スイート、「プロンプトキャッシング」を発表した。

各新機能の概要、利用料は? 無料でどこまで使える?

Realtime APIとChat Completions APIの音声サポート

10月1日にパブリックβ版が提供開始されたRealtime APIは、マルチモーダルな会話体験を低レイテンシで可能にする。現在、テキストと音声の入力と出力、関数呼び出しに対応している。「ChatGPT」のAdvanced Voice Modeと同様に、6種類の設定済み音声を用いて自然な音声会話をサポートする。

数週間以内にリリースされるChat Completions APIの音声入出力機能は、Realtime APIで実現される低レイテンシを必要としないユースケースをサポートする。

これまで、アプリケーションにマルチモーダルな体験を組み込むには、音声認識モデル、テキストモデル、音声合成モデルなど複数のモデルを組み合わせる必要があった。これらのAPIを使えば、1回のAPI呼び出しで自然な会話体験を構築できるようになる。

Realtime APIの音声機能は、「GPT-4o」の新モデル「gpt-4o-realtime-preview」によって実現される。Completions APIの音声機能は、新モデル「gpt-4o-audio-preview」で実現される。gpt-4o-audio-previewにより、開発者はGPT-4oにテキストまたは音声を入力し、テキスト、音声、またはその両方で応答を受け取れる。

Realtime APIはテキストトークンと音声トークンの両方を使用する。利用料金は、テキストでは1M(100万)入力トークン当たり5ドル、1M出力トークン当たり20ドル。音声では1M入力トークン当たり100ドル、1M出力トークン当たり200ドル。これは音声入力1分当たり約0.06ドル、音声出力1分当たり約0.24ドルに相当する。Completions APIの音声機能の利用料金も、これと同額となっている。

ビジョンファインチューニング機能

10月1日からGPT-4oにビジョンファインチューニング機能が導入され、テキストに加えて画像でもファインチューニングができるようになった。この新機能により、より強力な画像理解能力を持つようにGPT-4oをカスタマイズし、ビジュアル検索機能の強化、自律走行車やスマートシティーのための物体検出の改善、より高精度の医療画像解析などを実現できる。

テキストによるファインチューニングプロセスと同様に、適切なフォーマットの画像データセットを用意し、OpenAIのプラットフォームにアップロードすることで、GPT-4oのビジョンタスクのパフォーマンスを向上させることができる。100枚の画像をアップロードするだけで効果が得られるケースもあり、より大量のテキストや画像でさらにパフォーマンスを引き上げることが可能だという。

ビジョンファインチューニング機能は、GPT-4oモデルの最新スナップショット「gpt-4o-2024-08-06」でサポートされている。

OpenAIは10月31日まで、画像によるGPT-4oのファインチューニング用に、1日につき1Mトレーニングトークンを無料で提供する。11月1日以降は、GPT-4oのファインチューニングトレーニングには1Mトークン当たり25ドル、推論には1M入力トークン当たり3.75ドル、1M出力トークン当たり15ドルの料金がかかる。画像入力は画像サイズに基づいてトークン化され、テキスト入力と同じトークン単価が適用される。

Model Distillationスイート

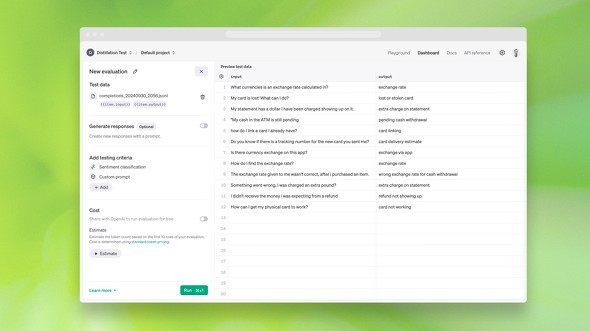

10月1日に提供開始されたModel Distillationスイートは、GPT-4oや「o1-preview」などOpenAIの任意のモデルのディスティレーション(蒸留)に利用できる。

ディスティレーションは、大規模モデルの出力を利用して、より小さなモデルをファインチューニングし、特定のタスクで大規模モデルに匹敵するパフォーマンスを実現できるようにすること。このプロセスにより、コストとレイテンシの大幅な削減が可能になる。より小さなモデルの方が通常、コスト効率が高いからだ。

新しいModel Distillationスイートは、「Stored Completions」「Evals」(β版)、ファインチューニング機能というコンポーネントで構成されている。

OpenAIは10月31日まで、「GPT-4o mini」では1日につき2Mトレーニングトークン、GPT-4oでは1日につき1Mトレーニングトークンを無料で提供し、開発者がディスティレーションを始められるよう支援している。この上限を超えると、ディスティレーションによってファインチューニングされたモデルのトレーニングと実行には、標準的なファインチューニング料金(OpenAIのAPI料金のページに掲載)と同じ料金がかかる。

Stored Completionsは無料で利用でき、Evalsは、使用されたトークンに基づく標準モデル料金で課金される。

プロンプトキャッシング

モデルのプロンプトには、同じ内容が繰り返し含まれる場合が多い。そこでOpenAIは、プロンプトをキャッシュし、APIリクエストを、同じプロンプトを最近処理したサーバにルーティングすることで、プロンプトを一から処理するよりも低コストで高速に処理するプロンプトキャッシングを導入した。

10月1日から、GPT-4o、GPT-4o mini、o1-preview、「o1-mini」の最新バージョンおよびこれらのモデルのファインチューニングバージョンに、プロンプトキャッシングが自動的に適用されるようになった。

プロンプトキャッシングにより、長いプロンプトの場合、レイテンシを最大80%削減し、コストを50%削減することができる。プロンプトキャッシングは、全てのAPIリクエストで自動的に機能し(コードの変更は不要)、追加料金も発生しない。キャッシュされたプロンプトは、キャッシュされていないプロンプトと比べて、入力トークン単価が半額になる。

関連記事

「GPT-4o」でファインチューニングが利用可能に 使い始めるには、事例は、セキュリティは?

「GPT-4o」でファインチューニングが利用可能に 使い始めるには、事例は、セキュリティは?

OpenAIは「GPT-4o」のファインチューニング機能の提供を開始した。コーディングやクリエイティブな執筆といったユースケースで、モデルの出力結果に大きな影響を与える可能性があるという。 OpenAI、ChatGPT Enterpriseでのコンプライアンス管理を支援する「Enterprise Compliance API」をリリース

OpenAI、ChatGPT Enterpriseでのコンプライアンス管理を支援する「Enterprise Compliance API」をリリース

OpenAIはChatGPT EnterpriseのユーザーをサポートするAPI「Enterprise Compliance API」のリリースを発表した。APIはコンプライアンス要件への対応や管理機能を提供する。 生成AIの誤りを生成AIが見抜く、OpenAIの「CriticGPT」 その実力とは

生成AIの誤りを生成AIが見抜く、OpenAIの「CriticGPT」 その実力とは

OpenAIは同社の「ChatGPT」における応答の誤りを発見する「CriticGPT」を発表した。生成AIが生成AIの誤りを見抜く意義や、構築方法を解説した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.