AWS、最新世代GPUベースのEC2インスタンス「P5en」を追加して前世代の「P5」よりレイテンシを35%改善、その仕組みとは?:CPUとGPU間のスループットが4倍高速化

Amazon Web Services(AWS)は、「Amazon Elastic Compute Cloud(Amazon EC2)P5en」インスタンスの一般提供を開始した。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

Amazon Web Services(AWS)は2024年12月2日(米国時間)、「Amazon Elastic Compute Cloud(Amazon EC2)P5en」インスタンスの一般提供を開始したと発表した。

Amazon EC2 P5enは、最新世代のGPUベースのインスタンスファミリーである「Amazon EC2 P5」の新インスタンス。AWSは、このファミリーのインスタンスはディープラーニングとハイパフォーマンスコンピューティング(HPC)において、Amazon EC2の中で最高のパフォーマンスを発揮すると述べている。

Amazon EC2 P5enの仕組み、効果を発揮する使いどころは?

Amazon EC2 P5enインスタンスは、NVIDIA H200 Tensor Core GPUと、AWSでのみ利用可能なオールコアターボ周波数3.2GHz(最大3.8GHz)のカスタム第4世代インテルXeonスケーラブルプロセッサを搭載する。

P5enではこれらのプロセッサにより、メモリ帯域幅が50%拡大し、CPUとGPU間のスループット(データ伝送速度)がPCIe Gen5によって最大4倍に高速化しており、機械学習(ML)のトレーニングと推論ワークロードのパフォーマンスを向上させる。

またP5enは、ネットワーク帯域幅が最大3200 Gbpsの第3世代Elastic Fabric Adapter(EFAv3)をクラウド基盤用カスタムチップのAWS Nitro v5とともに使用することで、前世代のEFAとNitroを使用する「P5」インスタンスと比べて、レイテンシが最大35%改善している。これはディープラーニングなどの分散トレーニングワークロード、生成AI(人工知能)、リアルタイムデータ処理、HPCアプリケーションのコレクティブ通信パフォーマンスの向上に役立つ。

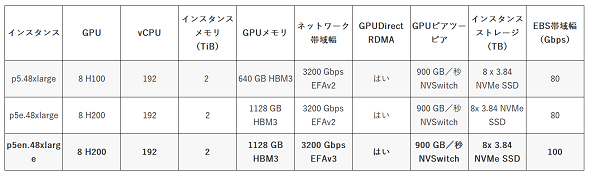

P5enと既存のP5ファミリーのインスタンス(P5、「P5e」)の仕様は以下の通り。

2024年9月にリリースされたAmazon EC2 P5eインスタンスは、低レイテンシと効率的なスケールアウトパフォーマンスを実現した。P5enでは、推論とネットワークのレイテンシがさらに低減しており、GPUアクセラレーションを利用した幅広いアプリケーションの全体的な効率を高めることができる。

さらに、P5enはP5と比べて、ローカルストレージのパフォーマンスが最大2倍、Amazon Elastic Block Store(Amazon EBS)の帯域幅が最大25%向上している。このため、モデルの重みをキャッシュするためにローカルストレージを使用する場合、推論のパフォーマンスをさらに向上させることができる。

また、CPUとGPU間のデータ転送は、特に、頻繁なデータ交換を必要とする大規模なデータセットやワークロードの場合、時間がかかることがある。P5enはPCIe Gen 5の採用により、P5およびP5eと比べて、CPUとGPU間の帯域幅が最大4倍に拡大しているため、複雑な大規模言語モデル(LLM)やマルチモーダル基礎モデル(FM)のモデルトレーニング、ファインチューニング、推論実行に加え、メモリ集約型HPCアプリケーション(シミュレーション、創薬、天気予報、財務モデリングなど)のレイテンシをさらに改善できる。

AWSは、これらのAmazon EC2 P5ファミリーのインスタンスをMLやHPCに利用する場合、以下のAWSサービスと組み合わせることで、効率的に作業を開始できるとしている。

- MLに利用する場合:Amazon SageMaker、AWS Deep Learning AMI(DLAMI)、AWS Deep Learning Containers、Amazon EKS、Amazon ECS

- HPCに利用する場合:AWS Batch、AWS ParallelCluster

Amazon EC2 P5enインスタンスは、EC2 Capacity Blocks for MLを介して、米国東部(オハイオ)、米国西部(オレゴン)、アジアパシフィック(東京)の各AWSリージョンと、米国東部(バージニア北部)リージョンのアトランタローカルゾーン(us-east-1-atl-2a)で利用できる。

関連記事

AWS、管理コンソールのGUI操作をコード化する「AWS Console-to-Code」を提供開始 使用方法や注意点は?

AWS、管理コンソールのGUI操作をコード化する「AWS Console-to-Code」を提供開始 使用方法や注意点は?

AWSはマネジメントコンソールの操作を再利用可能なコードに変換できる「AWS Console-to-Code」の一般提供を開始した。 AWSとNVIDIA、生成系AI分野で協業 NVIDIA H100 GPUを搭載した「EC2 P5インスタンス」を発表

AWSとNVIDIA、生成系AI分野で協業 NVIDIA H100 GPUを搭載した「EC2 P5インスタンス」を発表

AWSとNVIDIAは、AIインフラ分野での協業を発表した。NVIDIA H100 GPUを搭載した「EC2 P5インスタンス」の提供を始めとするさまざまな取り組みを通じて、大規模言語モデルの学習や生成系AIアプリケーションの開発に最適化した、拡張性の高いAIインフラの提供を目指すとしている。 サーバなんて触ったことないから分からない――クラウド世代のための「サーバ」超入門

サーバなんて触ったことないから分からない――クラウド世代のための「サーバ」超入門

これまであまり物理的なサーバとストレージに触れてこなかった方を対象に、AWSを用いてサーバとストレージの基礎知識を解説する連載。初回は、サーバと仮想化について基本から解説し、Amazon EC2の操作手順を示す。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.