膨大なAI生成コード、1回平均20分レビューの価値は4000円? Claude Codeに「Code Review」機能追加:プルリクの承認自体は人間が行う

Anthropicはエージェント型コーディングツール「Claude Code」に「Code Review」機能を導入し、「Team」および「Enterprise」プラン向けにβ版のリサーチプレビューとして提供開始した。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

Anthropicは2026年3月9日(米国時間)、エージェント型コーディングツール「Claude Code」への「Code Review」機能の導入を発表した。

エージェント群がGitHubのプルリクエスト(PR)を分析し、コードのバグを検出するこの機能は、Anthropic社内で運用されているシステムをモデルとしたものだ。現在、Anthropicの「Claude」サブスクリプションの「Team」「Enterprise」プラン向けにβ版のリサーチプレビューとして提供されている。

AnthropicではAI(人工知能)の活用により、エンジニア一人当たりのコード出力量が大幅に増加した。だが、要員確保が追い付かず、コードレビューが開発のボトルネックとなっていた。顧客からも同様の状況を伝える声が寄せられていた。

そこでAnthropicは、信頼性の高いレビューを大規模に実施する目的でCode Reviewを導入し、現在ではほぼ全てのPRに適用している。PRの承認自体は人間が行うが、このツールが人手不足を補うことで、レビュアーは膨大な業務に対応できるようになった。

Code Reviewの仕組み

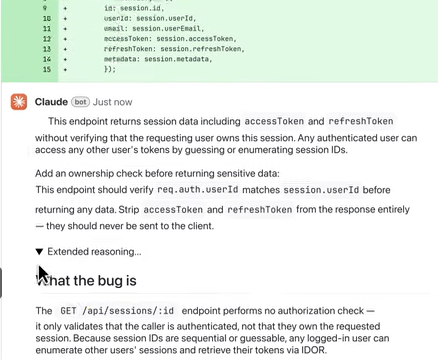

管理者が組織でCode Reviewを有効にすると、PRの作成時または更新時に、レビューが自動的に実行される。Code Reviewがエージェント群を起動し、これらのエージェントが並行して、コードベース全体のコンテキストの中で、差分とその周辺コードを精査し、論理エラー、セキュリティ脆弱(ぜいじゃく)性、考慮漏れのエッジケース、微細なリグレッション(先祖返り)といった問題を探し出す。人間のレビュアーが見落としがちなバグも捕捉できる。

こうしたチェックは、正確性に焦点を当てて、本番環境で障害を引き起こすようなバグを対象に行われるが、ガイドラインファイルを追加することで、チェック対象を拡張することもできる。

検出結果は検証され、深刻度レベルが以下のようにタグ付けされる。

- 通常:マージ前に修正すべきバグ

- 軽微:修正する価値はあるが、ブロックするほどではない問題

- 既存:コードベースに以前から存在し、当該のPRで導入されたものではないバグ

検出結果は、PR上に単一の概要コメントとして表示され、特定のバグにはインラインコメントが付く。

レビューはPRの規模に応じて調整される。大規模または複雑な変更では、より多くのエージェントが割り当てられ、深く検証される。ささいな変更では簡易的なチェックとなる。Anthropicのテスト結果では、平均的なレビュー時間は約20分だ。

レビューのカスタマイズ

Code Reviewは、リポジトリ内の2つのファイルを読み取り、フラグを立てる内容を微調整する。これらはデフォルト(既定)の正確性チェックに追加される形で適用される。

- CLAUDE.md:Claude Codeがレビューだけでなく、全てのタスクで使用する共有プロジェクト指示書。インタラクティブなClaude Codeセッションにも適用されるガイドラインが含まれている

- REVIEW.md:レビュー専用のガイドライン。コードレビュー時にのみ読み取られる。「レビュー時に何を指摘し、何をスキップすべきか」を厳密に規定するルールなどが含まれている。

Claudeは、リポジトリのルートにあるREVIEW.mdを自動的に検出する。

使用状況の確認

「https://claude.ai/analytics/code-review」ページでダッシュボードにアクセスし、組織全体のCode Reviewの使用状況を確認できる。確認できる項目には、選択した期間内にレビューされたPRの日次件数、Code Reviewの週間費用、開発者が問題を修正したことで自動解決されたレビューコメントの件数、リポジトリごとのレビュー済みPR数と解決済みコメント数などが含まれる。

料金

Code Reviewは、トークン使用量に基づいて課金される。平均コストは15〜25ドル(約2380〜3970円、1ドル=158.53円換算)で、PRのサイズ、コードベースの複雑さ、検証が必要な問題の数によって変動する。

管理者は以下の方法でCode Reviewの使用量と費用を管理できる。

- 組織全体の月間上限:全レビューにおける月間総費用を定義する

- リポジトリレベル制御:選択したリポジトリでのみCode Reviewを有効化する

- 分析ダッシュボード:レビュー済みPR、承認率、総レビューコストを追跡する

関連記事

GitHubが明かす、AI支援開発の勢いを殺す「断片化税」の正体

GitHubが明かす、AI支援開発の勢いを殺す「断片化税」の正体

GitHubは、AI支援開発ツールの「断片化」を解決する統合プラットフォームを紹介した。成功ビルドが84%増加し、「後で修正」の手戻り作業が大幅に減少するなどの成果を確認しているという。 「AIコーディングをどう使うか」次第でスキルが低下? Anthropicが分析、3つの利用パターン

「AIコーディングをどう使うか」次第でスキルが低下? Anthropicが分析、3つの利用パターン

Anthropicは、AIアシスタントが開発者のスキル習得に与える影響を検証した結果を発表した。実験ではAI支援を使用したグループの理解度が手作業グループより17%低かった。 テストもデバッグもレビューも「AIエージェントとの協働」が標準に Anthropicが示す2026年の開発トレンド

テストもデバッグもレビューも「AIエージェントとの協働」が標準に Anthropicが示す2026年の開発トレンド

Anthropicは「2026 Agentic Coding Trends Report」を公開した。コーディングエージェントの活用における主要な8つのトレンドを特定し、解説を加えたものだ。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.