AIにコードを書かせたら、“動くのに本番で壊れるバグ”が増えた? その原因と対策:Deep Insider Brief ― 技術の“今”にひと言コメント

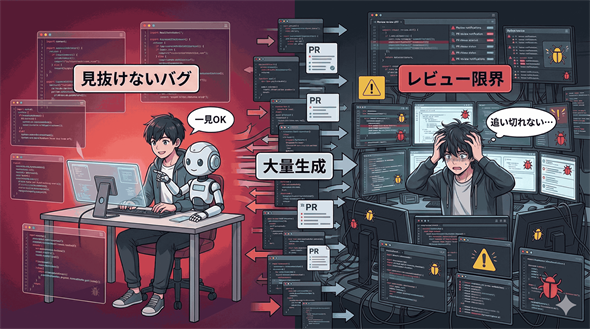

AIコーディングは開発を加速させる一方で、「見抜けないバグ」という新たなリスクを生んでいるという。一見動くのに本番環境で障害を引き起こす厄介なバグの脅威と、現場で取れる対策、さらに最新動向も踏まえた筆者の意見をまとめる。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

AIコーディングエージェントの普及により、開発速度は劇的に向上した。しかしその裏で、「見た目には正しそうなのに本番環境で障害を引き起こす」という厄介なバグの増加が指摘されるようになっている。Stack Overflow Blogで公開された記事(CodeRabbit社の調査に基づく内容)によると、AIが生成したコードには、人間が書いたものよりも多くの、しかも重大な問題につながりやすいバグが含まれているという。

この問題の本質は、AIが「タイポ(打ち間違い)」のような単純なミスは人間より少ない一方で、人間には見抜きにくいロジックエラー(処理の論理構造の間違い)を多く生み出してしまう点にある。しかもAIはコードを大量に生成するため、PR(プルリクエスト:コード変更提案)件数が増えやすく、従来の人間によるコードレビューでは対処し切れない「レビュー崩壊」とでも呼ぶべき状況が現実の問題として浮かび上がりつつある。

記事が紹介する調査では、470のオープンソースGitHubリポジトリを分析した結果、AIが作成したPRは人間に比べて約1.7倍多くのバグを含んでいた。中でもロジックと正確性に関するエラー(例:ロジックの誤りや依存関係の設定ミス、制御フローの間違い)は75%多く、100件のPR当たり194件に達した。こうしたエラーはコードの見た目が正しそうに見えるため、レビューで最も見逃されやすい。

さらに深刻なのが、AI生成コードの可読性(読みやすさ)が人間の3倍低いという点だ。フォーマットの問題が2.66倍、命名の不整合が2倍とコード自体が読みにくい上に、AIは一度に大量のコードを出力するためPRの差分が膨大になる。記事では「10行のPRにはコメントが殺到し、500行のPRは即承認される」という「ささいな事柄の法則(Law of triviality:小さな変更ほど細かくチェックされ、大きな変更ほどそのまま通る傾向)」にも言及している。読みにくい大量のコードが「見抜けないバグ」を増やしているというわけだ。

――ここからは『Deep Insider Brief』恒例の"ひと言コメント"として、2026年3月に相次いで登場したAIコードレビュー機能の動向も踏まえつつ、この問題を補足してみたい。その後で、現状の問題と現場で取れる対策を整理する。

Deep Insider編集長の一色です。こんにちは。

Stack Overflowの記事は2026年1月末の公開です。現在は4月初頭ですが、この約2カ月の間にもAIコーディングはさらに進化しました。今回取り上げた課題に対しても、ツール側で吸収しようとする動きが急速に広がっています。

実際、2026年3月には、Claude CodeでGitHubのPRを対象にしたコードレビュー機能が追加されました。PRされたコードを、AIエージェント群がリポジトリ(コードの保管場所)全体の文脈まで見ながら確認する仕組みです。Anthropicは、こうしたレビューの導入によって、実質的なレビューコメントが付くPRの割合が16%から54%に上がったと報告しています。

ただし、これで問題が解決したわけではありません。高精度なAIレビューは便利ですが、その分コストもかかります。特に複数エージェントで深くレビューする仕組みは高額になりやすく、今後はレビュー費用そのものが開発コストを押し上げる可能性があります。また、AIレビューも万能ではなく、問題のない箇所まで過剰に指摘することがあります。Anthropic自身も、より高精度なレビューは既存のGitHub Actionより高コストだと説明しており、最終的な承認は人間が行う前提です。

特にジュニア開発者の皆さんに伝えたいのは、AIレビューがあるからといって、そこで思考を止めてはいけないということです。AIが「OK」と言ったからPRを出す、ではレビューの力は身に付きません。これからのエンジニアには、コードを書く力だけでなく、AIの検証プロセスをどう設計し、どこで人間が責任を持つかを判断する力が求められていくはずです。AIに依存し過ぎず、自分自身の実力も伸ばしていきたいですね。

それでは、Stack Overflowの記事が示す「AIコーディングの現実」と「現場で取るべき対策」を整理しよう。

AIコーディングで何が起きているのか、なぜ起きるのか、どう対処すべきか

1. AIコードでは、どんな問題が増えているのか

- 全体のバグ数が増加: AIが作成したPRは、人間が作成したものよりも全体として1.7倍多くのバグを生んでいた

- 重大・重要な問題も増加: 小さな不具合だけでなく、重大・重要な問題も1.3〜1.7倍多かった

- ロジックと正しさの問題が突出: 最も大きな差が出たのはロジックと正しさに関わる問題で、AI生成PRでは75%多かった

- セキュリティ問題も増加: 不適切なパスワード処理や不安全なオブジェクト参照などが1.5〜2倍多かった

- 並行処理や依存関係の誤りも増加: 並行処理の使い方、処理順序、依存関係の流れの誤りが2倍起きやすかった

- エラーハンドリングの不備も増加: nullチェック、早期リターン、防御的コーディング(異常系を先回りして守る書き方)の不足など、エラーや例外への備えに関する問題も、AI生成PRでほぼ2倍多かった

- 性能問題の一部は顕著: 不要なI/O(入力/出力処理)はAIコードで約8倍多かった

- 一方で人間の方が多いミスもある: タイポやテストしにくいコードは、人間の方が多く作っていた

2. なぜAIコードは危険になりやすいのか

- コンテキスト(文脈)が足りない: LLM(大規模言語モデル)は大量の学習データを持つ一方で、そのプロジェクト固有のコードベースや設計意図までは持っていない

- 与えたコンテキストも途中で落ちる: システムプロンプトやAGENTS.mdファイルなどでコンテキスト(文脈)を渡しても、長時間動かすとコンテキスト圧縮などで古い文脈が押し出され、重要な情報が抜け落ちていく

- 長時間の自律実行でミスが蓄積: ハルシネーション(もっともらしい誤り)や小さな判断ミスが積み重なり、最後にはその誤りがコードにそのまま残ってしまう

3. なぜレビューで見抜きにくいのか

- ロジックエラーは見た目では分かりにくい: 一見もっともらしいコードに見えるため、実際に頭の中で追わないと見抜けない

- 可読性の問題が大きい: AIコードは人間のコードより3倍可読性の問題が多く、書式の問題は2.66倍、命名の不整合は2倍多かった

- 差分が大きくなりやすい: エージェント型ツールでは巨大なコミットや大量の差分が生まれやすく、レビュー負荷が急増する

- 「ささいな事柄の法則」が働く: 小さな変更ほど細かく見られ、大きな変更ほどそのまま通りやすい傾向があり、重大な問題が埋もれやすい

- 技術的負債も拡大する: 読みにくいコードは、障害そのものの原因でなくても、障害対応や保守を難しくする

4. 記事がお薦めする基本対策

- 事前に計画する: 要件・設計・機能をできるだけ前もって明確にし、仕様主導で進める

- コンテキスト情報を渡す: スタイルガイドやコードベース(既存のコード群)のドキュメントなどをAIに参照させる

- タスクごとに適したLLMを使う: モデルによって得意分野やプロンプトの挙動が異なるため、用途に応じて使い分ける

- タスクを小さく分ける: エージェントに長時間まとめて任せず、小さな単位で実行する

- PRも小さくする: レビュアーが理解できる粒度に保つ

- AIが作成を手伝ったPRは、AI特有のミスを意識してレビューする: ロジックエラーやセキュリティ問題など、AIが起こしやすいミスを念頭に置き、人間のコード以上に注意してレビューする

- ビルド、テスト、デプロイを重視する: 後工程の自動チェックをこれまで以上に重視する

- QA(品質保証)チェックリストを使う: AIコードで起こりやすい問題を確認項目に入れる

- ユニットテスト、静的解析、オブザーバビリティーを強化する: 実装の正しさ、コード品質、運用時の見える化を補強する

- 必要ならAIをAIでチェックする: レビューやテストにAIを活用するのも選択肢になる

5. 最後に見直すべき視点

- コード量は生産性の指標にならない: 人間の生産性で行数が良い指標でなかったのと同じく、AIでもコード量だけでは評価できない

- 本当に見るべき指標が変わる: 生成量ではなく、レビュー時間、障害件数、保守負荷まで含めて総合的に見る必要がある

- 2025年が「速度」の年なら、2026年は「品質」の年: 記事は、2025年がAIコーディングの速度の年なら、2026年は品質の年になると締めくくっている

Copyright© Digital Advantage Corp. All Rights Reserved.