Google、機械学習を用いたモバイルアプリ開発をサポートする「ML Kit」β版をリリース:Firebaseから利用、AndroidおよびiOSに対応

Googleは、同社の機械学習ノウハウをパッケージ化した新しいSDK「ML Kit」のβ版をモバイル開発者に提供開始した。

Googleは2018年5月8日(米国時間)、開発者向けイベント「Google I/O 2018」において、「ML Kit」のβ版を発表した。ML Kitは、同社の機械学習ノウハウを使いやすいパッケージとしてモバイル開発者に提供する新しいSDKだ。同社のモバイルプラットフォーム「Firebase」のコンソールから利用でき、AndroidおよびiOS向けアプリに機能を組み込める。

Googleは、「人々は、モバイルアプリがインテリジェント化し、ユーザーの行動に適応したり、ユーザーを賢く喜ばせたりすることを期待するようになっている。そのため、機械学習はモバイル開発における重要なツールになる」との認識を示している。この認識からML Kitをリリースしたという。

さらにGoogleは、「モバイル開発への機械学習の応用は、機械学習の初心者にとってもベテランにとっても多大な労力やコストがかかる。だが、ML Kitを使えば、開発者は機械学習ノウハウのレベルにかかわらず、機械学習を利用して魅力的な機能を実装できる」としている。

一般的なユースケースで本番環境に対応

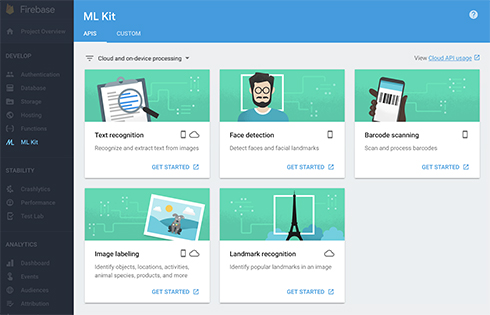

機械学習を用いたモバイル開発を始めたい初心者向けに、ML Kitは5つのAPI(基本API)を提供する。これらのAPIは下記の一般的なモバイルユースケースに対応している。

- テキスト認識

- 顔検出

- バーコードスキャン

- 画像ラベリング

- ランドマーク認識

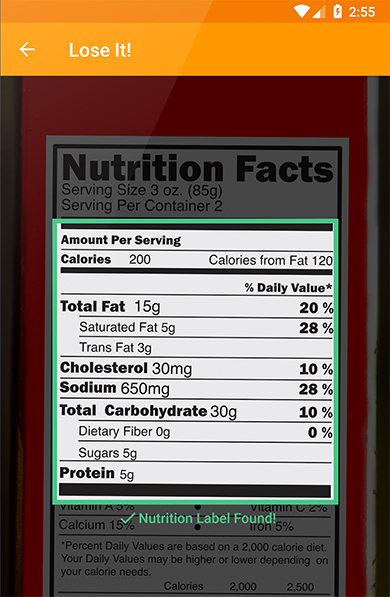

これらの基本APIにより開発者は、データをML Kitに渡し、直感的な応答が得られるという。例えば、ML Kitの初期ユーザーの1社であるLose It!は、同社のカロリー追跡アプリの最新版に含まれる幾つかの機能を作成した。テキスト認識に対応する基本APIとカスタムモデルを使って、このアプリは商品ラベルから栄養情報を素早くキャプチャーし、画像から分かる食品内容を入力する。

ML Kitは、オンデバイスAPIとクラウドAPIの両方を、共通のシンプルなインタフェースで提供し、開発者が要件に最適なAPIを選べるようにしている。オンデバイスAPIはデータを高速に処理し、ネットワーク接続がないときも動作する。クラウドAPIは、Google Cloud Platformの機械学習技術の力を利用して、高い精度を実現するという。

これらのAPIはFirebaseコンソールで以下のように確認できる。

さらに、Googleは数カ月以内に2つのAPIリリースする計画だ。1つは、コンテキストに基づくメッセージング応答をアプリでサポートするためのスマート応答API。もう1つは、高精度の顔輪郭データを利用できるようにするAPIだ。

カスタムモデルのデプロイ

一方、機械学習のベテランは、ML Kitを使ってモバイル開発を行う際に、ユースケースをカバーする基本APIがなくても、独自のTensorFlow Liteモデルをデプロイできる。

Firebaseコンソールからこれらのモデルをアップロードすれば、Googleがモデルのホスティングとアプリユーザーへの提供を管理する。そのため、モデルをAPK/バンドルに含める必要がない。これによってアプリのインストールサイズを抑えることができる。またML Kitは、開発者の独自モデルを動的に提供するので、開発者はアプリを再パブリッシュすることなく、いつでもモデルを更新できる。

さらにGoogleは、アプリの機能の向上や拡充に伴うインストールサイズや機械学習モデルサイズの拡大を考慮し、開発者がフルTensorFlowモデルを訓練データとともにアップロードすると、圧縮されたTensorFlow Liteモデルが得られるという機能も実験的に提供している。

Firebaseプロダクトとの連携

ML KitはFirebaseで提供されるので、広範なFirebaseプラットフォームを容易に利用できる。例えば、リモート構成やA/Bテスト機能を使って、複数のカスタムモデルを試すことが可能だ。

さらに、「Cloud Firestore」への画像ラベルの保存、「Performance Monitoring」による処理レイテンシの測定、「Google Analytics」によるユーザーエンゲージメント効果の把握といったことも可能だ。

関連記事

Googleが機械学習/AI活用で見せた「これまでとは違った景色」、トップ7

Googleが機械学習/AI活用で見せた「これまでとは違った景色」、トップ7

Googleは「Google I/O 2018」で、同社サービスにおける機械学習/AIの活用によって、人々の生活を大きく変えられる可能性を示した。紹介された多数の新機能の中から、筆者の独断でトップ7を紹介する。 グーグルの機械学習/AIへの取り組みを支える「AIファーストデータセンター」とは

グーグルの機械学習/AIへの取り組みを支える「AIファーストデータセンター」とは

米グーグルが開発者向けイベント「Google I/O 17」で、同社のコンシューマー向けサービスにAI/機械学習を広範に適用、これによってサービスプロダクトを相互に結び付け、システマチックに進化させていることをアピールした。その裏にはもちろん、TensorFlowとGoogle Cloud Platformがある。同社は機械学習処理を高速化する「Cloud TPU」、Androidデバイス上のAI処理のための「TensorFlow Lite」について、併せて紹介した。 Google、オープンソース機械学習ライブラリの最新版「TensorFlow 1.5」を発表

Google、オープンソース機械学習ライブラリの最新版「TensorFlow 1.5」を発表

オープンソース機械学習ライブラリの最新版「TensorFlow 1.5」が公開された。「Eager Execution」「TensorFlow Lite」、GPUアクセラレーション対応の強化が特徴だ。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.