生成AIのセキュリティに関する規則が策定されている企業は20%未満 IPAが調査結果を発表:「解決すべき課題の優先度がついていない状況」

IPAは、「AI利用時の脅威、リスク調査報告書」を公開した。業務でAIを利用している人のうち、6割がAIのセキュリティに関して脅威を感じており、7割がセキュリティ対策は重要だと考えていることが分かった。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

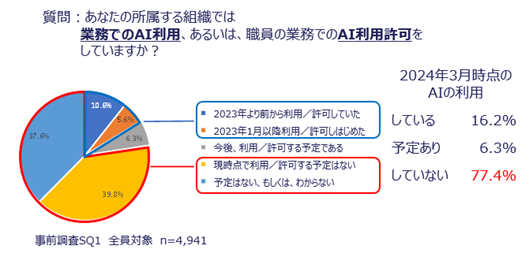

情報処理推進機構(IPA)は2024年7月4日、「AI(人工知能)利用時の脅威、リスク調査報告書」を公開した。これはAIを業務で利用または利用予定がある人を対象にAIを業務で利用するに当たってのセキュリティ上の脅威やリスクについて調査し、結果をまとめたもの。1000人から有効回答を得た。それによると「業務でAIを利用(もしくは利用を許可している)」と回答した企業の割合は16.2%。「これから許可予定」は6.3%だった。

約8割の企業が「生成AIのセキュリティに関連した規則」を策定していない

業務でAIを利用している人(利用許可をしている人)のうち、AIのセキュリティに関して「重大な脅威である」「やや脅威である」と回答した人の割合は60.4%。AI導入、利用可否に関するセキュリティ対策の重要度については、分類AIの利用者の74.5%、生成AI利用者の75.0%が「非常に重要だと思う」または「やや重要だと思う」と回答した。

生成AI利用時のセキュリティに関連した規則、体制については、課題を認識している人の割合は60%以上だったにもかかわらず、規則の策定、明文化、組織的な検討がされている企業は20%未満となっており、「詳細規則策定中」を合わせても40%前後しか整備が進んでいなかった。

生成AIで作成したコンテンツについては、「悪意の生成AIコンテンツを含む詐欺攻撃による金銭被害、情報流出」に対して「非常に大きな課題である」「やや課題だと思う」と回答した人の割合が63.8%で最も高かった。

ただし、「生成コンテンツの品質向上のための職員のプロンプト作成スキル向上」「生成AIコンテンツのチェックにかかるコスト」「通常のコンテンツと生成AI由来コンテンツが混在することの混乱」などに「非常に大きな課題である」または「やや課題だと思う」と回答した人の割合も60%を超えており、IPAは「生成AIで生成したコンテンツの利用、評価、普及に関する課題に優先度がついていない状況だ」と分析している。

関連記事

「検索もAI」の時代がもう来たぞ! 「Perplexity」の革命性と課題と……個人的な心配

「検索もAI」の時代がもう来たぞ! 「Perplexity」の革命性と課題と……個人的な心配

人間性で勝負します。 ターゲットは「生成AI導入が停滞している企業」 アップデートから読み解くMicrosoftのAI戦略

ターゲットは「生成AI導入が停滞している企業」 アップデートから読み解くMicrosoftのAI戦略

TechTargetは「AI開発者向けのMicrosoftの製品アップデート」に関する記事を公開した。Microsoftが発表したのは、生成AIの実験段階で行き詰まっている企業を支援するアップデートだ。 AIプロジェクトの半分以上は本稼働前に頓挫 ガートナーが人とAIの関係性について提言を発表

AIプロジェクトの半分以上は本稼働前に頓挫 ガートナーが人とAIの関係性について提言を発表

ガートナージャパンは、アプリケーション開発とAIの関係についての提言を発表した。同社は「AIは製品やサービスを買って終わりではなく、何年にもわたって取り組みを続けることが求められる」としている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.