AI研究の最新動向や社会的影響を分析した「State of AI Report 2024」公開:AIにまつわる10の予測を発表

英国のベンチャーキャピタルAir Street Capitalは、AI研究の最新動向や、AIが社会的、経済的にもたらす影響を分析した「State of AI Report 2024」を公開した。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

英国のベンチャーキャピタルAir Street Capitalは2024年10月10日(米国時間)、AI(人工知能)に関する年次調査「State of AI Report」の2024年版となる「State of AI Report 2024」を公開した。

同レポートは、AIの進化に伴う社会的、経済的影響を分析し、AI技術の持続的かつ安全な発展を模索するための議論を促すことを目的としたものだ。Air Street Capitalによると、次のような観点でAI技術を分析しており、業界や研究の第一線で活躍するAI専門家によるレビューも受けているという。

- 研究:技術的なブレークスルーとその能力

- 産業:AIの商業分野への応用とビジネスへの影響

- 政治:AI規制、経済的影響、AIを巡る地政学リスク

- 安全性:高い能力を持つAIシステムが起こし得る壊滅的なリスクの特定と軽減策

- 予測:今後の動向予測と、予測の妥当性を検証するためのパフォーマンスレビュー

同レポートの主な内容は以下の通り。

State of AI Report 2024のハイライト

「GPT-4」とその他のモデルのギャップが縮む

2024年の大半にわたり、ベンチマークやコミュニティーのリーダーボードは、「GPT-4」とその他のトップモデルの間に大きな差があることを示していた。しかし、「Claude 3.5 Sonnet」「Gemini 1.5」「Grok 2」が登場したことで、その差はほぼ解消され、モデルの性能は収束し始めている。

「GPT-4o」は「MMLU」(Massive Multitask Language Understanding)ベンチマークでClaude 3.5 Sonnetを上回る一方、難易度の高い「MMLU-Pro」ベンチマークでは下回っている。

性能差が小さくなるにつれて、モデル開発者は、新しい機能や製品の特徴で競争しなければならない状況になりつつある。

LLM研究は「計画」と「推論」が優先事項に

企業は、エージェントアプリケーションを実現させるために、LLMを強化学習、進化アルゴリズム、自己学習と組み合わせることを模索している。

一方、LLMは依然としてシミュレーションタスクに苦戦している。因果関係、物理法則、物体の永続性を一貫して理解できないため、比較的単純なタスクであっても、「世界モデル」を構築することは困難だ。

そこで研究者らは、プランニング(計画)や推論においてより強力なプロセスを生成する方法を模索している。

スタンフォード大学とNotbad AIの共同チームは、事前トレーニング中に「根拠」を生成するアプローチとして「Quiet-STaR」を提案した。一方、Google DeepMindは推論時の計算に着目し、多くの問題に対して、テスト時に戦略的に計算リソースを増やすことで、大規模な事前学習モデルを使用するよりも効果的であることを示している。

内部推論のアプローチは、複雑な問題の解決能力を示したOpenAIの「o1」にも取り入れられている。

基盤モデルが言語の枠を超えて研究を支援

基盤モデルが従来の言語の枠を超えて、数学、生物学、生命科学、物理化学、神経科学など複数分野にわたるマルチモーダル研究を支援している。この中には、タンパク質構造を予測する「AlphaFold 3」や「ProGen2」、脳活動を予測する「BrainLM」、脳活動を画像で表現する「MindEye2」などが含まれる。

米国の対中輸出規制の効果は限定的

米国の対中輸出規制が拡大し、半導体の輸出が規制対象となるケースも増加している。だが、米国の制裁措置は、中国の研究機関が有能なモデルを生産する能力に限られた影響しか与えていない。

中国の研究機関は、承認された中国仕様の半導体を輸入したり、マレーシア、香港、日本の仲介業者を経由して半導体を輸入したりできる状況にある。また米国政府は、中国企業が米国内のデータセンターで半導体を利用することについて制限を設けていないため、米国内のデータセンターを利用することで、高性能なLLM

を構築できる状況だ。

米国政府は、このような利用状況の報告を義務付けるために、KYC(Know Your Customer)制度を通じた監視を計画しているが、具体的な規制案の策定には至っていない。

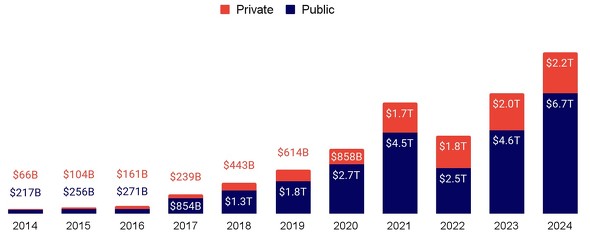

AI関連企業の価値は9兆ドルに

非公開企業の評価額が緩やかに上昇を続ける一方で、ごく一部の上場企業が市場全体を支える存在となっている。ベンチャー支援を受けた企業の中で、AI関連企業の割合が最も高かった分野はロボティクス、エンタープライズソフトウェア、宇宙、セキュリティだった。

一部のAI企業の収益が拡大

基盤モデルや動画、音楽生成に取り組む一部の企業の収益が拡大しつつある。その一方で、企業間の市場競争の一環でモデルの価格が下がる傾向があり、長期的な持続可能性に関する課題は未解決のままとなっている。

AI企業の出口戦略として「疑似買収」が浮上

AIの最先端を維持するコスト負担に苦しみ、持続可能なビジネスモデルを見つけるのに一部企業が苦労する中、技術ライセンス契約など知財獲得の手法とされる「疑似買収」がAI企業の出口戦略として浮上している。

AIの「実存的リスク」の議論は沈静化

OpenAIで起きたクーデター未遂事件(サム・アルトマン氏のCEO解任、復帰騒動)以降、AIが人間の生命を脅かすという実存的リスクに関する議論は沈静化しつつある。一方で、研究者らは潜在的な脆弱(ぜいじゃく)性やモデルの悪用に関する知見を深めており、解決策や安全策の提案を続けている。

AIにまつわる10の予測

Air Street Capitalは、今後12カ月以内のAIにまつわる10の予測を次のように挙げている。

- 米国の大手AI研究機関への国家による100億ドル以上の投資が、国家安全保障の観点から審査される

- コーディングスキルのない人物が作成したアプリケーションまたはWebサイトが流行し、App Storeのトップ100にランクインする

- 最先端のAI研究機関は、データ収集に関する訴訟が裁判に至る事例を受け、データ収集の方法を変更する

- EU AI法は、立法者が規制の過剰さを懸念し、当初の予想よりも柔軟なものとなる

- OpenAIのo1に対抗するオープンソースモデルが登場し、複数の推論ベンチマークでo1の性能を上回る

- 競合企業はNVIDIAの市場シェアに大きな影響を与えられず、同社の競合優位性は維持される

- ヒューマノイドロボットへの投資が減少し、企業はPMF(プロダクトマーケットフィット)の確立に苦戦する

- AppleのオンデバイスAI研究で優れた成果が出たことにより、個人向けオンデバイスAIへの関心が高まる

- AIによって生成された研究論文がAI、機械学習の会議やワークショップで採択される

- 生成AIを基盤にしたインタラクティブ要素を持つビデオゲームが、大ヒットする

関連記事

生成AI利用率は先進国よりアジア太平洋地域の方が高い デロイト トーマツ グループがレポートを公開

生成AI利用率は先進国よりアジア太平洋地域の方が高い デロイト トーマツ グループがレポートを公開

デロイト トーマツ グループは、レポート「アジアパシフィックにおける生成AI」を発表した。アジアパシフィックで生成AIの導入をけん引しているのはデジタルネイティブ世代だということが分かった。 オープンソース技術に基づくべき生成AIのコンポーネントは何か Linux Foundation Japanが調査レポートを発表

オープンソース技術に基づくべき生成AIのコンポーネントは何か Linux Foundation Japanが調査レポートを発表

Linux Foundation Japanは「2023年オープンソースの生成AIに関する調査レポート」を公開した。生成AIがビジネスの重要な要素になりつつあり、統合の容易さと透明性の点で、プロプライエタリAIよりもオープンAIが好まれていることが分かった。 AI動向の年次調査レポート「2024 AI Index Report」公開 スタンフォード大研究所

AI動向の年次調査レポート「2024 AI Index Report」公開 スタンフォード大研究所

スタンフォード大学の研究所は、AI動向をまとめた最新の年次調査レポート「2024 AI Index Report」を公開した。生成AIのトレーニングコストに関する新たな推定値、責任あるAIの展望に関する詳細な分析などを報告している。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.