「勝手にPythonコードを生成して画像を調査」 Geminiの画像理解の精度を10%上げる「Agentic Vision」:「明示的なプロンプトを完全になくす」ことを目指す

Googleは、Gemini 3 Flashの新機能として「Agentic Vision」を発表した。画像理解に視覚的推論とコード実行を組み合わせる仕組みだという。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

Googleは2026年1月27日(米国時間)、生成AI(人工知能)モデル「Gemini 3 Flash」の新機能「Agentic Vision」を発表した。

従来のAIモデルは、世界を単一かつ静的な画像として処理するため、マイクロチップのシリアル番号や遠くの道路標識といった微細な詳細を見落とした場合、“推測”に頼らざるを得ないという課題があった。

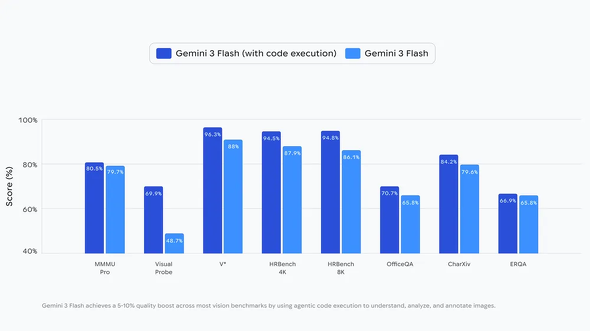

Gemini 3 FlashのAgentic Visionは、視覚的推論とコード実行を組み合わせることで、視覚的な証拠に基づいて回答を導き出す。Googleによると、コード実行を有効にしたGemini 3 Flashは、ほとんどのビジョンベンチマークで一貫して精度が5〜10%向上したという。

Agentic Visionは画像を理解するために何をしているのか?

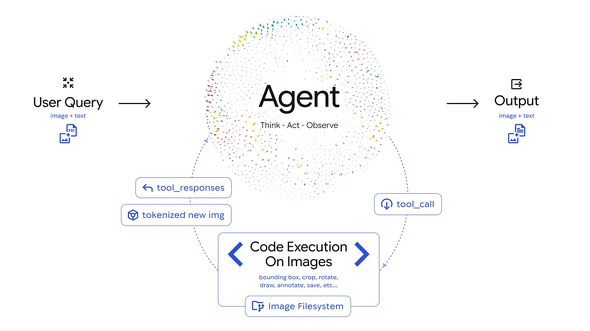

Agentic Visionは、画像理解のタスクにおいて「Think(思考)」「Act(実行)」「Observe(観察)」という視覚的推論のループを導入している。プロセスの詳細は以下の通り。

- Think(思考)

- ユーザーのクエリと初期画像を分析し、多段階の調査手順を計画する

- Act(実行)

- Pythonコードを生成・実行し、画像の切り抜き(クロッピング)、回転、注釈付けなどの操作や、計算、バウンディングボックスのカウントなどの分析を能動的に行う

- Observe(観察)

変換された画像がモデルのコンテキストウィンドウに追加され、より優れたコンテキストで新しいデータを検査した後に、最終的な回答が生成される

Agentic Visionの活用事例

APIでコード実行を有効にすることで、さまざまな新しい動作が可能になる。大企業からスタートアップまで、多くの開発者がこの機能への統合を開始しており、以下のようなユースケースで実践している。

1:詳細部分を自動ズームして検査

Gemini 3 Flashは、詳細部分を検出する際に自動的にズームするようにトレーニングされている。

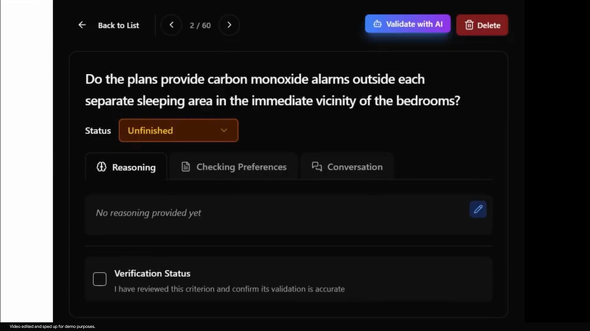

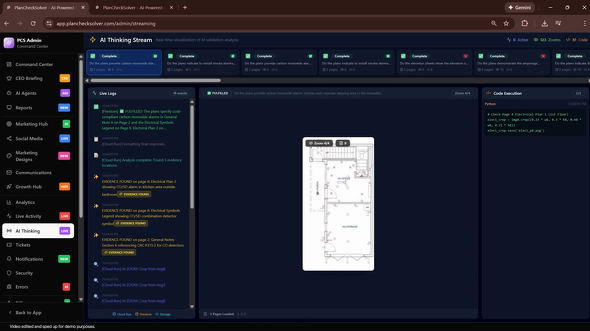

AIを活用した建築設計図検証プラットフォーム「PlanCheckSolver.com」は、Gemini 3 FlashのPythonコード実行を有効にして高解像度の図面を反復的にズームし、精度を5%向上させた。

2:画像への注釈付けによる正確なカウント

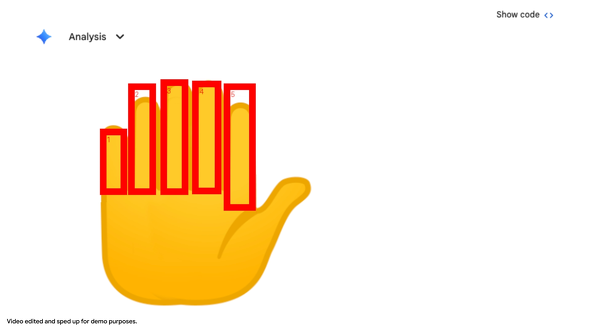

Agentic Visionにより、モデルは画像に注釈を付けることで環境と相互作用できる。Gemini 3 Flashは単に見たものを説明するだけでなく、キャンバスに直接描画するPythonコードを実行して推論を裏付ける。

例えば、Geminiアプリケーションで手の指の数を数える際、カウントミスを避けるためにPythonコードを使用して特定した各指にバウンディングボックスと数字のラベルを描画する。この「ビジュアルスクラッチパッド(視覚的な下書き)」により、ピクセル単位の正確な理解に基づいた最終回答が可能になるという。

3:データの視覚化とハルシネーションの回避

Agentic Visionは、高密度の表を解析し、Pythonコードを実行して結果をグラフなどに視覚化できる。標準的な大規模言語モデル(LLM)は、数ステップの視覚的演算中にハルシネーション(幻覚)を起こすことがある。Gemini 3 Flashは、計算を決定論的(同じ入力を与えれば、必ず同じ結果が返ってくるという性質)なPython環境にオフロードすることでハルシネーションを回避するという。

今後はさらに自律化とツール連携を拡張へ

Googleは、今後、Agentic Visionを以下の方向で進化させることを計画している。

- 暗黙的なコード駆動型の動作の強化

現在は詳細のズームなどは自動的に判断されるが、画像の回転や視覚的な数学などの機能には明示的なプロンプトが必要な場合がある。将来のアップデートでは、これらの動作を完全に暗黙的なものにすることを目指している - ツールの拡充

Web検索や逆画像検索など、世界への理解をさらに深めるためのツールをGeminiモデルに装備することを検討している - 対応モデルの拡大

現在はFlashモデルで提供されているが、今後は他のモデルにもこの機能を拡張する予定

Agentic Visionの始め方

Agentic Visionは、AIアプリケーション開発環境「Google AI Studio」「Vertex AI」のGemini APIを通じて利用可能だ。

Geminiアプリケーションでも順次展開が開始されており、モデルドロップダウンから「思考モード」を選択することでアクセスできる。開発者はGoogle AI Studioでデモを試用できる他、同「Playground」で「Tools」の「Code execution」をオンにすることで機能をテストできる。

関連記事

Gemini 3 Flash登場 Proに迫る性能で価格は最大1/8、軽量モデルがAI開発の常識を変えるか

Gemini 3 Flash登場 Proに迫る性能で価格は最大1/8、軽量モデルがAI開発の常識を変えるか

派手な性能競争の陰で、AI開発の現場では別の変化が起き始めているのかもしれない。Googleが発表した「Gemini 3 Flash」は、その兆しを象徴するモデルだ。この発表を起点に、軽量モデルが開発の主役になり得るのかを筆者なりに考えてみたい。 「軽量12Bが27B超えのパフォーマンス」その要因は? Google、Gemma 3ベースの翻訳モデル公開

「軽量12Bが27B超えのパフォーマンス」その要因は? Google、Gemma 3ベースの翻訳モデル公開

Googleは、Gemma 3をベースとした新翻訳モデル「TranslateGemma」を発表した。4B、12B、27Bのパラメーターサイズで提供される。 Google検索の新機能「AIモード」 的確な回答を支える秘密は「クエリファンアウト技術」

Google検索の新機能「AIモード」 的確な回答を支える秘密は「クエリファンアウト技術」

Google検索に新しく登場した「AIモード」。Google公式ホワイトペーパーを基に、複雑な問いに広く深く応える「クエリファンアウト技術」の仕組みを紹介する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.