「テキスト検索では限界」 リコーLMMは図表も扱える、“大型商用モデル並み”の実力:思考性能を備えたマルチモーダルLLM

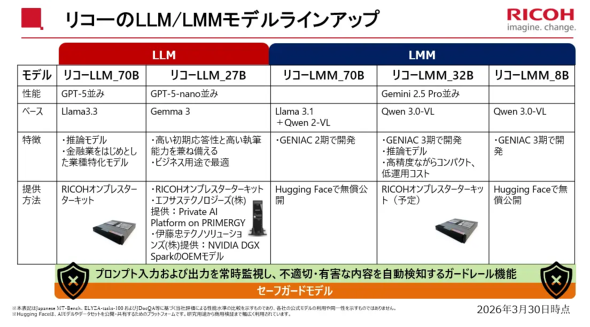

リコーは、経済産業省とNEDOが実施するプロジェクト「GENIAC」第3期において、リーズニング性能を備えたマルチモーダル大規模言語モデルの開発を完了した。軽量モデルをHugging Faceで無償公開している。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

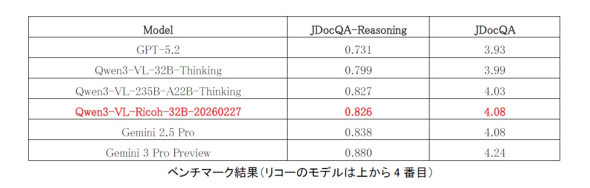

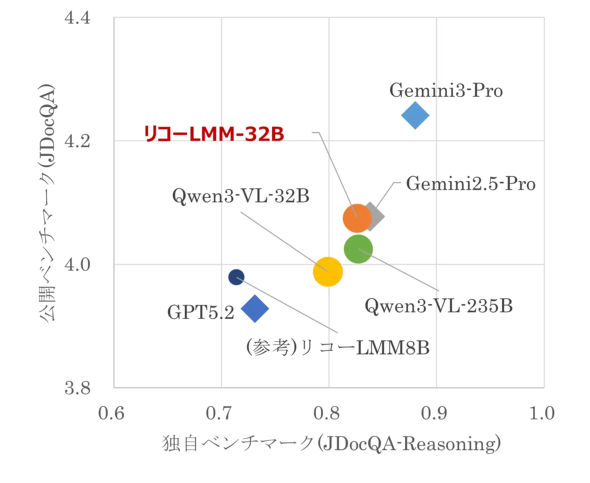

リコーは2026年3月30日、経済産業省と国立研究開発法人新エネルギー・産業技術総合開発機構(NEDO)が実施するプロジェクト「GENIAC」(Generative AI Accelerator Challenge)第3期において、リーズニング(思考)性能を備えた大規模マルチモーダルモデル(LMM:Large Multimodal Model)の基本モデル「Qwen3-VL-Ricoh-32B-20260227」(以下、リコーLMM-32B)の開発完了を発表した。

同モデルは、多段推論を通じて複雑なドキュメントを理解できる点を特徴としている。軽量モデル「Qwen3-VL-Ricoh-8B-20260227」(以下、リコーLMM-8B)は、同日からAIモデル共有プラットフォーム「Hugging Face」で無償公開されている。

「テキスト検索では限界」 企業内ドキュメント活用の課題に応えるLMM

請求書や経営資料、サービスマニュアル、技術標準など多様な企業内ドキュメントには、テキストだけでなく図や表組、画像が数多く混在している。従来のテキスト検索では十分に活用し切れないこれらの情報を、AIで横断的に扱えるようにすることが開発の出発点だ。

労働力不足や技能伝承、多言語対応といった経営課題を背景に、AIを活用した企業内知識の効率的な利活用へのニーズが高まっていることも開発を後押ししたという。

強化学習×カリキュラム学習で「読み間違い」を低減

リコーLMM-32Bは、Alibaba Cloudが開発する大規模言語モデル(LLM)「Qwen3-VL-32B-Instruct」をベースに構築された。強化学習とカリキュラム学習を組み合わせることで、複数ページにまたがる図表を関連付けて理解し、読解難易度の高い質問にも高精度な回答を生成できるとしている。

性能面の特徴は以下の通り。

- 図表読解の深化

- 強化学習やカリキュラム学習による推論プロセスの導入で、複雑なドキュメントの読み間違いを大幅に低減

- 論理思考力の向上

- データの抽出にとどまらず、読み取った数値に基づく計算や比較分析の精度が向上

- 高信頼な回答生成

- 思考プロセスを日本語化することで回答の根拠を明確化し、ビジネス実務における信頼性が向上

ベンチマーク結果では、「Gemini 2.5 Pro」などの大型商用モデルと同等の結果を確認したとしている(2026年2月17日時点)。リーズニング性能を評価するための独自ベンチマークツールも今後公開される予定だ。

オンプレミス対応でファインチューニング可能、製造業での実証も予定

リコーLMM-32Bはオンプレミス環境への導入が可能で、企業の業種や業務に応じたファインチューニングにも対応している。モデルマージ技術の活用による効率的な開発プロセスの確立や、独自の画像トークン圧縮技術による運用コスト低減にも取り組んでいる。

製造業の顧客からは、トラブル発生時の社内ドキュメント参照による早期解決や、設計図と要求仕様の適合確認といったニーズが寄せられており、今後実証実験を進める予定としている。

関連記事

リコー、日本語特化オンプレ向け非推論モデルを開発 Gemma 3 27Bベースで何を足し引きしたのか?

リコー、日本語特化オンプレ向け非推論モデルを開発 Gemma 3 27Bベースで何を足し引きしたのか?

リコーがGemma 3 27Bをベースに、オンプレミスでの導入に特化した日本語用LLMを開発した。OpenAIのgpt-oss-20bなどと同等の性能だという。何を足し、何を引いたのか? Gemini 3.1 Pro登場 思考モデルから実務エージェントへ、複雑タスクを完遂するAIに進化

Gemini 3.1 Pro登場 思考モデルから実務エージェントへ、複雑タスクを完遂するAIに進化

思考力の強化に加え、エージェント実行能力を大きく押し上げたGemini 3.1 Pro。本稿では主要ベンチマークや機能改善を整理しつつ、「考えるAI」から「働くAI」へと進むモデル進化の方向性を、開発者視点のコメントとともに読み解く。 “説明できないAI”はもうアウト AIによる意思決定の透明性を高める「DI」とは?

“説明できないAI”はもうアウト AIによる意思決定の透明性を高める「DI」とは?

2028年までに政府機関の約8割がAIエージェントを導入し、意思決定の自動化に生かすとGartnerは予測する。そこで課題となるのが、意思決定の透明性の確保だ。その対策の鍵になる「DI」と、実現に向けた取り組みとは。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.