第269回 エッジAIは日本の最後の砦か? 学習もエッジAIで行うメリットとは:頭脳放談

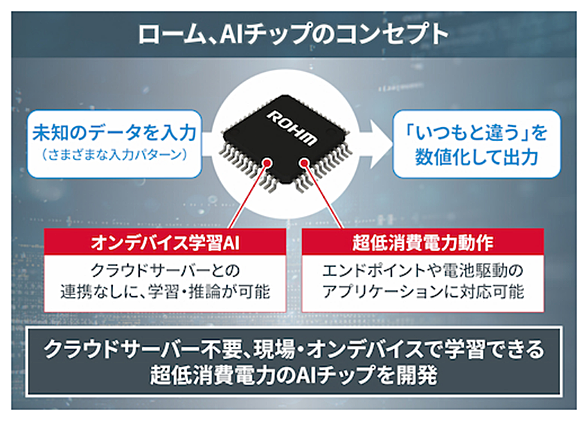

ロームが発表したエッジAIデバイスがちょっと興味深い。推論だけでなく、学習もローカルのデバイスで行うという。ターゲットが「故障予兆検知」というのも面白い。故障予兆検知の可能性や、デバイスで学習を行うメリットについて考えてみた。クラウド分野が海外に抑えられている昨今、エッジAIは日本の最後の砦(とりで)かも……。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

人工知能(AI)の学習機能を実装したAIチップ

人工知能(AI)の学習機能を実装したAIチップデバイス上でAIの学習が行えるロームが発表したマイコン。ターゲットは故障予兆検知だという。チップ内で入力データを学習し、故障の予兆を検知するというものだ。こうしたエンドポイントでの学習機能のメリットや故障予兆検知の可能性について考えてみた。

2022年10月18日から21日は、「CEATEC 2022」が開催されるので、それ向けの直前のプレスリリースだと思う。ロームが2022年9月末に「オンデバイス学習AIチップ」というものを発表した(ロームのプレスリリース「クラウドサーバー不要、現場でリアルタイムの故障予知を実現する、数10mW超低消費電力のオンデバイス学習AIチップを開発」)。

AI(人工知能)チップはいろいろある中で、このロームのチップが「新しさ」を主張するのはエンドポイント(末端)で推論だけでなく学習も可能にした、という点だ。エンドポイントでの学習処理というものには少し関心があったので、この機会に考えをまとめてみたい。

故障予兆検知は地味だが意外と適用範囲が広そう

猫も杓子(しゃくし)も「AIを使っています」と言いながら、説明はAIの2文字で済ませてしまう風潮には釈然としないものがある。

しかし今回のチップの方向性は明らかである。「AI本流」というべきニューラルネットワーク分野だ。そして画像認識などの代表的な応用分野に使うわけではなく、ターゲットとしているアプリケーションは「故障予兆検知」だ。

AI以前ならベテランのエンジニアが、振動(異音など)、電流値、温度、何かの色など五感を働かせて異常を見つけて対処していたことを、AI搭載のマイコンシステムに見張りを任せようというのだ。

「地味な分野」と言うなかれ。「つまらない部品の故障」でもインフラ設備に予期せぬ故障が起きれば、大きな影響が発生するのは、鉄道や電力などのインフラを考えれば想像がつく。製造業などでは利益にも直結する。年間売り上げ300億円の工場が1日止まるだけで、1億円に近い売り上げが減る、というリスク計算も想定できる。

しかし、確率でなく直接そろばんをはじくこともできるのが、部品の交換頻度である。故障しないギリギリまで部品を使うことができれば、交換の頻度を減らせる、つまりは部品代が浮くという計算だ。

高価な部品でも故障時の影響の大きさを考えて、ある期間使用したら予防的に交換する、といったことをしていた場合を考えてみよう。故障寸前まで使えるのならば、使用期間が延びた分だけもうけになる道理だ。監視用のシステムがそのもうけと比べて十分安ければ、導入の動機になり得る。

ローカルデバイスで学習を行うメリット

ニューラルネットワークの計算量、特に学習時の負荷の重さは、みなさんご存じの通り大変重たいものだ。また、多数の末端装置から収集される大量の個体の大量データを総合して処理するのもサーバ側でないとできない。

そこで、学習はクラウド上のサーバにお任せするのが一般的だ。サーバはGPUやAI専用のアクセラレータなどを搭載し、メモリ量も多いのでそのような学習処理に向く。

ただし、クラウド処理の問題点はレスポンスの遅さである。制御しづらい通信遅延が発生するからだ。スマートフォン(スマホ)で写真を撮ってクラウドで処理して結果を送り返してもらうのに秒単位で時間がかかってもクリティカルではないが(いらいらする程度だが)、機械相手の制御の場合、秒単位の遅延は死命を制するといってよい。正常な停止処理を行う前に故障して、ひどいことになる可能性もある。

そこで、クイックなレスポンスを得るためになるべく末端に近いところに推論とその結果を受けての制御を行わせたいわけだ。エッジと呼ばれるIoTネットワークの末端とサーバの中間で制御する場合や、末端のセンサーデバイスで制御する場合は、学習結果をサーバからもらって、推論のみ行うことが主流だ。

ただ、学習はクラウド上というのが不便なこともある。それぞれの末端デバイスの固有な状況、個体差が大きく、変動パターンが変化していくような場合だ。まさに故障検知などに適合するのだと思われる。このような場合には個体ごとに学習して即座に反映できるような仕組みが確かに向きそうだ。

ロームのデバイスはどんなもの?

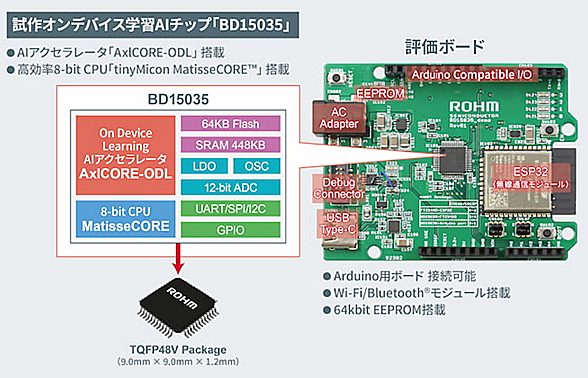

ここに来て、ようやくロームが慶應義塾大学の松谷教授開発による「オンデバイス学習アルゴリズム」という学習負荷を劇的に下げることができるアルゴリズムを「AxlCORE-ODL」という「軽い」ハードウェア上に実装し、自社の小型マイコン「tinyMicon MatisseCORE」と組み合わせ、エンドポイント側で学習ができるチップ「BD15035」を試作してみました、というプレスリリースの骨子が理解できたことになる。

ここからはプレスリリース文にない勝手な意見を書かせてもらう。まず発表時期だが、ロームの製品発表としては、少々早すぎる感じがしないでもない。量産用のチップの開発着手は2023年度、量産は2024年度らしい。ともかくCEATECで発表したい人がいたための先行的なプレスリリースではないかと思われる。まだ製品にした場合の効果(どのような装置に適応したらどれだけもうかるの?)は不明な状態だと思う(集計中かもしれないが)。

続いてロームの自社8ビットマイコン「MatisseCORE」との組み合わせも疑問だ。個人的には自社独自マイコン嫌いではない。が、マイコンのソフトウェア開発をするユーザーの立場だと、1社限定の独自コア用のソフトウェア開発に資金を投じるのは躊躇(ちゅうちょ)する人がいてもおかしくない。

確かに8bitコアで軽くて低消費電力かもしれないが、マイコンに比べたら大電力を消費するモーター制御に使うのであれば、それほど低消費電力が必須とも思えない。今どきであれば、Armコアか、成長著しいRISC-Vコアの方が、将来考えたらよいチョイスじゃないかとも思える。

多分、32ビットクラスの製品であれば、このAIアクセラレータを搭載して故障予兆検知をやりながら、計算負荷の重いモーターの駆動制御なども行えるかもしれない。だいたい32ビットコアを複数搭載するマイコンでも単価はかなり安いのだ。

ロームの営業にお願いすると貸し出してくれるらしい「評価ボード」を見ると、ロームの努力の一方、そのマイコンの限界も見える気がする。「評価ボード」はいまや定番のArduino互換のボード形状、ピン配置である。これであればシールドと呼ばれるArduino互換の拡張ボード類を差し込んで評価実験はしやすい。

ロームが貸し出しを行う評価ボード

ロームが貸し出しを行う評価ボード評価ボードには、今回発表したデバイス学習AIチップが搭載されており、評価実験が行える。ただ、これを見ると、無線LANモジュールは別となっており、学習AIチップには同梱されてないようだ。

しかし、見ればボード上にはロームのこのチップとは別に、「ESP32」が搭載されている。これは無線LAN(Wi-Fi)接続の定番モジュールで、秋葉原でも数百円で買える。

ローム独自マイコンでは、今のところインターネット接続などを自前でやるのが困難だからだろう。ネットワークに接続しなくても、学習できるとはいうものの、今や産業用途でも車載でもなんらかのネットワーク接続が必須だと思う。ネットワーク接続は別マイコンを買ってくれ、では済まない気がする。

評価ボードに搭載のESP32はTensilica(テンシリカ)の32ビットデュアルコアだ。最近はRISC-Vコア品も出てきた。定番のコアであれば、プロトコルスタックなどのライブラリ、ツールチェーン、RTOS、開発ツールなど各種のソフトウェアが流通している。

Arduino互換環境ならば開発ツールのセットアップから始めても30分あれば、ネットワークに接続するサンプルソフトウェアをビルドしてボードに書き込んで通信できるくらいだ。しかし、自社開発のクローズドのコアでは、そのようなスピード感の開発環境に至るのは難しいのではないか、と危惧する。

それに「オンデバイス学習アルゴリズム」の適用可能な範囲にも疑問がある。3層のニューラルネットワークというのは、ニューラルネットワークといっても規模的にはかなり小さいように思える。

メモリ量、計算量を抑えるための工夫を凝らしているのだと思うが、最近の32ビットマイコンであれば、ソフトウェアでも「やれちゃう」レベルなのではないだろうか。まぁ、速度と消費電力は問題だろうが。とはいえ、多少の不利があっても、ハードウェア化せずソフトウェアで実装すれば、簡単に拡張したり、機能を増やしたりして、適用範囲を増やせるので、後々楽なのではないかと想像する。いくら軽くても「もうけが出せる」提供範囲が狭くては商売にはならないだろう。

最後の方は批判するようなことばかり書いてしまった。エンドポイントでAIというのは見果てぬ夢である。クラウド側のデータセンターなどをAmazonやGoogleなどを押さえられてしまっている中で、末端側に付加価値を取り戻すというのは日本の業界にとっては価値のあるアクションだと思う。うまく行ってもらいたいものだが。

筆者紹介

Massa POP Izumida

日本では数少ないx86プロセッサのアーキテクト。某米国半導体メーカーで8bitと16bitの、日本のベンチャー企業でx86互換プロセッサの設計に従事する。その後、出版社の半導体事業部などを経て、現在は某半導体メーカーでヘテロジニアス マルチコアプロセッサを中心とした開発を行っている。

Copyright© Digital Advantage Corp. All Rights Reserved.