「攻撃者もAIリソースが欲しい」 Googleが暴く9つの最新AI悪用事例:AIに、自身のコードを“外注”するマルウェアが今後の主流か

Googleの脅威インテリジェンス部門は、AIを悪用した脅威の最新動向をまとめた四半期レポートを公開した。

この記事は会員限定です。会員登録(無料)すると全てご覧いただけます。

Googleの脅威インテリジェンス部門Google Threat Intelligence Group(以下、GTIG)は2026年2月13日(米国時間)、AI(人工知能)を悪用した脅威の最新動向をまとめた四半期レポート「GTIG AI Threat Tracker: Distillation, Experimentation, and (Continued) Integration of AI for Adversarial Use」を公開した。

脅威アクターが攻撃ライフサイクル全体にわたってAIの統合を進めており、偵察、ソーシャルエンジニアリング、マルウェア開発などにおける悪用を確認したという。以下、9つの悪用事例をまとめる。

国家支援型脅威アクターが攻撃の全段階でAIを悪用

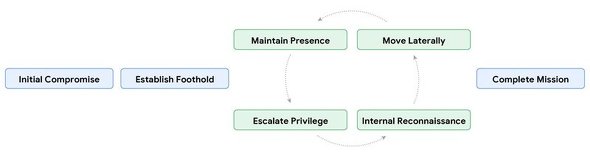

国家支援型脅威アクターは、初期侵害から足掛かりの確立、プレゼンス維持、権限昇格、内部偵察、ラテラルムーブメント(横展開)、ミッションの実行まで、攻撃ライフサイクルの全段階でAIを悪用している。

【1】偵察と標的設定

APT(Advanced Persistent Threat)アクターは、攻撃ライフサイクルのうち初期侵害を容易にする偵察と標的設定に「Gemini」を悪用している。Geminiの速度と精度を生かすことで、従来必要だった標的プロファイリングの手作業が不要になった。

さらに、「OSINT」(Open Source Intelligence:公開情報インテリジェンス)(※)の迅速な統合により、高価値の標的のプロファイリング、標的組織の主要意思決定者の特定、組織階層のマッピングなどが可能になっている。

※インターネットなどで一般に公開されている情報を収集、分析し、有用な洞察を引き出す手法

こうした偵察と標的設定にGeminiを悪用している脅威アクターの例として、未帰属の「UNC6418」、中国系の「Temp.HEX」などがある。

AIツールのサイバー犯罪利用

GTIGは、AIツールのサイバー犯罪利用の主な事例として、以下の2つを報告している。

【2】地下AIエコシステム:「Xanthorox」の実態

「Xanthorox」は地下フォーラムで、「マルウェアやフィッシングの自動生成が可能なカスタムAIツール」として宣伝されてきたが、GTIGの調査により、その実態はGeminiなど複数の商用AIと、「Crush」「Hexstrike AI」「LibreChat-AI」「Open WebUI」といったオープンソースAI製品を、MCP(Model Context Protocol)サーバで統合したものと判明した。

攻撃者はLLM(大規模言語モデル)サービスを大規模に悪用するためにAPIキーを必要とすることから、クラウドリソースを大量に持つ組織が標的にされるリスクが高まっている。脆弱(ぜいじゃく)なオープンソースAIツール(「One API」「New API」など)を悪用したAPIキーの窃取も横行しており、闇市場での不正転売が盛んになっている。

【3】「ClickFix」の手口によるソーシャルエンジニアリング攻撃

GTIGは2025年12月初旬、脅威アクターが生成AIサービスの公開共有機能を悪用し、2025年に猛威を振るった「ClickFix」(※)によるソーシャルエンジニアリング攻撃を仕掛けるキャンペーンを初めて確認した。攻撃者はGemini、「ChatGPT」「Copilot」「DeepSeek」「Grok」といったAIプラットフォームから、偽の「PCトラブルの解決手順ガイド」を作成、公開し、そのURLにユーザーを誘導する。

※人をだますことで不正な操作をさせたり、情報を窃取したりするソーシャルエンジニアリングの一種

攻撃チェーンは以下の通り。

- 攻撃者がAIとチャットし、「PCトラブルの解決手順ガイド」を作成させ、PCにマルウェアを感染させるコマンドをその中に紛れ込ませる

- AIサービスのチャット記録共有機能を使い、このガイドのURLを生成する

- そのURLに、広告などでユーザーを誘導する

- ユーザーがガイドを信頼し、手順に従って、指示されたコマンドをターミナルにコピーし、貼り付ける。これによってマルウェアがダウンロード、インストールされる

インストールされるのはmacOS向け情報窃取型マルウェア「ATOMIC」だ。GTIGは、AIサービスの公開共有機能が信頼性の高いドメインを介して悪用された事例を確認したのは初めてだとしている。

AI統合マルウェアの新展開

GTIGは2025年の終盤に、脅威アクターがマルウェアファミリーに新たな機能を実装するためにAIを実験的に悪用する動きを継続して観測した。以下の2つの例を報告している。

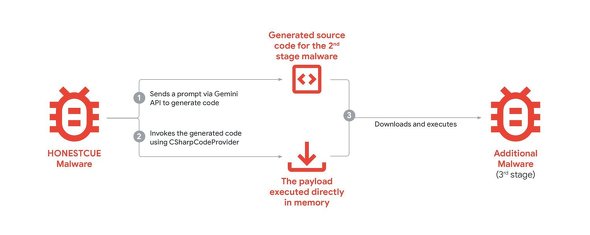

【4】Gemini APIを悪用してコード生成を外注する「HONESTCUE」

GTIGは2025年9月、Gemini APIを用いてC#ソースコードを動的に生成するダウンローダ型マルウェア「HONESTCUE」を発見した。生成されたコードは第2段階の機能を実行し、これによって第3段階のマルウェアがダウンロードされ、実行される。HONESTCUEの主な特徴は以下の通り。

- Gemini APIを介してハードコードされたプロンプトを送信し、生成させて受け取ったC#ソースコードをメモリ内でコンパイル、実行する

- ディスク上にペイロードの痕跡を残さないので、静的解析や従来のネットワーク検知を回避する

- 「Discord CDN」を最終ペイロードのホスティングに使う

- ハードコードされたプロンプト自体は無害であり、セキュリティシステムをすり抜けやすい

GTIGは、HONESTCUEが現時点では、小規模グループによる概念実証(PoC)段階にあるとみている。悪意あるコードの一部機能をLLMに外注するアプローチは、攻撃者が今後、セキュリティガードレールを回避してAIを悪用する方向性を示す先駆的事例だと位置付けている。

【5】フィッシングキット「COINBAIT」

GTIGは2025年11月、AIコード生成プラットフォーム「Lovable AI」を用いて作成されたフィッシングキット「COINBAIT」を発見した。大手仮想通貨取引所を装い、認証情報を詐取するように設計されている。

「React」のSPA(シングルページアプリケーション)として構築されており、複雑な状態管理およびルーティング機能を備えている。「Cloudflare」をプロキシに利用して攻撃者のIPを隠蔽(いんぺい)し、Lovable AIのインフラを画像ホスティングに悪用している。

フィッシング攻撃の巧妙化

脅威アクターがLLMを悪用して、標的組織が用いる専門的な表現や用語、あるいは現地語を模倣し、高度にカスタマイズされたフィッシングメッセージを生成するケースが増加している。

【6】信頼関係構築型フィッシング

見破られる要素をほぼ消し去ったメッセージを送信し、標的と自然な会話を行い、信頼関係を構築した上で、悪意あるペイロードを配信する手法も現れている。

GTIGは、こうして標的型ソーシャルエンジニアリングを強化した脅威アクターとして、イラン政府が支援する「APT42」や、北朝鮮政府が支援する「UNC2970」を例に挙げている。

【7】コーディングやツール開発への応用

脅威アクターは、フィッシングコンテンツの作成からマルウェアや攻撃ツールの開発(コーディング、スクリプト作成、デバッグ、脆弱性調査)、C2(Command&Control)サーバの構築、侵害後の活動支援、オープンソースソフトウェアの説明や活用例の生成など、幅広い目的でGeminiを悪用している。

例えば、中国系の「APT31」は、サイバーセキュリティ専門家を装ってGeminiを操作し、脆弱性分析に加え、リモートコード実行(RCE)およびSQLインジェクションのテスト計画の自動生成などを行わせた。

【8】情報工作

GTIGは、情報工作(IO:Information Operations)を行う中国、イラン、ロシア、サウジアラビアなどのアクターが、調査、コンテンツ作成、翻訳などを効率化するためにGeminiを悪用していることを引き続き確認した。ただし、これらの試みは、いずれも情報工作キャンペーンの画期的な進化にはつながっていない。

モデル抽出攻撃が増加傾向

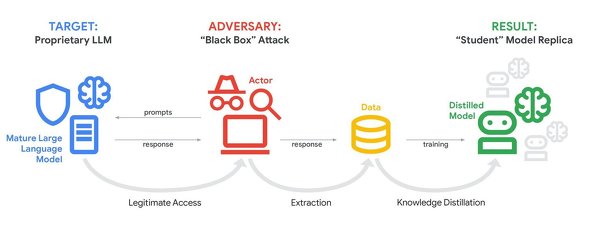

GTIGとGoogleのAI研究部門Google DeepMindは2025年を通じて、AIモデルの能力を不正に複製しようとする「モデル抽出攻撃」(「蒸留攻撃」)が増加していることを確認した。攻撃者が正規のAPIアクセスによってモデルに大量のクエリを送り、その応答から内部ロジックやリーズニングプロセスを模倣した「生徒モデル」を構築するものだ。

【9】「リーズニングトレース強制」攻撃

GTIGはモデル抽出攻撃の一例として、攻撃者がGeminiのリーズニング能力の複製を狙った「リーズニングトレース強制」攻撃を紹介している。内部のリーズニングトレース(リーズニングプロセス)は通常、ユーザーに届く前に要約されるが、攻撃者は10万件を超えるプロンプトにより、リーズニングプロセス全体を出力させようとした。この攻撃キャンペーンはGoogleのシステムによってリアルタイムで検知、対処され、リーズニングプロセスは保護された。

モデル抽出攻撃は通常、エンドユーザーにとって直接的な脅威ではない。AIサービスの機密性や可用性、完全性を損なうわけではないからだ。だが、AIモデルの開発企業やサービスプロバイダーには重大な知的財産リスクをもたらす。

Googleの対応と今後の見通し

GTIGは、これらの脅威に関連するプロジェクトやアカウントを無効化するとともに、Geminiモデルの安全分類器を継続的に強化している。業界のベストプラクティスを積極的に共有することで、エコシステム全体の防御力向上も支援している。

現時点では、APTアクターがAIを用いて脅威状況を根本的に変えるような飛躍的能力を獲得した事例は確認していないが、AI統合型マルウェアの実験的な試みが今後増加すると予測している。防御側は、APIアクセスのモニタリング強化、AIを悪用したフィッシングの検知、モデル抽出パターンへの警戒を強める必要がある。

関連記事

「AI駆動ランサムウェア」出現、高度な偽情報も急増――自社をどう守る? ESETが3つの提言

「AI駆動ランサムウェア」出現、高度な偽情報も急増――自社をどう守る? ESETが3つの提言

「ESET脅威レポート 2025年下半期版」によると、AI駆動型マルウェアの出現やNFC悪用の急増など、サイバーセキュリティにおける重要な転換点となる複数の事象が確認されたという。 情報漏えいは序章? AIエージェントが悪用される3つの深刻なシナリオ、Microsoftが解説

情報漏えいは序章? AIエージェントが悪用される3つの深刻なシナリオ、Microsoftが解説

Microsoftは公式ブログで、AIエージェントの普及によって新たなセキュリティリスクが生まれていると指摘。自律的に動作するAIエージェントがリスクをもたらす3つのシナリオを解説した。 「Linuxクラウドに潜伏」するAI生成マルウェア、“従来の低品質品とは全く別物”

「Linuxクラウドに潜伏」するAI生成マルウェア、“従来の低品質品とは全く別物”

Check Point Researchは、最新のLinuxベースのクラウド環境で動作するよう設計された高度なマルウェアフレームワーク「VoidLink」を新たに特定した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.